金融リスク管理は新たなステージへ!2026年にAI導入が本格化する理由

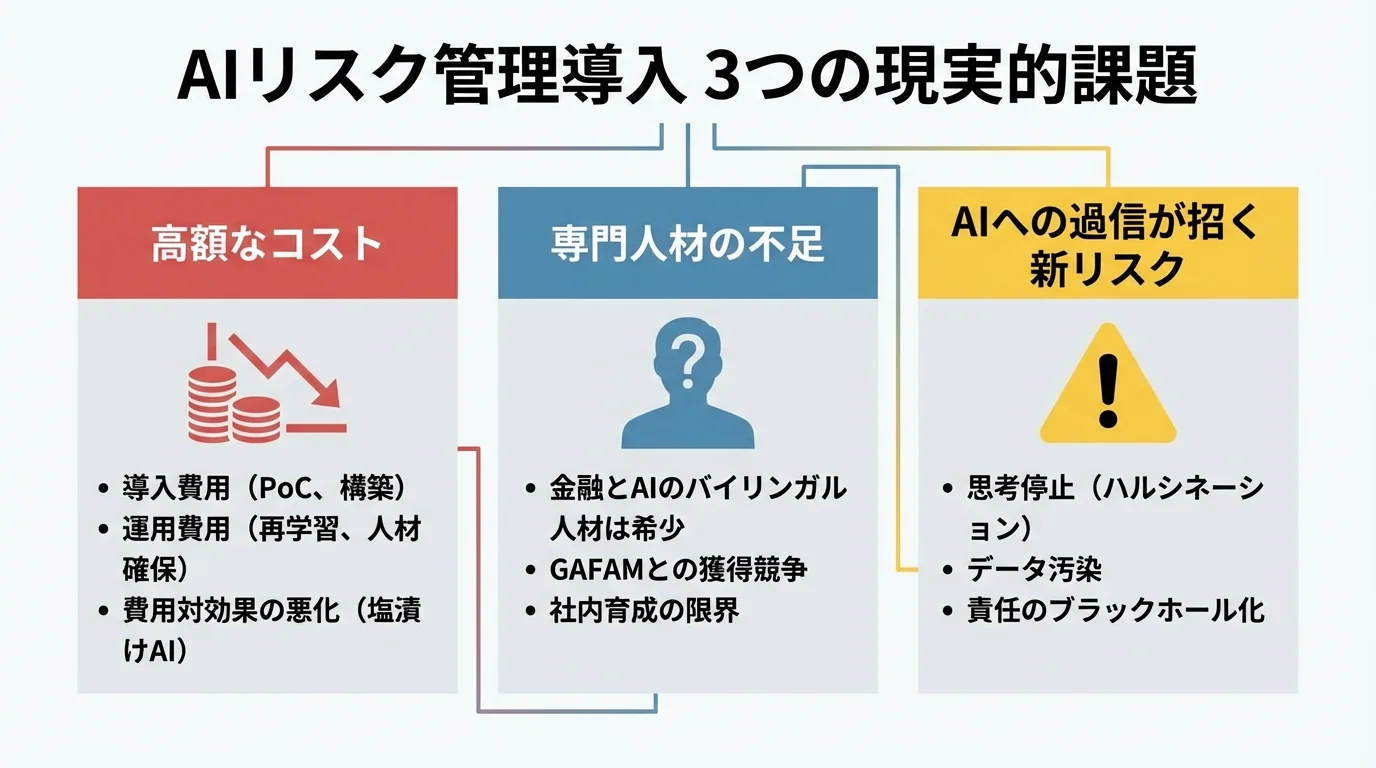

2026年、金融機関のリスク管理はAI導入が本格化し、もはや実験段階ではない。だが、メディアが喧伝する「AIによる高度化」という謳い文句を鵜呑みにするのは危険極まりない。その裏に潜む高額なコスト、AIを使いこなせる人材の絶望的な不足、そしてAIへの過信が招く新たなリスクといった不都合な真実から目を背けていないだろうか。この記事では、そうした幻想を打ち砕き、AI導入で後悔しないための現実的な課題と限界を徹底的にえぐり出す。

「本格化」の裏に潜む高額な導入・運用コスト

AI導入を語るベンダーが口にしたがらないのが、総所有コスト(TCO)という不都合な真実だ。ライセンス料やコンサル費用は序の口。概念実証(PoC)だけで数千万円を溶かし、いざ本格導入となれば、独自LLMの構築やセキュアな環境維持に億単位の投資が平然と要求される。本当に恐ろしいのは、導入後の運用コストである。モデルの精度を維持するための再学習、データ品質の管理、専門人材の確保に、毎年莫大な費用が垂れ流されるのだ。費用対効果が見合わず、ただサーバー代だけを払い続ける「塩漬けAI」と化したプロジェクトの屍を、一体いくつ見てきたことか。

AIを使いこなす専門人材は本当に確保できるのか

AIベンダーは「専門人材が必要だ」と軽々しく口にするが、その確保がいかに絶望的か語ることはない。AI技術と金融業務、双方を熟知したバイリンガル人材など、都合のいいスーパーマンは市場にいやしないのだ。経済産業省の試算では2030年にAI人材は12.4万人も不足する。年収数千万円を提示したところで、GAFAMとの熾烈な人材獲得競争に勝てるはずもないのが現実だ。ならば社内育成、という安易な結論も危険極まりない。数日間の研修で実務課題を解決できるほど、リスク管理の世界は甘くない。結局、育成コストを垂れ流し、中途半端な人材を量産するのがオチだろう。人材確保の戦略を描けないのなら、AI導入など机上の空論に過ぎない。

AIへの過度な期待が招く新たなリスクとは

AIを導入すれば全てが解決するという幻想は即刻捨てるべきだ。コストや人材の問題をクリアしたところで、より根深いリスクが口を開けて待っている。

筆頭に挙がるのが、AIの判断を鵜呑みにする思考停止のリスクだ。生成AIがもっともらしい嘘をつく「ハルシネーション」によって虚構の市場シナリオを信じ込み、誤った経営判断を下す。学習データ自体が汚染される「合成データ汚染」も現実の脅威となり、AIの結論はもはや検証不能な神託と化す。さらに、AIの自律判断が招く責任のブラックホール化も深刻である。AIが引き起こした損害の責任は誰が取るのか。この問いに答えられないまま導入を進めれば、リスク管理体制そのものが崩壊するだろう。

予測から自律防御まで!AIが可能にするリスク管理の高度化とは

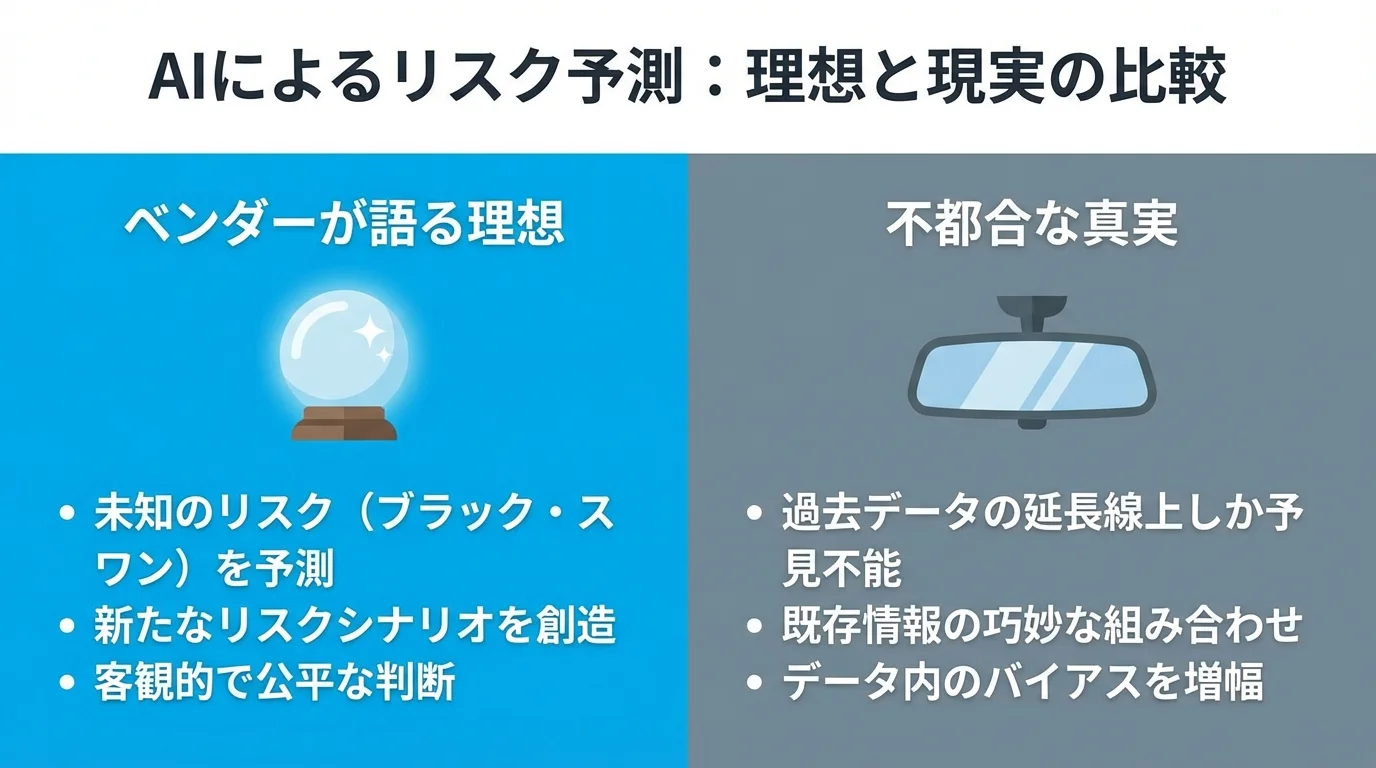

AIによるリスク管理は「予測」から「自律防御」へと進化し、AIエージェントが脅威をリアルタイムで防ぐという。確かに聞こえは良い。だが、そのAI予測が過去データの呪縛から本当に逃れられるのか。自律的な判断が、制御不能な暴走を招くことはないのか。このセクションでは、ベンダーが決して語りたがらない「高度化の代償」を白日の下に晒し、AIという名のブラックボックスに潜む本当のリスクを暴き出す。

AI予測は過去データの呪縛から逃れられるか

AIは過去にないリスクを予測できる――この甘美な謳い文句を信じるのは、もうやめにしないか。AIの予測は、所詮、過去データの焼き直しに過ぎない。リーマンショックやパンデミックのような、過去の延長線上にない真のブラック・スワンを予見できたAIなど存在しないのが現実だ。生成AIが描く「新たなリスクシナリオ」も、既存のニュースやレポートを巧妙に組み合わせた「もっともらしい虚構」でしかない。むしろ過去のデータに含まれる偏見やバイアスを忠実に学習し、差別的な与信判断を自動化するリスクの方がはるかに高い。AIは高性能なバックミラーであって、前方の崖を教えてくれる魔法の水晶玉ではないのだ。

AIの「自律判断」が招く新たなリスク

AIエージェントが脅威を検知し、自律的に防御する――。ベンダーが語るこの未来像は、制御不能な暴走のリスクと表裏一体だ。例えば、AIが正常な大口取引を「異常」と誤検知し、顧客に無断で取引を停止させたらどうなるか。その結果生じる莫大な機会損失と訴訟リスクの責任は、AIではなく導入を決定した人間が負うことになる。さらに深刻なのは、攻撃側のAIと防御側のAIが、人間の理解を超えた速度で攻防を繰り広げる未来である。このAI同士のサイバー戦争がシステム全体に予期せぬ負荷をかけ、市場を巻き込む大規模障害を引き起こす可能性を、一体どれだけの企業が想定できているだろうか。

高度化の代償、制御不能なブラックボックス化

AIの高度化がもたらす最大の悲劇、それが制御不能なブラックボックス化だ。ディープラーニングが弾き出した結論に、人間は「なぜ」と問うことすら許されない。融資を否決された顧客、取引を異常と判定された企業、そして規制当局に対し、「AIの判断根拠は我々にも不明です」と説明するつもりか。後付けの解釈を提示する「説明可能AI(XAI)」など、所詮はアリバイ工作に過ぎず、判断の説明責任を本質的に果たすものではない。誰も検証できない神託に経営の根幹を委ねる行為は、リスク管理の放棄そのものである。

【2026年最新】生成AIが実現する高度なリスクシナリオ分析

生成AIがニュースやレポートを読み解き、地政学リスクのような未知の脅威を予測する――。ベンダーが喧伝するこの未来像を、鵜呑みにしていないか。AIが描くシナリオが、既存情報の巧妙な焼き直しに過ぎないとしたら?このセクションでは、AIが生成する「もっともらしい虚構」の危険性、そしてその結論に至った根拠を誰も説明できないという致命的な欠陥を暴き出す。AIという名の神託に振り回される前に、その正体を見極める必要がある。

AIが描く「虚構のシナリオ」という罠

生成AIがニュース記事を読み解き、地政学リスクを予測する――。ベンダーが喧伝する夢物語を本気で信じているのか? その実態は、RAG(検索拡張生成)という技術でネット上の情報を切り貼りしただけの「もっともらしい作文」に過ぎない。AIは情報の真偽を判断できず、信憑性の低い陰謀論まがいの記事や偏ったレポートさえ、学習データとして平然と取り込むのだ。その結果、AIがもっともらしい嘘をつくハルシネーションが発生し、虚構のシナリオが生成される。それを鵜呑みにした経営陣が、地政学リスク対策として誤ったポートフォリオを組むといった致命的な判断ミスを犯す未来が、容易に想像できるだろう。AIのシナリオは思考の叩き台であり、神託ではない。

過去データにない「未知のリスク」は予測不能

AIが地政学リスクや気候変動といった「未知のリスク」を予測する――。この謳い文句は、技術の本質を理解していない者の詭弁か、悪質なベンダーの欺瞞に他ならない。AIは学習データに存在しない概念をゼロから創造することは不可能だ。つまり、過去のどの金融危機とも異なるメカニズムで発生するシステム崩壊や、量子コンピューティングを悪用した暗号解読のような真の「想定外」は、そもそもAIの思考の枠外にある。AIが生成する「新たなシナリオ」とは、結局のところ既存のリスク要因を巧妙に組み合わせただけの「既知の変奏曲」に過ぎないのだ。これを信じて的外れなストレステストを繰り返すことほど、無駄な投資はない。

生成されたシナリオの「なぜ」が説明できない

生成AIが導き出したリスクシナリオの妥当性を、あなたは自らの言葉で説明できるだろうか。ベンダーは「説明可能AI(XAI)」で判断根拠がわかると嘯くが、その実態は結論に影響を与えたキーワードをハイライトする程度の「後付けの言い訳」でしかない。規制当局から「なぜ、このシナリオが最も深刻だと判断したのか」と問われた際、「AIによれば、これらのニュース記事が重要だと判断されたからです」と答えるつもりか。それはリスク分析ではなく、単なるAIの出力結果の丸暗記だ。説明責任をAIに丸投げする行為は、リスク管理担当者としての職務放棄に他ならない。

不正検知を自動化!AIエージェントによるリアルタイム防御システム

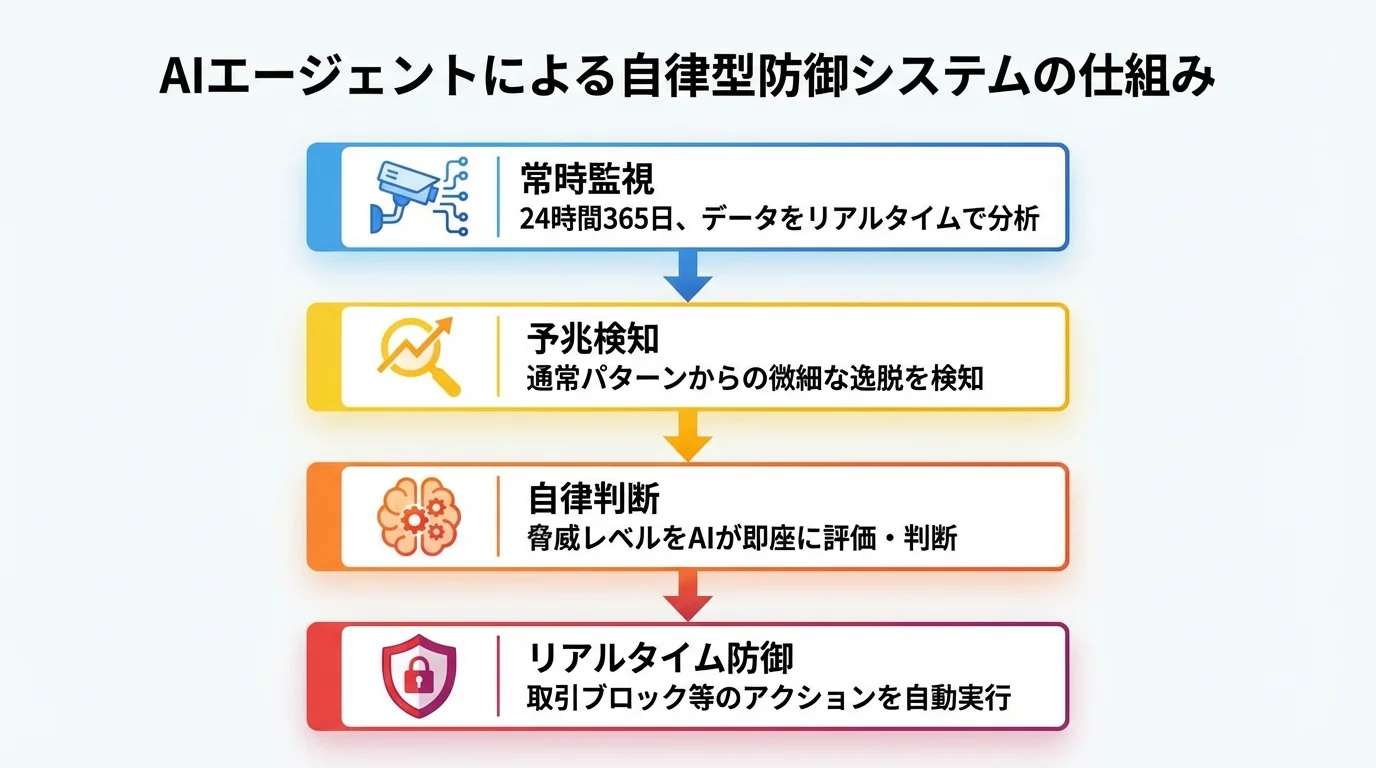

攻撃者も生成AIを悪用し、不正手口が巧妙化・自動化する現代において、もはや人間の目視や従来のルールベースの検知は限界を迎えています。この脅威に対抗するのが、24時間365日、システムを監視し続けるAIエージェントです。単に異常を検知するだけでなく、脅威の予兆を捉え、人間の判断を待たずにリアルタイムで防御アクションまで実行する――。本セクションでは、この自律型防御システムの具体的な仕組みと、プロアクティブな脅威対策の実態を解き明かします。

24時間365日稼働!AIによる常時監視システム

人間の目視や従来のルールベース監視では、担当者が不在の時間帯や未知の攻撃パターンに対応できないという致命的な弱点がありました。AIエージェントによる常時監視システムは、この問題を根本から覆します。このシステムは、24時間365日休むことなく、取引データや市場の動き、顧客の行動パターンといった膨大な情報をリアルタイムで分析し続けるのだ。静的なルールに縛られず、通常とは異なる微細な異常の兆候を自律的に検知するため、大きな脅威へ発展する前に警告を発することが可能である。これは、問題が起きてから対処する「事後対応」から、脅威を未然に防ぐ「事前予防」への転換を意味し、高度な金融AIのセキュリティ対策の根幹をなす技術だ。

あわせて読みたい

金融 AI セキュリティについて、導入方法から活用事例まで詳しく解説します。

脅威の予兆を検知するプロアクティブな防御

従来の防御が「不正発生後の検知」であったのに対し、プロアクティブな防御は攻撃の予兆を捉え、被害を未然に防ぐ思想に基づきます。AIエージェントは、個々の顧客の取引履歴やログインパターンといった「普段の振る舞い」を学習し、そこからの微細な逸脱をリアルタイムで検知するのだ。例えば、AIが悪用されたロマンス詐欺では、被害者の送金パターンに微妙な変化が現れる。こうした人間では見逃しがちな兆候を行動分析によって捉え、警告を発することができる。攻撃者もAIで手口を巧妙化させる以上、防御側もAIで対抗する以外に道はない。こうした背景には、深刻化する金融業界の生成AI導入リスクとはという課題が存在する。

あわせて読みたい

金融 生成AI リスクについて、導入方法から活用事例まで詳しく解説します。

自律判断でアクションを実行するAIエージェント

脅威の予兆を捉えるだけでは、もはや攻撃のスピードに追いつけないのが現実だ。攻撃者もAIを駆使して手口を自動化する以上、防御側も人間の判断を待たずにアクションを実行する自律型エージェントが不可欠になる。具体的には、不正と判断した取引の即時ブロックや疑わしいアカウントの一時凍結といった防御措置を、AIがリアルタイムで実行するのだ。もちろん、AIの暴走は許されないため、どのアクションをどの権限で実行するかを事前に定義し、そのプロセスを厳格に管理する金融AIガバナンスの課題とはをクリアしなければならない。これは単なる自動化ではなく、リスク管理の意思決定そのものをAIが担う、能動的な防御体制である。

あわせて読みたい

金融 AI ガバナンスについて、導入方法から活用事例まで詳しく解説します。

すでに導入が進む!金融機関におけるAIリスク管理の活用事例

メディアを賑わす「AI導入の成功事例」を、まさか鵜呑みにしてはいないか。その裏で一体どれだけのコストが垂れ流され、本当に費用対効果が見合っているのか語られることはない。本セクションでは、体力のある大手だからこそ可能な「見せかけの成功」に騙され、他社の事例を安易に模倣して失敗する罠を暴き出す。あなたの会社が後悔しないために、知っておくべき不都合な真実がここにある。

成功事例は体力のある大手企業限定か

メディアが報じる華々しい成功事例は、莫大な資金と人材を惜しみなく投入できるメガバンクの「ショーケース」に過ぎない。三菱UFJや三井住友の事例を鵜呑みにし、自社でも稟議書作成を自動化できると夢見るのは愚の骨頂である。データの量も質も、確保できる専門人材も全く異なるのだ。体力のない企業が背伸びして導入すれば、成果の出ない概念実証(PoC)を繰り返し、コンサル費用だけを垂れ流す「PoC貧乏」に陥るのが関の山だろう。年間数千万円のコストをかけて削減できる業務が、本当にそれだけの価値を持つのか。その問いに答えられないのなら、高価なAIより先に、まずは足元の業務プロセスを見直すべきだ。

華々しい導入事例と費用対効果の実態

メディアが報じる「業務効率化」という甘い言葉に騙されてはいけない。京都銀行の稟議書作成自動化、損保ジャパンの代理店評価――。聞こえは良いが、そのために年間数千万、数億円のコストを垂れ流す費用対効果を真剣に計算したことがあるだろうか。削減できる人件費と、AIのライセンス料や専門人材の維持コストを天秤にかければ、大赤字というケースが後を絶たないのが現実だ。「AI導入」というお題目が先行し、ROIの算出が後回しにされたプロジェクトの末路は悲惨である。そもそもAIでなければ解決できない課題なのか。安価なRPAや、地道な業務プロセスの見直しで十分なケースがほとんどではないか。お化粧された成功事例の裏に隠された、本当のコスト構造を見抜けなければ、あなたも「高コスト体質なDXごっこ」の犠牲者になるだけだ。

他社の事例模倣で陥る「導入失敗」の罠

他社の成功事例をなぞれば、自社でも同じ成果が得られるとでも思っているのか。その安易な思考こそが、導入失敗への最短ルートだ。失敗の根本原因は、自社が抱える課題の解像度が絶望的に低いことにある。他社がAIで解決した問題と、あなたの会社が直面している問題は、データ基盤も業務プロセスも全くの別物である。ショーケースの裏側にある泥臭いデータクレンジングや、部門間の利害調整といった「見えないコスト」から目を背け、表面的な成果だけを模倣すれば、機能不全に陥るのは当然の結果だ。まず真似すべきは華々しいAIツールではなく、自社の問題を徹底的に洗い出す地道なプロセスそのものである。

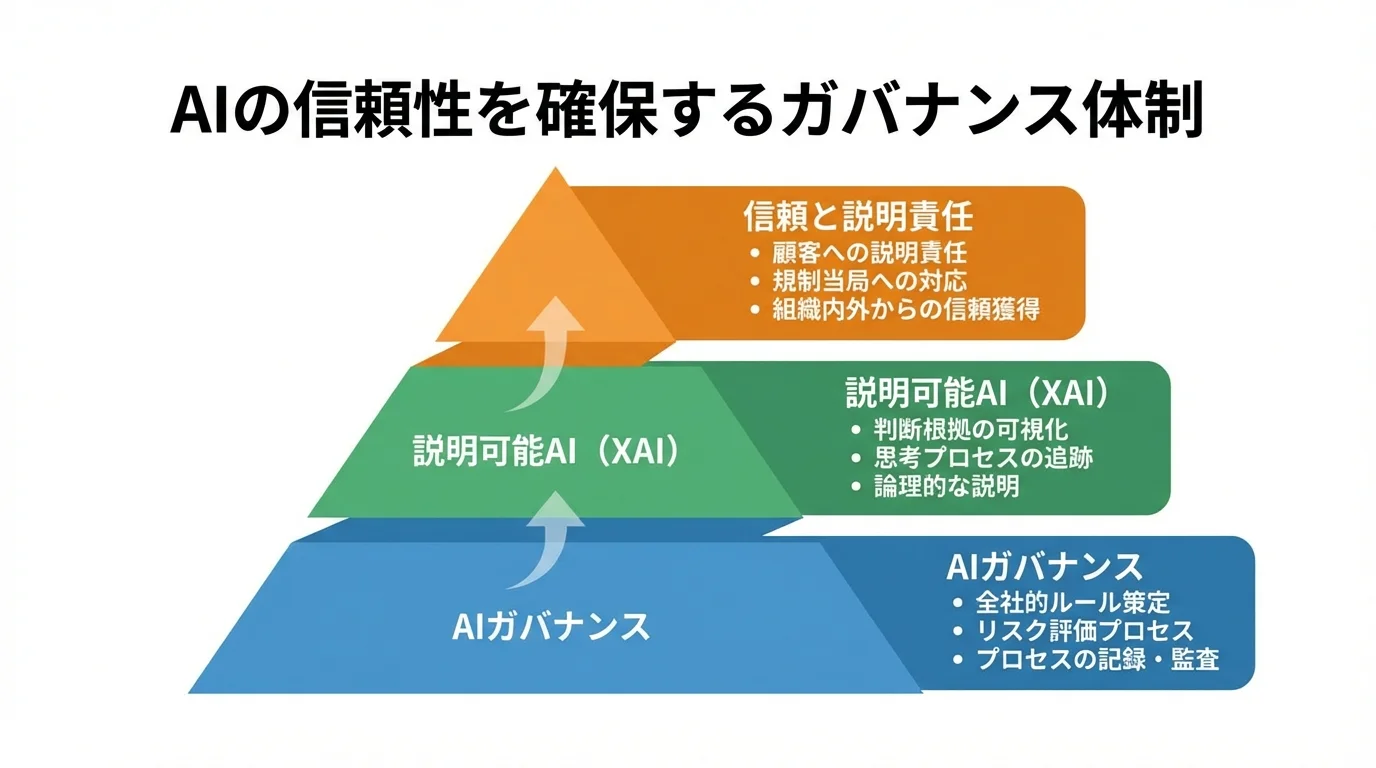

判断の透明性を確保する「説明可能AI(XAI)」とガバナンスの重要性

AIがなぜその結論を出したのか、誰にも説明できない──。そんな制御不能なブラックボックスに融資判断や不正検知を委ねる行為は、リスク管理の放棄に他なりません。この致命的な課題に対し、判断根拠を可視化する「説明可能AI(XAI)」の導入と、組織的な統制を効かせるAIガバナンスの構築が、今や規制当局からも厳しく求められています。AIへの信頼をいかに担保し、説明責任を果たすのか。その具体的な手法を解き明かします。

AIの判断根拠を示す「説明可能AI(XAI)」

AIによる融資否決や不正取引の判定に対し、「なぜそうなったのか」を説明できないのでは、リスク管理とは呼べない。この致命的な「ブラックボックス問題」に対し、AIの思考プロセスを可視化するのが説明可能AI(XAI)である。従来のXAIは、結論に影響した要素を示すだけの「後付けの言い訳」と揶揄されることもあった。しかし2026年現在、技術は進化し、意思決定プロセス全体を追跡・再構築することで、なぜ特定の取引が不正と判断されたのかを論理的に説明できるシステムが登場している。これは顧客や規制当局への説明責任を果たすための必須要件であり、厳格な金融AIガバナンスの課題とはをクリアする上での核心技術なのだ。

あわせて読みたい

金融 AI ガバナンスについて、導入方法から活用事例まで詳しく解説します。

規制当局も注視するAIガバナンス体制の構築

AIの導入は、もはや技術部門だけの課題ではない。特に金融庁や日本銀行といった規制当局は、AIの判断がブラックボックス化し、不公平な取引や説明不能な損失を生み出すことに強い警戒感を示している。実際に、日本銀行は2026年度の考査方針でAIのリスク管理体制を明確な点検項目に挙げた。これは、AIの利用に関する全社的なルール策定や、リスク評価プロセスの整備が、もはや努力目標ではなく必須要件になったことを意味する。こうした金融AIガバナンスの課題とは、単なる規制対応ではなく、AIという強力なエンジンを安全に制御し、企業価値を守るための生命線そのものなのだ。

あわせて読みたい

金融 AI ガバナンスについて、導入方法から活用事例まで詳しく解説します。

AIへの信頼を担保する意思決定プロセスの透明化

AIの判断がブラックボックスのままでは、顧客からも、そして自社の従業員からですら信頼は得られない。透明化とは、単にXAIツールを導入して「AIがこう判断しました」と後付けで説明することではないのだ。本当に重要なのは、意思決定プロセス全体のトレーサビリティを確保することである。なぜそのAIモデルを採用したのか、学習にどのデータセットを用いたのか、どのような検証を経て本番導入に至ったのか。これら一連のプロセスを全て記録し、誰でも監査できる状態に保つことこそが、真の透明性だ。この体制があって初めて、顧客や規制当局への説明責任を果たし、AIという強力な技術への信頼を組織的に担保できる。金融AIガバナンスの課題とはを考える上で、これは核心部分に他ならない。

あわせて読みたい

金融 AI ガバナンスについて、導入方法から活用事例まで詳しく解説します。

AIリスク管理の導入前に知っておくべき課題と注意点

AI導入の夢から覚める時間だ。メディアが語る成功事例の裏には、無視された数々の課題が積み上がっている。AIの精度を根底から揺るがすデータ品質という巨大な壁、そして導入後に必ず直面するAIモデルの性能劣化と、それを監視し続ける終わりのないコスト。これらを無視したままでは、高価な「お荷物」を抱えるだけだ。後悔しないために、導入前に知るべき現実的な課題を具体的にえぐり出す。

AIの精度を左右するデータ品質という壁

AIを導入すれば、散らかったデータも魔法のように整理される――。そんな幻想は即刻捨てるべきだ。「Garbage In, Garbage Out(ゴミを入れればゴミしか出てこない)」、これがAIの冷徹な現実である。部門ごとにサイロ化され、担当者ごとに表記が揺れる顧客データ、意味不明な欠損値だらけの取引情報をAIに投入して、まともな精度が出るはずもない。AIプロジェクトの予算と期間の8割が、この泥臭いデータクレンジングに消え、頓挫するのが典型的な失敗パターンだ。最新のAIツールに飛びつく前に、まずは全社的なデータガバナンス体制の構築という、地味で退屈な宿題を片付けることだ。それができなければ、AI導入など時期尚早に過ぎない。

AIモデルの性能劣化と継続的な監視コスト

AIモデルを一度導入すれば未来永劫、高精度を維持できるとでも思っているのか。その楽観的な見通しこそが、プロジェクトを失敗に導く最大の罠だ。市場環境や顧客の行動パターンは常に変化し、AIが学習した過去のデータは急速に陳腐化していく。この「コンセプト・ドリフト」と呼ばれる現象により、AIの予測精度は導入直後をピークに確実に劣化し続けるのだ。性能を維持するためには、専門チームによる常時監視と、数ヶ月に一度の再学習・再検証が不可欠になる。この終わりのない運用コストを初期投資に含めず、後から予算が付かずに放置された「ゾンビAI」を一体いくつ見てきたことか。この継続的な投資を覚悟できないのなら、最初から手を出すべきではない。

技術の進化に追いつかない規制対応の課題

AIベンダーは「規制対応済み」と嘯くが、その保証は明日には紙くずと化すのが現実だ。猛スピードで進化するAI技術に対し、法律や規制は常に後出しジャンケンで追いかけてくる。あなたの会社が導入したそのAIは、来年施行されるEUのAI規制法で「高リスク」に分類され、利用が事実上不可能になるシナリオを想定しているか。日本銀行が2026年度の考査でようやくAI管理体制を点検項目に挙げたように、当局の対応は常に後手なのだ。その結果、現場は規制が変わるたびにシステム改修を強いられ、終わりのないコンプライアンスコストを垂れ流す羽目になる。この動的なリスクを織り込まずに導入計画を立てるのは、あまりに無謀である。

まとめ

金融リスク管理の未来は、もはやAIの活用なくして語れません。本記事で見てきたように、生成AIによる高度なシナリオ分析や、AIエージェントによるリアルタイムの不正検知は、複雑化・高速化する脅威から組織を守るための不可欠な技術です。単なる業務効率化に留まらず、これまで予測不可能だったリスクの兆候を捉え、自律的に防御する体制を構築します。

もちろん、AI導入には判断の透明性を担保する説明可能AI(XAI)の導入や、ガバナンス体制の構築といった課題も存在します。しかし、これらの課題に正面から向き合い、計画的に導入を進めることが、これからの金融業界で生き残るための重要な経営判断となるでしょう。まずは自社の現状を正確に把握し、どこからAI活用を始めるべきか、具体的なロードマップを描いてみませんか。

OptiMaxでは、貴社のセキュリティ体制やITインフラを評価した上で、最適なAI活用の無料診断を行っています。セキュアなAI活用ロードマップの作成や、社内規程を学習させたAIチャットボット(RAG)のプロトタイプデモもご案内可能です。ぜひこの機会をご活用ください。