金融AI活用が加速する背景と無視できない「チャレンジしないリスク」

金融業界では、業務効率化や顧客サービスの向上を目的としたAIの活用が急速に進展しています。 厳しい市場競争や顧客ニーズの多様化といった背景から、AI導入はもはや選択肢ではなく、企業の競争力を左右する重要な経営課題です。 しかし、セキュリティや倫理面のリスクを懸念するあまり導入に踏み出せないでいると、業務の属人化や生産性の低下を招き、「チャレンジしないリスク」に直面しかねません。本章では、金融AIの活用が加速する背景と、今AIに取り組まないことがいかに大きなリスクとなるかについて解説します。

厳格なセキュリティ下でAI活用の選択肢が拡大

金融業界において、顧客情報などの機密データを扱う上で厳格なセキュリティは最重要課題です。 これまで、多くの金融機関では情報漏洩リスクを懸念し、生成AIの本格的な活用に踏み出せない状況がありました。

しかし、技術の進展により、セキュリティを担保しながらAIを活用する選択肢が大きく広がっています。具体的には、外部のネットワークから遮断されたオンプレミスやVPC(仮想プライベートクラウド)といったクローズドな環境で、独自のLLM(大規模言語モデル)を構築・運用する手法です。 これにより、機密情報が外部に漏れるリスクを遮断し、安全なAI活用が実現できます。

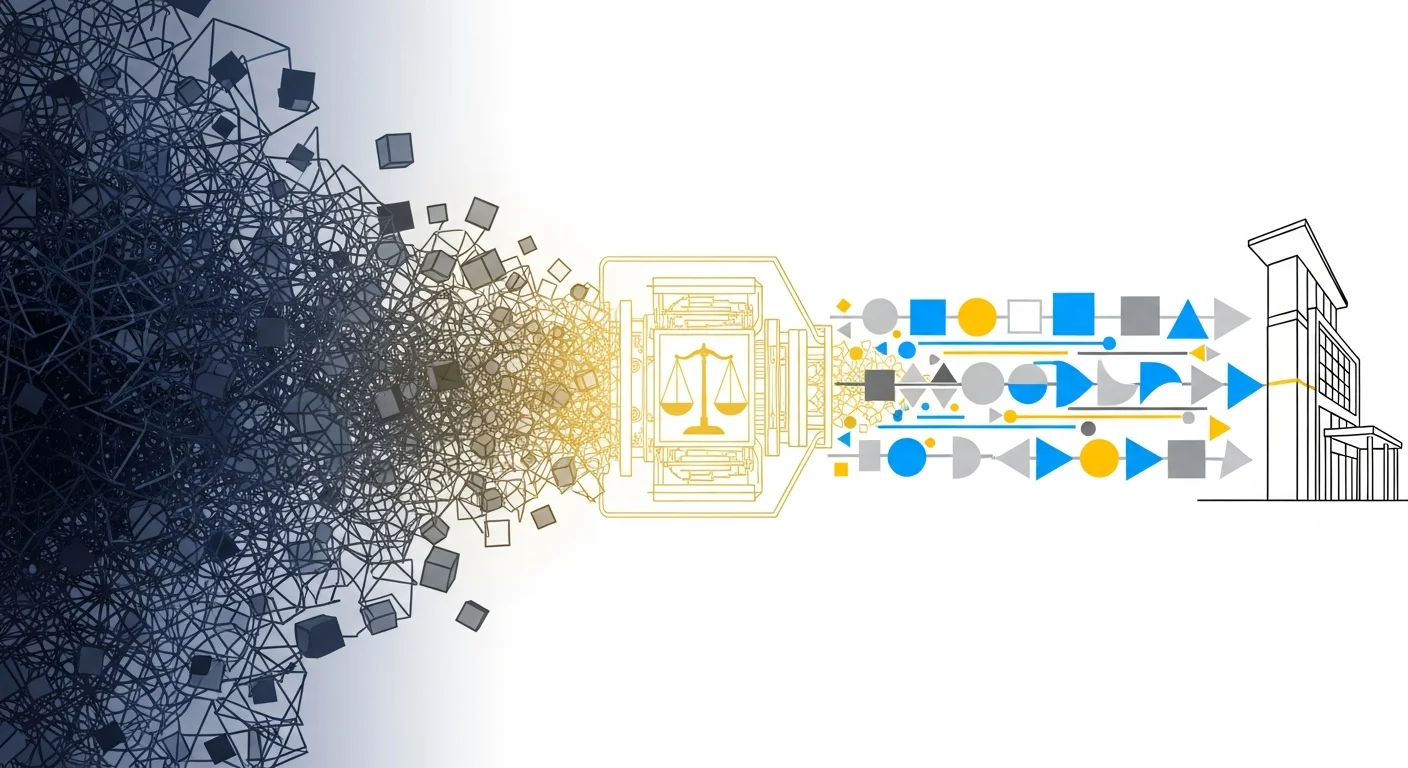

さらに、RAG(Retrieval-Augmented Generation)という検索技術を組み合わせることで、膨大な社内規程やマニュアルの中から、AIが正確な情報をリアルタイムで探し出し、回答を生成することが可能になります。 この仕組みを活用すれば、属人化しがちな業務の標準化や、顧客対応の迅速化といった具体的な成果が期待できるのです。

属人化が招く機会損失とコンプライアンスリスク

金融機関において、特定のベテラン行員の経験や勘に依存する「属人化」は、見過ごせない経営リスクです。 担当者不在時に顧客対応が遅延し、貴重なビジネスチャンスを逃す「機会損失」は典型的な例です。さらに深刻なのが、個人の解釈で業務が進むことで生じる「コンプライアンスリスク」です。 担当者ごとに判断基準が異なれば、金融商品販売時の説明義務違反や、融資審査における不公平な判断につながる恐れがあります。 こうしたリスクを回避し、組織全体のサービス品質を標準化するためには、AIを活用して暗黙知となっているノウハウを形式知化し、組織全体でナレッジを共有する仕組みが不可欠です。

専門家と始めるセキュアなAI導入の第一歩

金融AIの導入において、倫理的課題やセキュリティへの懸念は避けて通れない障壁です。その第一歩として、金融ドメインに精通した専門家との連携が極めて重要となります。まずは、顧客情報などの機密データを外部に出さないクローズドな環境(オンプレミス・VPC)でAIを構築できるかどうかが最初の分岐点です。さらに、AIが誤情報を生成する「ハルシネーション」のリスクを抑えるためには、高度なRAG(検索拡張生成)技術が不可欠です。信頼できる専門家パートナーは、現状のITインフラに基づいたセキュアなAI活用の無料診断やロードマップ作成を支援してくれます。まずは自社の課題を専門家と共に可視化することから始めてみましょう。

金融AIが直面する5つの主要な倫理課題と規制の最新動向

金融業界でAIの活用が加速する一方、その判断に潜むバイアスや透明性の欠如といった倫理的な課題が大きな障壁となっています。 これらのリスクを放置すれば、企業の信頼を揺るがしかねません。本セクションでは、金融AIが直面する5つの主要な倫理課題を具体的に解説し、EUのAI法など国際的な規制の最新動向を紐解きます。 厳格なセキュリティを確保しつつ、これらの課題を乗り越えるための実践的なアプローチを探ります。

公平性の担保:AI判断に潜むデータバイアスの危険性

金融AIは、過去の膨大なデータを学習して判断を行いますが、そのデータ自体に人間の無意識な偏見が含まれていると、AIもその偏見を学習・増幅させてしまう「データバイアス」が生じます。 例えば、融資審査において過去のデータに基づき、特定の属性を持つ個人に不当に不利な判断を下す可能性があります。 これは顧客の不利益に直結し、企業の信頼を損なうだけでなく、差別を禁じる法規制に抵触する重大なリスクとなります。 このようなリスクを回避するには、AIの判断根拠を人間が理解できる「説明可能性(XAI)」の確保が不可欠です。 金融ドメインに精通した専門家による継続的なモデルの監視と、セキュリティが担保された環境下での公平性の検証が、倫理的なAI活用を実現する鍵となります。

偽情報のリスク:AIの嘘(ハルシネーション)と法的責任

AIが事実に基づかない情報を生成するハルシネーションは、金融業界において顧客の資産に直接影響を及ぼしかねない重大なリスクです。 例えば、AIが誤った金融商品の説明や不正確な市場分析を出力し、それに基づいて顧客対応を行えば、金融商品取引法などに抵触し、企業が法的責任を問われる可能性があります。 このようなリスクを抑制するためには、AIの回答を鵜呑みにせず、最終的には人間の判断を介在させることが不可欠です。 さらに、社内規程やマニュアルといった信頼性の高い情報源のみをAIに参照させるRAG(検索拡張生成)技術の活用も有効な対策となります。 専門家による精度調整が施されたセキュアな環境でAIを運用することが、リスク管理の鍵となります。

金融庁も注視する国内外のAIガバナンスと規制の枠組み

金融分野でのAI活用が加速する中、金融庁は「金融分野におけるAI活用に関する原則」などでAIガ-バナンスの重要性を強調しています。 不正検知や業務効率化が期待される一方、誤情報(ハルシネーション)やデータの偏りが重大なリスクになり得るためです。

国際的にも規制の枠組み作りは進んでおり、特にEUでは世界初の包括的な法律である「AI法(AI Act)」が成立しました。 この法律はリスクに応じてAIを分類し、高リスクなシステムには厳しい要件を課すもので、EU域外の企業にも影響を及ぼす可能性があります。

こうした国内外の動向を踏まえ、金融機関にはセキュリティを確保したクローズドな環境でのAI開発・運用が不可欠です。 専門家の支援のもと、情報の正確性を担保する高度なRAG(検索拡張生成)技術などを活用し、規制を遵守しながらAIの恩恵を最大化する体制構築が、今後の競争力を左右する鍵となるでしょう。

倫理だけではない、情報漏洩やサイバー攻撃など金融AIのセキュリティリスク

金融分野でのAI活用は業務効率化に大きく貢献する一方、倫理的な課題以上に直接的なセキュリティリスクへの対策が急務です。 顧客の機密情報や資産を扱う金融機関にとって、悪意のあるデータをAIに学習させる「データ汚染」や、AIを悪用したサイバー攻撃による情報漏洩は、事業の根幹を揺るがしかねない重大な脅威となります。 本セクションでは、金融AIに潜む具体的なセキュリティリスクと、セキュアな環境でAI活用を進めるための対策について詳しく解説します。

巧妙化するサイバー攻撃、AIモデルへの脅威

従来のファイアウォールや侵入検知システムだけでは防ぎきれない、AIモデルそのものを標的とした新たなサイバー攻撃が金融業界の脅威となっています。 例えば、AIの判断を誤らせるためにデータへ微細なノイズを加える「敵対的攻撃」や、学習データに意図的に悪意のある情報を注入する「データ汚染(ポイズニング)」といった手法です。

これらの攻撃は、融資審査AIを騙して不正な承認を引き出したり、市場予測モデルを混乱させたりするなど、金融機関の信用の根幹を揺るがしかねない深刻なリスクをはらんでいます。 攻撃者もまたAIを活用し、より巧妙な攻撃を仕掛けてくるため、これまでのセキュリティ対策の延長線上では対応が困難です。 こうした脅威に対抗するには、AIモデル自体の脆弱性に対応したセキュリティ設計が不可欠であり、外部から隔離されたクローズドな環境(オンプレミス・VPC)でのAI構築は、不正なアクセスやデータ混入のリスクを低減する極めて有効な一手となります。

プロンプトインジェクションによる情報漏洩リスク

プロンプトインジェクションとは、悪意のある指示(プロンプト)をAIに与えることで、開発者が意図しない動作をさせ、機密情報を盗み出すサイバー攻撃です。 金融機関において、顧客情報や未公開の市場分析データなどをAIが扱う場合、この攻撃によって重大な情報漏洩に繋がる危険性があります。

基本的な対策として入力内容のフィルタリングなどがありますが、巧妙化する攻撃を完全に防ぐことは困難です。より本質的な対策として、インターネットから隔離されたクローズドな環境(オンプレミスやVPC)でAIシステムを構築することが極めて有効です。 これにより、外部からの不正なアクセス経路を遮断し、情報漏洩のリスクを根本から低減できます。 金融機関の厳格なセキュリティ要件を満たすためには、専門家の支援のもと、セキュアなAI活用環境を設計することが不可欠です。

データを守る要、閉域網・VPC環境の重要性

金融AIは顧客の機密情報や膨大な取引データを扱うため、その活用には極めて高いレベルのセキュリティが求められます。 一般的なクラウドAIサービスはインターネット経由での利用が前提であり、常に情報漏洩やサイバー攻撃のリスクに晒されています。

そこで不可欠となるのが、閉域網やVPC(Virtual Private Cloud)環境の活用です。 これらはインターネットから論理的に分離されたセキュアなネットワーク空間であり、いわば「社内専用のAI環境」を構築するアプローチです。 この環境下でAIやLLM(大規模言語モデル)を運用することで、外部からの不正アクセスを遮断し、機密情報を守りながら安全にAIの高度な分析能力を活用することが可能になります。金融機関の厳格なセキュリティ要件を満たし、競争力を維持するためにも、こうしたクローズドな環境でのAI実装が成功の鍵を握ります。

秘訣は「高精度RAG」と「クローズド環境」、セキュリティと活用を両立する方法

金融業界でAIの活用を進める上で、情報漏洩のリスクやコンプライアンスは避けて通れない倫理的な課題です。厳格なセキュリティ要件を満たしつつ、業務効率化を実現するにはどうすればよいのでしょうか。その鍵となるのが、AIの回答精度を高める「高精度RAG」と、セキュアな「クローズド環境」の構築です。本章では、この2つの技術を組み合わせ、安全性と利便性を両立させる具体的な方法を解説します。

閉じた環境で実現する最高水準のAIセキュリティ

金融機関が生成AIの導入をためらう最大の要因は、顧客情報や経営情報といった機密データの漏洩リスクです。この課題を根本的に解決するのが、インターネットから隔離された「閉じた環境」でのAIシステム構築です。具体的には、自社内にサーバーを設置するオンプレミスや、クラウド上のプライベートなネットワーク空間であるVPC(Virtual Private Cloud)内でLLM(大規模言語モデル)を動作させます。これにより、機密データを外部に送信することなく安全にAIで処理できるため、情報漏洩のリスクを原理的に遮断できます。最高水準のセキュリティを担保しながら、社内規定の検索や審査業務の高度化といったAI活用を推進することが可能になるのです。

AIの「嘘」を防ぐ、次世代の「高精度RAG」技術

生成AIが時折、事実と異なる情報を生成する「ハルシネーション(嘘)」は、特に正確性が求められる金融業界において重大なリスクとなります。 この課題への解決策として注目されているのが、次世代技術「高精度RAG(Retrieval-Augmented Generation)」です。

RAGは、AIが回答を生成する際、インターネット上の不確かな情報ではなく、企業が指定した社内規程やマニュアルといった信頼性の高い情報源のみを検索・参照する仕組みです。 これにより、ハルシネーションを大幅に抑制し、根拠の明確な回答を生成できます。 特に「高精度RAG」では、検索技術の専門家がチューニングを行うことで、問い合わせ内容に対してより的確な情報を抽出し、回答の精度を極限まで高めます。この技術により、金融機関は顧客対応の迅速化や審査業務の標準化を、倫理的かつセキュアに実現できるのです。

専門家が伴走する、失敗しないAI活用プロジェクト

金融機関におけるAIプロジェクトは、厳格なセキュリティ要件やコンプライアンス、そして既存システムとの連携など、特有の課題が多く存在します。 技術の導入自体が目的化し、現場で活用されずに終わるケースも少なくありません。

失敗しないAI活用を実現するには、構想段階から実装、現場への定着までを一気通貫で支援する専門家の伴走が不可欠です。例えば、社内規定の検索AIを構築する際、専門家はセキュアなクローズド環境(VPC)での実装を主導し、情報漏洩リスクを遮断します。さらに、AIが誤った情報を生成する「ハルシネーション」を抑制する高精度なRAG(検索拡張生成)技術を用いることで、回答の信頼性を担保します。

導入後も、行員向けの研修を通じて現場での「使いこなし」を支援し、AIを真の業務効率化ツールへと昇華させることが、プロジェクト成功の鍵となります。

【事例】規定・マニュアル検索から審査高度化まで。金融AIが生む業務変革

金融業界でAI活用が重要視される一方、「セキュリティリスクが懸念」「具体的な活用法がわからない」といった理由で導入に踏み出せない企業も少なくありません。 しかし、AIは膨大な社内規定・マニュアル検索の時間を大幅に削減したり、属人化しがちな審査業務を高度化・標準化したりと、金融機関の業務を大きく変革する可能性を秘めています。 本章では、厳格なセキュリティを確保しつつ、業務効率化とサービス品質向上を両立する金融AIの具体的な活用事例を解説します。

問い合わせ対応を迅速化するAI規定検索システム

金融機関の顧客対応では、複雑な規定集から迅速かつ正確に回答することが求められます。しかし、マニュアルの検索に時間がかかり、顧客満足度の低下やコンプライアンスリスクに繋がるケースは少なくありません。

そこで有効なのが、AIを活用した規定検索システムです。このシステムはRAG(Retrieval-Augmented Generation)という技術を用い、膨大な社内文書から質問の意図に沿った回答を根拠と共に瞬時に提示します。

特に金融業界では、セキュリティを担保するためにVPCなどのクローズドな環境でシステムを構築することが不可欠です。AIが誤情報を生成するハルシネーションを抑制する高精度な技術を選び、コンプライアンスを遵守した倫理的なAI活用を実現することで、行員は本来の顧客対応に集中できるようになります。

AIによる審査業務の標準化と属人化リスクの解消

金融機関における融資や保険の引受審査は、担当者の経験則に依存しやすく、属人化が長年の課題でした。これにより審査基準にばらつきが生じ、公平性という倫理的な観点からもリスクをはらんでいます。

AIを活用することで、過去の膨大な審査データや規定を学習し、客観的な基準に基づいた審査業務の標準化が可能です。AIが判断の根拠を提示することで、経験の浅い担当者でもベテランに近い水準の判断を迅速に行えるようになります。

これにより、業務効率化はもちろん、審査品質の均一化と高度化を実現します。機密情報を扱うため、セキュリティが確保されたクローズドな環境でAIを運用することが、金融機関の信頼性を守る鍵となります。

閉域網で実現するセキュアなAI活用とデータ保護

金融機関が生成AIを活用する上で最大の障壁となるのが、情報漏洩リスクです。 顧客の個人情報や機密情報といったセンシティブなデータを扱うため、外部のクラウドサービス利用には慎重にならざるを得ません。

この課題を解決する有効な手段が、インターネットから切り離された閉域網でのAI環境構築です。オンプレミスやVPC(Virtual Private Cloud)といったクローズドな環境にLLM(大規模言語モデル)を構築すれば、機密データを外部に出すことなく安全にAIを活用できます。 これにより、外部からのサイバー攻撃や意図しない情報流出のリスクを極小化し、厳格なセキュリティ要件を満たしながらデータ保護とAIによる業務革新を両立することが可能になります。

専門家と進める、失敗しない金融AI導入と現場への定着ステップ

金融分野でのAI活用は、倫理的課題や厳格なセキュリティ要件が障壁となりがちです。しかし、専門家と連携し計画的に進めることで、失敗のリスクを大幅に軽減できます。本章では、AIを安全に導入し、現場の業務変革を実現するまでの具体的なステップを解説。導入後に形骸化させないための「現場への定着」の秘訣もご紹介します。

失敗を防ぐ、導入目的の明確化と費用対効果の試算

金融AIの導入プロジェクトが失敗に終わる典型的な例として、「AIを導入すること」自体が目的化してしまうケースが挙げられます。 こうした事態を避けるため、まずは「AIでどの業務課題を、どのように解決したいのか」という目的を具体的に定義することが不可欠です。 例えば、「膨大な規定集から該当箇所を探す時間を8割削減し、顧客対応を迅速化する」「属人化している融資審査の判断基準を標準化し、リスク管理を強化する」といったように、明確なゴールを設定します。

次に、その目的が達成された際の費用対効果を試算します。 ここで重要なのは、人件費などの直接的なコスト削減額だけでなく、顧客満足度の向上やコンプライアンス強化といった、金額換算しにくい「定性的な価値」も評価に含めることです。 こうした目的設定やROI(投資対効果)の試算は、専門家の知見を借りながら進めることで、より現実的で精度の高い計画を立てることが可能になります。

高精度RAGで実現する、セキュアな業務特化AI

金融機関でのAI活用において、セキュリティリスクと回答の正確性は避けて通れない倫理的課題です。そこで注目されるのが、検索拡張生成(RAG)という技術です。RAGは、インターネット上の不確かな情報源ではなく、企業が管理するクローズドなデータベースや社内規定のみを参照して回答を生成します。 これにより、機密情報の漏洩を防ぎつつ、AIがもっともらしい嘘をつく「ハルシネーション」のリスクを大幅に抑制できます。

例えば、VPC(仮想プライベートクラウド)のようなセキュアな環境にRAGを実装すれば、膨大な金融商品の規定やコンプライアンス文書の中から、顧客の質問に対して正確な根拠に基づいた回答を瞬時に提示する業務特化AIを構築できます。 これにより、業務の属人化を防ぎ、より安全で質の高い顧客対応の実現につながります。

専門家の伴走と研修で、現場でのAI活用を定着へ

AIツールを導入しても、現場で「使われない」という課題は少なくありません。 特に金融機関では、セキュリティや倫理的な懸念から、職員が利用に踏み切れないケースが見られます。 こうした状況を打開するには、金融業務に精通した専門家による伴走支援が不可欠です。専門家が現場の課題をヒアリングし、具体的な活用法を提示することで、実務レベルでのAI活用がスムーズに進みます。さらに、職員一人ひとりがAIを「使いこなす」ための実践的な研修も極めて重要です。 例えば、意図した情報を正確に引き出す「プロンプトエンジニアリング研修」は、AIの利用精度を高め、誤情報のリスクを低減させます。 専門家による継続的なサポートと体系的な研修を通じて、AIへの心理的ハードルを下げ、全社的な活用と定着を成功へと導きます。

まとめ

金融AIの活用は、もはや避けて通れない経営課題であり、競争優位性を築く上で不可欠です。本記事で見てきたように、AIは業務効率化に大きく貢献する一方、データの偏りによる不公平な判断や、意思決定プロセスの不透明性といった「金融AIの倫理」に関する課題と常に向き合う必要があります。

これらの倫理的・セキュリティ的リスクを克服し、AIの恩恵を最大限に引き出す秘訣は、クローズドな環境で、誤情報を抑制する「高精度RAG」を実装することです。 まずは専門家と共に、自社のセキュリティ要件や課題を明確にし、安全なAI活用の第一歩を踏み出してみてはいかがでしょうか。