生成AIの悪用も背景に なぜ今、不正検知AIが求められるのか

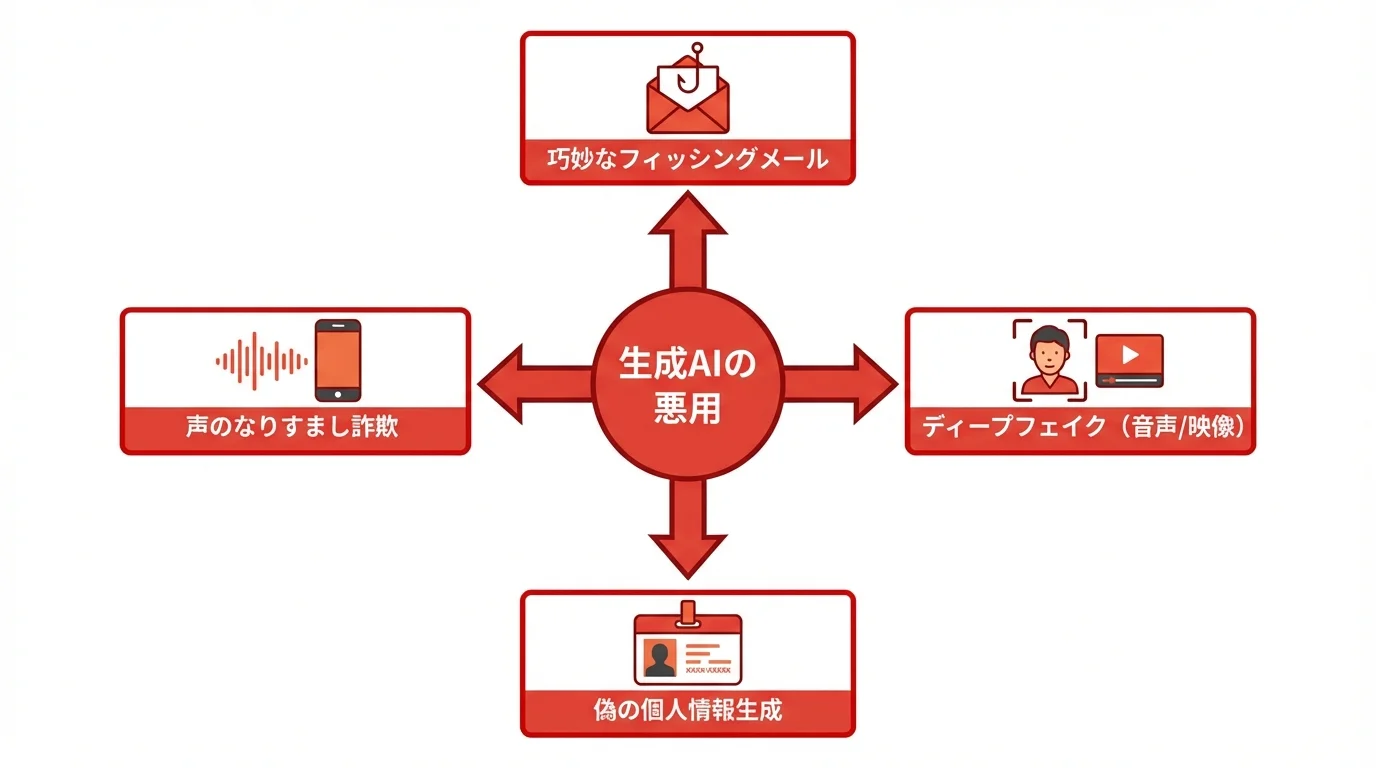

近年、サイバー攻撃や不正の手口はますます巧妙化しています。その背景には、攻撃者による生成AIの悪用があります。本物と見分けがつかないフィッシングメールや、音声・映像を偽造するディープフェイクなど、AIを使った脅威が現実のものとなっているのです。こうした高度な攻撃には従来の対策では対抗が難しく、リアルタイムで異常を検知する不正検知AIの重要性が急速に高まっています。本章では、なぜ今、不正検知AIが不可欠なのか、その理由を最新の動向と共に解説します。

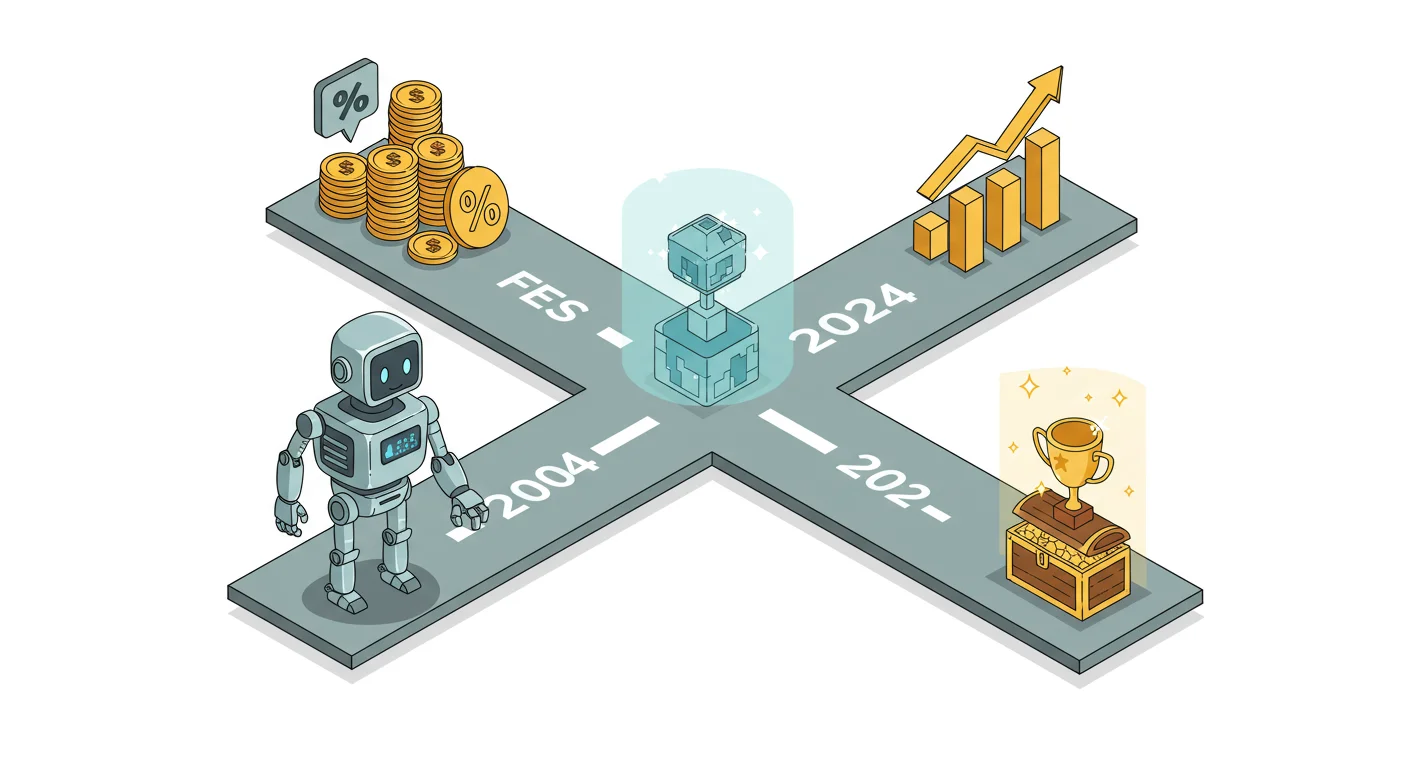

生成AIを悪用したサイバー攻撃の巧妙化

生成AIの登場は、サイバー攻撃の手口をかつてないほど巧妙化させています。攻撃者は生成AIを悪用し、文法的に自然で説得力のあるフィッシングメールを大量に自動生成するだけでなく、ディープフェイク技術で本人そっくりの音声を合成した「声のなりすまし詐欺」なども仕掛けてきます。さらに、本物と見分けがつかない偽の個人情報パッケージを数分で作成することも可能です。このようなAI駆動型の攻撃は、従来の静的なルールベースの検知システムでは見抜くことが極めて困難です。まさに「AI対AI」の攻防が激化しており、防御側もAI行動分析のような、より高度なAI技術で対抗することが不可欠となっています。

ディープフェイクなど新たな不正手口の出現

生成AIの悪用は、不正手口を新たな次元へと引き上げています。特に深刻なのが、ディープフェイク技術を用いたなりすましです。AIによって生成された本物そっくりの音声や映像は、従来の本人確認プロセスを容易に突破する脅威となっています。例えば、音声クローン技術を悪用した「オレオレ詐欺」や、オンラインでの本人確認(eKYC)を偽の動画で突破する手口がすでに出現しています。

これに対抗するため、防御側もAIを活用した対策を急いでいます。2026年には、NTT東日本が高精度な音声フェイク検知技術を開発するなど、リアルタイムで音声や映像を分析し、なりすましを見破るソリューションが登場。人の目や耳では判別困難なレベルの偽造を見抜くには、もはやAIの力が不可欠です。こうした背景から、AI声紋認証のような技術への注目も高まっています。

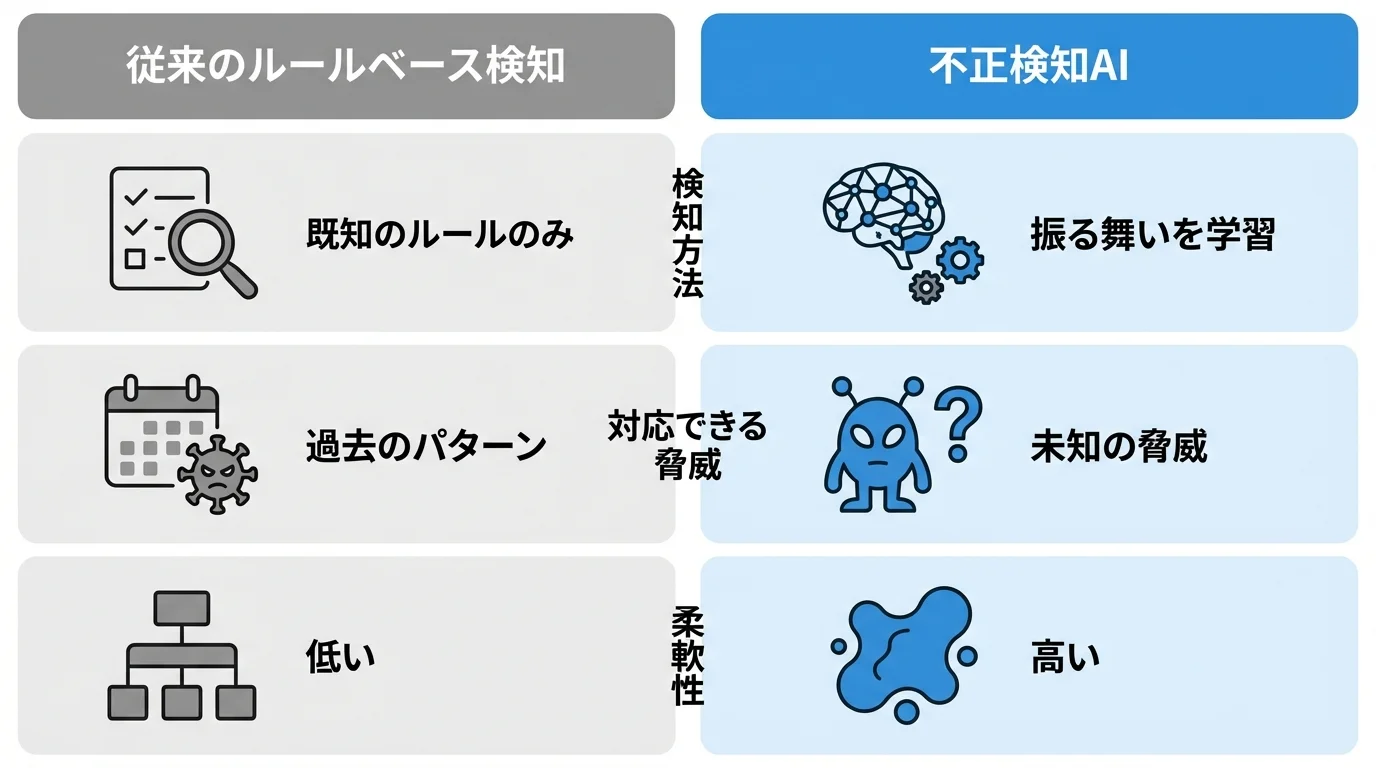

未知の脅威を予測する検知モデルの高度化

従来のルールベース検知では、過去の事例に基づかない未知の脅威への対応が困難でした。しかし、最新の不正検知AIは、生成AIを活用して未知の攻撃シナリオを自らシミュレーションし、検知モデルの堅牢性を高めるアプローチへと進化しています。AIが攻撃者の視点で新たな手口を仮想的に生み出すことで、まだ見ぬ脅威に先回りして備えることが可能です。また、ユーザーの平時の行動パターンを学習し、そこからの逸脱を捉えるAI行動分析も高度化しており、振る舞いの異常から未知の不正の兆候を早期に発見します。これにより、後手に回らないプロアクティブな防御体制の構築が実現します。

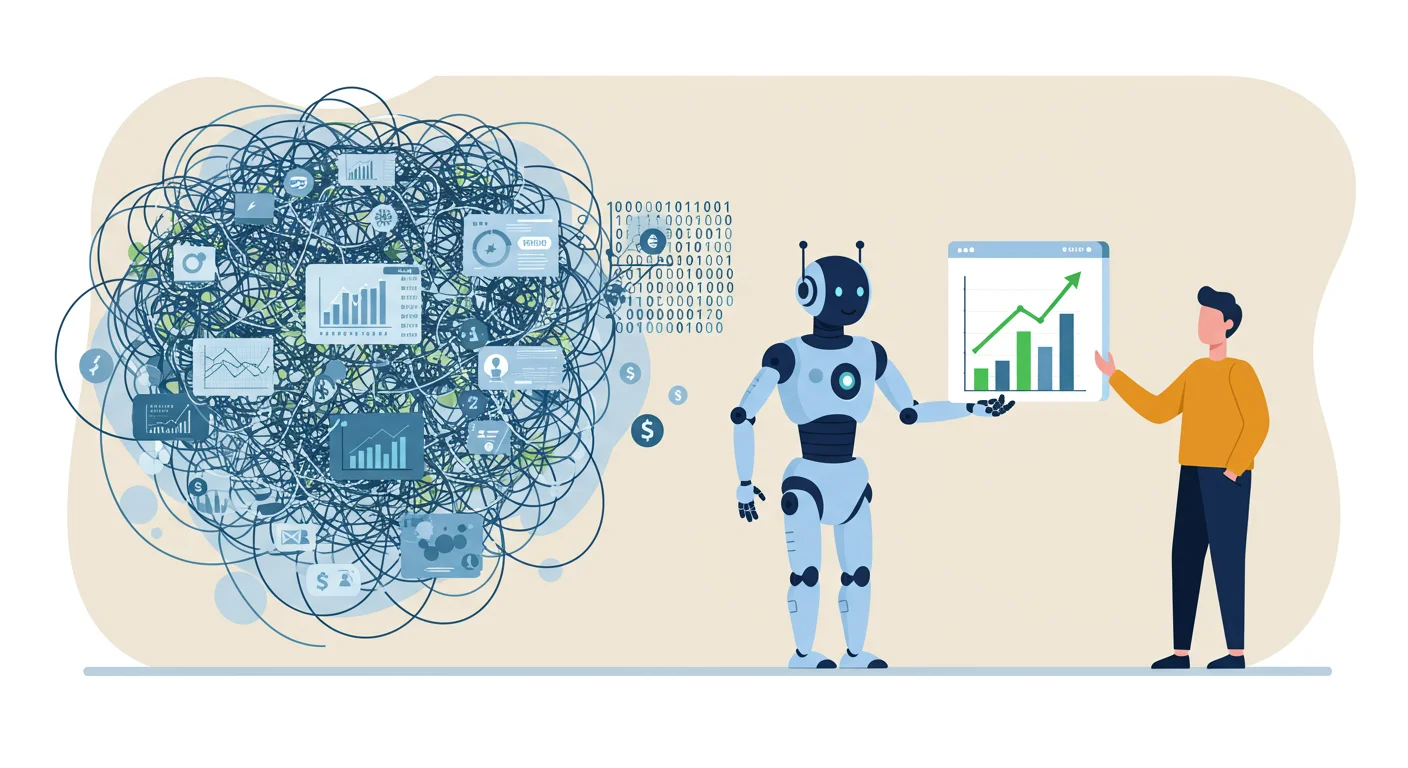

不正検知AIとは?ルールベースを超えるリアルタイム分析の仕組み

巧妙化する不正手口に対抗する「不正検知AI」とは、AIがリアルタイムで膨大なデータを分析し、不正の兆候を検知するシステムです。あらかじめ設定されたルールのみで判断する従来のルールベース方式とは異なり、ユーザーの平時の振る舞いを学習し、そこからの逸脱を異常として捉えます。本章では、この動的な分析の仕組みから、AIの判断根拠を示す「説明可能AI(XAI)」の統合、生成AIを活用した最新の検知モデルまで、その核心に迫ります。

生成AIを活用し巧妙化する不正手口に対抗

近年、攻撃者も生成AIを悪用し、不正手口はかつてないほど巧妙化しています。人間では見分けがつかないほど自然なフィッシングメールの作成や、ディープフェイク技術で生成した音声クローンを用いた詐欺などが現実の脅威です。これに対し、防御側もAIで対抗する動きが加速しています。具体的には、生成AIに未知の攻撃パターンをシミュレーションさせて検知モデルを強化したり、監査の際に膨大な証憑データを要約・分析させたりする取り組みが進んでいます。まさに「AI対AI」の様相を呈しており、巧妙化するAI異常検知は、いたちごっこを続ける攻撃者への有効な対抗策となっています。

ディープフェイクや合成音声を見抜く最新技術

生成AIの悪用により、本物と見分けがつかないディープフェイク動画や合成音声による詐欺が深刻化しています。これに対抗するため、不正検知AIの技術も急速に進化しており、2026年現在、ビデオコンテンツ内の悪意ある音声をAIが分析・検知する「Avast Deepfake Guard」や、NTT東日本による電話での「オレオレ詐欺」を防ぐ高精度な音声フェイク検知技術などが登場しています。

また、iDenfyのようにAIがディープフェイクを見破り、オンラインでの本人確認を強化するサービスも実用化されています。こうしたAI声紋認証のような生体認証技術は、巧妙化するなりすまし手口への有効な対抗策として期待されています。

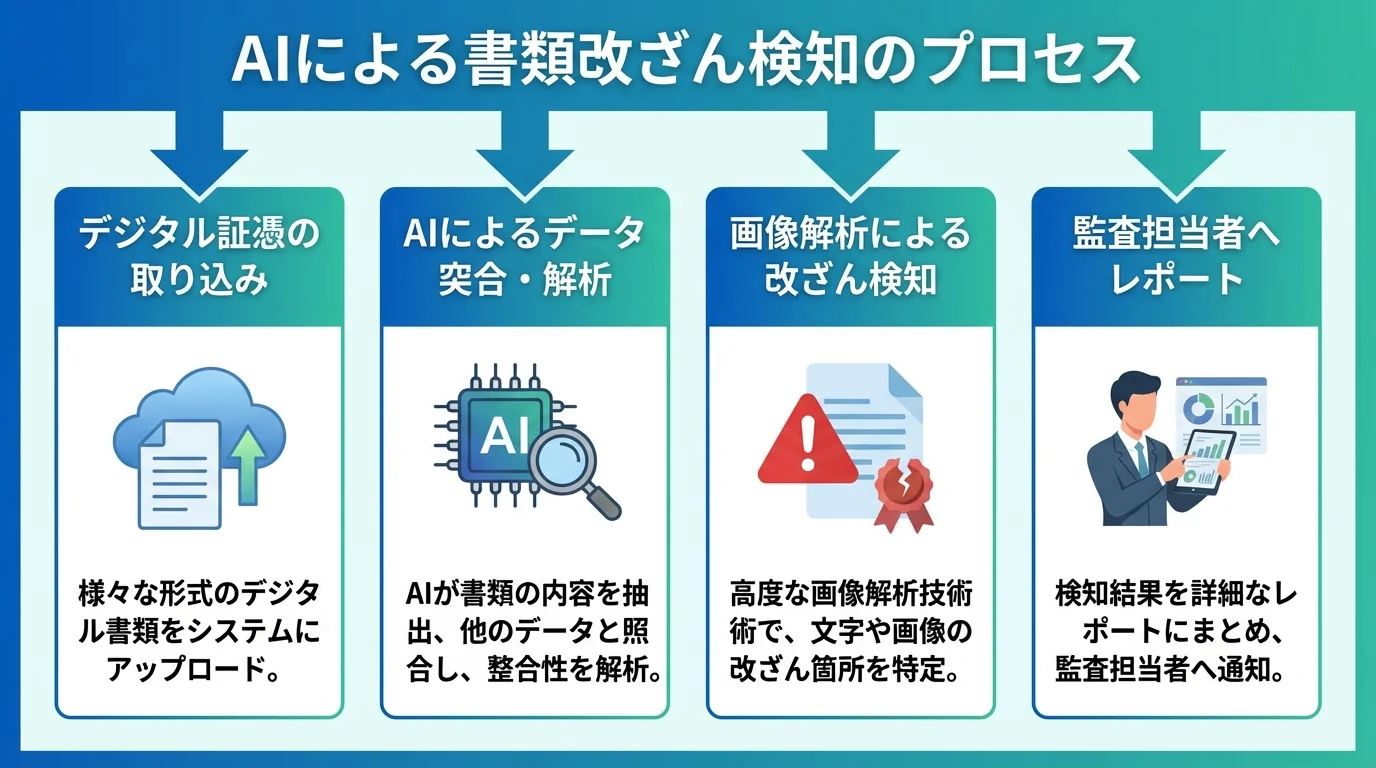

監査分野にも導入進む書類の改ざん検知機能

会計監査の分野でも、AIによる不正検知は不可欠なツールとなりつつあります。従来は膨大な証憑を目視で確認していましたが、AI技術によってその作業は自動化・高度化されています。例えば、EY新日本有限責任監査法人が2026年1月から本格稼働させた「Document Intelligence Platform」は、画像解析AIを駆使します。このシステムは、デジタル化された請求書や領収書に施された不自然な加工の兆候を検知し、書類の改ざんや偽造を自動で発見します。さらに、KPMGのAIツールのように、財務諸表データから不正会計のリスクをスコアリングし、その要因まで解釈するソリューションも登場。こうしたAI異常検知の技術応用により、監査業務の精度と効率は飛躍的に向上しています。

【2026年最新動向】不正シナリオ生成にも活用される「生成AI」の攻防

2026年現在、不正検知の最前線では「生成AI」をめぐる激しい攻防が繰り広げられています。攻撃者は生成AIを悪用し、巧妙なフィッシングメールやディープフェイク音声だけでなく、防御システムを欺くための未知の不正シナリオさえも自動で生成しています。これに対し防御側も、AIを用いて攻撃パターンを予測・シミュレーションし、検知モデルを強化する対抗策を講じています。本章では、この「AI対AI」ともいえる技術競争の最新動向を詳しく解説します。

生成AIを悪用した攻撃手口の巧妙化

攻撃者側も生成AIを悪用し、不正の手口はかつてないほど巧妙化しています。例えば、人間が書いたと見分けがつかないほど自然で説得力のあるフィッシングメールを大量に自動生成したり、ディープフェイク技術で本人の声を再現した「なりすまし詐欺」を実行したりします。さらに、本物そっくりの個人情報パッケージ(住所、職歴、SNSプロフィールなど)を数分で作成し、アカウント乗っ取りに悪用するケースも報告されています。このようなAIを駆使した攻撃は、従来の検知システムを容易にすり抜けるため、防御側もAIで対抗する必要に迫られています。特に音声を用いた詐欺には、AI声紋認証のような技術が有効です。

AIが未知の不正シナリオを生成し防御強化

従来の不正検知は、過去に発生した手口の学習が中心でした。しかし、攻撃者がAIで生み出す全く新しい手口には対応しきれないという課題がありました。そこで2026年現在、防御側も生成AIを活用するアプローチが注目されています。これは、AIが攻撃者の視点に立ち、考えうる未知の不正パターンや攻撃シナリオを大量にシミュレーションするものです。

生成されたシナリオで検知モデルをテストすることで、まだ世に出ていない攻撃への耐性を高められます。これは、いわばAIによる防御システムのストレステストであり、生成AIのストレステストで解説されているように、システムの堅牢性を事前に高める上で極めて重要です。この「AI対AI」の攻防において、先回りして防御網を構築する先進的な手法として導入が進んでいます。

ディープフェイクや書類改ざん検知も高度化

攻撃側が生成AIを悪用する手口は、もはやテキスト生成にとどまりません。近年では、ディープフェイク技術を用いた声や映像のなりすまし、デジタル書類の巧妙な改ざんなどが大きな脅威となっています。これに対し、防御側のAIも検知技術を高度化させています。例えば、NTT東日本は音声フェイクをリアルタイムで検知する技術を開発し、電話詐欺対策に活用。こうした動きは、電話詐欺だけでなくAI声紋認証のようなオンラインでの本人確認強化にも繋がります。また監査分野では、EY新日本有限責任監査法人が画像解析AIを用いて証憑の不自然な加工を検知するシステムを2026年より本格稼働させ、従来は見抜けなかった偽造書類の発見に貢献しています。

ディープフェイク・音声合成対策も!注目すべき最新アップデート機能

攻撃者は生成AIを悪用し、ディープフェイクによるなりすましや巧妙な音声合成詐欺など、その手口はますます巧妙化しています。こうした新たな脅威に対抗すべく、不正検知AIも常に進化を続けています。このセクションでは、音声フェイクをリアルタイムで見破る技術や、不正利用者の顔を記憶してブロックする高度な本人確認機能など、2026年現在の注目すべき最新アップデートを具体的に解説します。

AIがビデオ内の悪意ある音声を分析・検知

生成AIの悪用により、ディープフェイク技術を使った音声のなりすましが新たな脅威となっています。ビデオ会議やオンラインでの本人確認(eKYC)において、本人の映像に合成音声を組み合わせる手口が増加しているためです。

この課題に対し、ビデオコンテンツ内の不自然な音声をAIがリアルタイムで分析・検知する技術が登場しています。例えば、Avast社は2026年に、ビデオ内の音声が合成されたものかを判定する新機能「Avast Deepfake Guard」をリリースしました。このような音声合成への対策は、金融機関におけるAI声紋認証と組み合わせることで、より強固なセキュリティを実現します。巧妙化する不正検知において、映像だけでなく音声の真正性を見抜く機能は不可欠です。

生成AIが未知の攻撃シナリオを自動生成

これまでの不正検知は、過去の攻撃データを学習することが基本でした。しかし、その手法では攻撃者が編み出す全く新しい手口への対応が後手に回るという課題がありました。そこで注目されているのが、防御側が生成AIを活用して、未知の攻撃シナリオを自動でシミュレーションするアプローチです。

この技術は、AI自身が攻撃者の視点に立ち、考えうる無数の不正パターンを仮想的に生成します。その結果を検知モデルの学習データに加えることで、まだ現実には発生していない巧妙な攻撃手法にも先回りして備え、システムの堅牢性を高めることができます。これは、システムの弱点を事前に洗い出す生成AIのストレステストにも通じる考え方であり、進化し続ける脅威への能動的な防御策として期待されています。

生成AIで監査書類の改ざんを高度に検知

監査業務において、膨大な証憑の中から巧妙に加工された書類を見つけ出すことは大きな課題です。最新の不正検知AIは、この課題を解決するために生成AIの活用を進めています。例えば、EY新日本有限責任監査法人が2026年1月に本格稼働させた「Document Intelligence Platform」は、生成AIと画像解析AIを融合させた先進的なシステムです。会計データと証憑の突合を自動化するだけでなく、デジタル証憑に施された不自然な加工や偽造の兆候をAIが検知します。これにより、人間の目では見逃しがちな巧妙な書類改ざんを高い精度で発見し、監査業務の質と効率を飛躍的に向上させます。こうしたAI取引モニタリングは、会計不正の早期発見に不可欠となりつつあります。

監査・会計分野で導入進む!書類解析における最新活用事例

監査・会計分野では、不正検知AIの導入が急速に進んでいます。特に書類解析の領域では、単に紙の情報をデータ化するだけでなく、生成AIを活用して証憑の突合や調書作成を自動化する動きが活発です。本セクションでは、EY新日本が導入した画像解析による証憑の改ざん検知機能や、KPMGが開発した不正リスクの要因を"解釈"するAIツールなど、最先端の活用事例を具体的に解説します。

EY新日本が導入!生成AIによる書類改ざん検知

大手監査法人であるEY新日本有限責任監査法人は、2026年1月より生成AIを組み込んだ書類解析システム「Document Intelligence Platform(DIP)」の本格稼働を開始しました。このシステムは、監査業務における証憑の確認や会計データとの突合、調書作成までを一貫して自動化し、業務効率を大幅に向上させます。

特に注目すべきは、独自開発の画像解析AIによる書類の改ざん検知機能です。デジタル証憑に施された不自然な加工の兆候をAIが自動で発見し、偽造などの巧妙化する不正手口への対策を強化しています。データから不正の兆候を読み解くこうしたAI取引モニタリングの技術は、監査の品質を飛躍的に向上させる一手として期待されています。

未知の不正パターンを生成AIが自動でシミュレート

従来の不正検知AIは、過去のデータに依存するため、前例のない手口への対応が課題でした。この問題を解決するのが生成AIの活用です。2026年の最新トレンドとして、生成AIがこれまで存在しなかった未知の不正パターンや巧妙な攻撃シナリオを自動でシミュレートする技術が登場しています。これにより、防御側のAIは未来の脅威を疑似体験し、検知モデルの堅牢性を事前に高めることが可能になります。攻撃者もAIで手口を高度化させており、このような「AI対AI」の攻防において、先回りして対策を講じるための重要なアプローチです。これはAIモデルの耐性を試す一種のストレステストとも言え、生成AIのストレステストの重要性を示唆しています。

自然言語でAIに指示し不正調査をスピードアップ

従来の不正調査では、特定のデータを抽出するために専門的なクエリ言語が必須でした。しかし、生成AIの活用により、監査担当者は「特定の期間における高額な経費申請をリストアップして」といった自然言語での指示が可能になっています。AIは指示に基づき、膨大な証憑データから関連情報を瞬時に要約・分析し、不正の兆候を分かりやすく提示します。例えば、EY新日本有限責任監査法人の書類解析システムでは、この技術で証憑確認から調書作成までを自動化。専門知識を問わず調査を深掘りできるため、AI取引モニタリングにも繋がり、不正検知のスピードを飛躍的に向上させています。

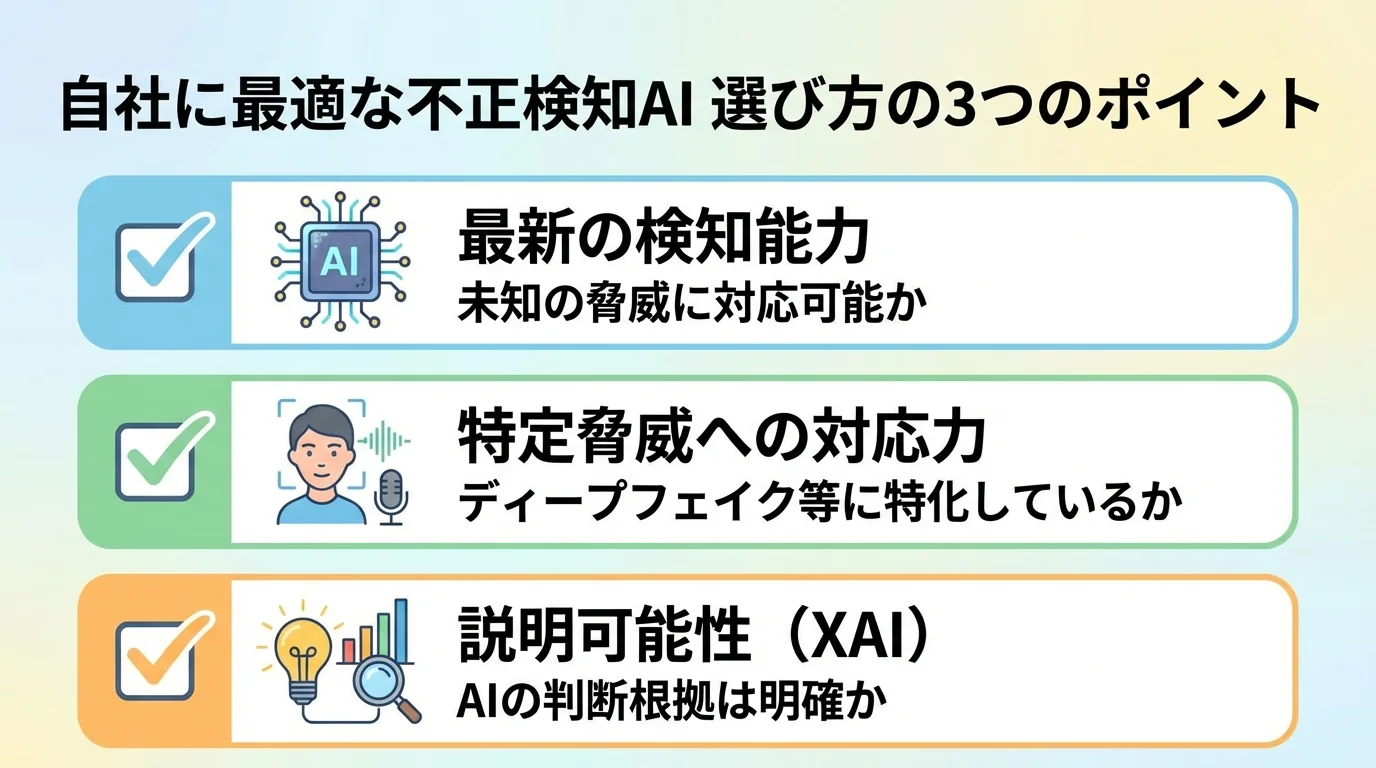

導入成功の決め手は?自社に最適な不正検知AIの選び方

巧妙化する不正手口に対抗するため、不正検知AIの導入は急務です。2026年現在、生成AIを活用した不正シナリオの生成や、判断根拠を示す「説明可能AI(XAI)」など、その機能は急速に進化・多様化しています。しかし、選択肢が増えたことで「自社に本当に合うツールはどれか」という悩みも生まれています。そこで本章では、多様なサービスの中から、自社の課題解決に直結する最適な不正検知AIを選ぶための具体的なポイントを解説します。

生成AIを活用した最新の検知能力

近年の不正検知AIは、生成AIの活用により、その能力を飛躍的に向上させています。これは、もはや単なるパターン検知ではありません。例えば、生成AIは過去のデータから考えうる未知の不正シナリオを自動でシミュレーションし、防御モデルを事前に強化します。また、監査業務においては、膨大な証憑や契約書をAIが解析・要約し、人間が理解しやすい言葉で不正の兆候を提示。さらに画像解析によって書類の偽造まで見抜くことが可能です。こうした高度なデータ解析は、AI取引モニタリングの精度向上にも直結し、調査の効率化と検知精度の両面で大きな進化を遂げています。

ディープフェイクなど特定脅威への対応力

生成AIの悪用により、ディープフェイクによる顔のなりすましや音声合成を利用した詐欺など、従来の対策では見抜けなかった脅威が急増しています。そのため、不正検知AIを選ぶ際は、こうした特定の脅威への対応力が重要な判断基準となります。2026年現在、ビデオ内の悪意ある音声を検知する機能や、電話での「オレオレ詐欺」を防ぐ高精度な音声フェイク検知技術などが実用化されています。特に金融機関では、AI声紋認証のような技術と連携し、本人確認を強化する動きが活発です。自社の事業で想定されるリスクに特化した検知機能を備えているか、必ず確認しましょう。

AIの判断根拠を示す「説明可能性」で選ぶ

AIが不正を検知しても、その理由が分からなければ担当者は対応に窮してしまいます。この「ブラックボックス問題」を解決するのが、説明可能AI(XAI)です。2026年のトレンドとして、AIがなぜ特定の取引を不正と判断したのか、その根拠や影響を与えた要因を具体的に提示する機能が重視されています。例えば、あずさ監査法人の「Fraud Risk Scoring_ai_3.0」のように、リスク要因を「解釈」して示すツールも登場しています。単にアラートを出すだけでなく、判断根拠まで示すことで、誤検知への対応が迅速になり、AI取引モニタリングとなります。AIの判断を鵜呑みにせず、人が納得して次のアクションに移れるかどうかが、導入成功の分かれ道です。

導入時の課題とリスク!不正検知AIの知っておくべき注意点

不正検知AIを導入すれば、巧妙化する不正の手口に万全の対策が打てる――。そんな幻想を抱いていませんか?残念ながら、AIは万能の解決策ではありません。むしろ、AIを導入したからこそ直面する新たな課題や、見過ごせないリスクが存在します。このセクションでは、誤検知や検知漏れといったAIの限界から、攻撃者も生成AIを悪用する「AI対AI」の攻防の現実まで、導入後に後悔しないための注意点を忖度なく解説します。

生成AIの悪用との終わらない競争

不正検知AIを導入すれば安心、などという甘い考えは即刻捨てるべきだ。攻撃者もまた、生成AIを悪用し、かつてないほど巧妙なフィッシングメールやディープフェイクを量産している。防御側が新たな検知モデルを導入すれば、攻撃側はそれを学習データとして、さらに高度な攻撃手法をAIで即座に生み出す。これは、資金と技術を延々と注ぎ込むしかない、終わりのない軍拡競争に他ならない。一度導入して満足し、継続的な投資とチューニングを怠る企業は、陳腐化したシステムを抱えたまま、真っ先に攻撃者の餌食となるだろう。この戦いは、潤沢な予算を持つ体力のある大企業向けのゲームであり、中途半端な覚悟での参戦は、高価なシステムがただの負債と化すだけだ。

AIの判断がブラックボックス化する危険性

AIが「なぜ不正と判断したか」が不明瞭というブラックボックス問題は、導入における根深い課題です。近年はAI自身が判断根拠を示す「説明可能AI(XAI)」がトレンドですが、これに過度な期待は禁物。XAIが示す「根拠」を鵜呑みにし、正常なユーザーを不正と誤検知してアカウントを凍結、結果クレーム対応に追われるのは導入失敗の典型例です。結局、その根拠を解釈し、最終判断を下せる人間の専門知識がなければ宝の持ち腐れ。高度なAIに高額な費用を投じる前に、より安価なルールベースの検知を徹底的に見直す方が、費用対効果で勝るケースも少なくありません。

新技術への追随コストと運用負荷の増大

不正検知AIを導入すれば安心、などという幻想は今すぐ捨てるべきだ。現実は、攻撃者が生成AIを悪用して次々と新手口を生み出す「AI対AI」の終わりのない軍拡競争に他ならない。2026年現在、ディープフェイク対策や説明可能AI(XAI)など新技術が次々登場するが、その度にシステムのアップデートや追加ライセンス費用が発生する。これを怠れば、高価なシステムは瞬く間に陳腐化し、投資は無駄になる。「AI導入で人件費削減」を目論むのも典型的な失敗パターンだ。AIの誤検知をレビューし、継続的にモデルを再学習させる高度な専門人材は不可欠であり、むしろ運用負荷は増大する。被害額が小さい、または不正パターンが単純なビジネスであれば、高価なAIよりも堅牢なルールベースの仕組みを徹底する方が賢明な判断と言えるだろう。

まとめ

本記事では、生成AIの悪用で巧妙化する不正手口の現状と、それに対抗する不正検知AIの重要性について解説しました。ルールベースの限界を超え、ディープフェイクのような新たな脅威にもリアルタイムで対応できるAIは、もはやセキュリティ対策のスタンダードとなりつつあります。

導入を成功させるには、自社の課題やデータ環境を正確に把握し、最適なソリューションを選定することが不可欠です。不正検知AIへの投資は、単なるコストではなく、企業の信頼と資産を守るための重要な戦略的投資と言えるでしょう。本記事で得た知識を基に、ぜひ具体的な導入検討の第一歩を踏み出してください。

■ 【金融機関様向け】セキュリティ・リスク評価付きAI活用無料診断実施中!

現状のITインフラに基づいたセキュアなAI活用ロードマップの作成、社内規程RAGのプロトタイプデモを無料でご案内します。

無料診断のお申し込みはこちら