生成AIの医療活用とは?基本からわかる重要性と変革のポテンシャル

2026年、生成AIは医療の「未来」を語る技術から、日々の臨床を支える「現在」のツールへと急速に変貌を遂げています。もはや実験段階ではなく、具体的な成果が問われる「実装」と「実証」のフェーズへと本格的に突入しました。単なる事務作業の効率化に留まらず、創薬や個別化医療のあり方まで根底から覆すこの変革の力は、一体どこまで医療の可能性を押し広げるのでしょうか。本章では、その基本から重要性、そして未来へのポテンシャルを紐解きます。

事務作業から創薬まで。生成AIの医療活用領域とは

生成AIの医療活用は、医師の事務負担を軽減する領域から、生命科学の最前線である創薬まで、驚くほど多岐にわたります。最も身近な例は、電子カルテの情報を基に診療情報提供書や退院時サマリーの草案を作成する医療文書作成の自動化です。東北大学病院の実証実験では、この作業時間を平均47%も削減したと報告されています。さらに、診察中の会話から自動でカルテを作成する「アンビエントAI」も実用化が進んでいます。

一方で、最も革新的な領域が「Generative Biology(生成生物学)」です。AIが従来存在しなかったタンパク質や分子構造をゼロから設計し、新薬開発のプロセスを劇的に短縮します。アステラス製薬では、この技術で2年を要した開発を7ヶ月に短縮した事例も報告されており、生成AIは単なる業務効率化ツールではなく、医療の未来を創造するエンジンとなりつつあるのです。

「実装」フェーズへ!個別化医療を実現する変革の力

生成AIは、単なる業務効率化ツールから、治療の設計思想そのものを変えるエンジンへと進化を遂げました。その最たる例が、個別化医療の実現です。2026年現在、AIは患者一人ひとりのゲノム情報、電子カルテ、さらには生活習慣データまでを統合的に解析し、最適な治療法や薬剤を予測する「精密医療」を加速させています。さらに注目すべきは、創薬分野で台頭する「Generative Biology(生成生物学)」です。これは既存の化合物を探すのではなく、特定の疾患や患者に合わせた全く新しいタンパク質や分子構造をAIがゼロから設計するアプローチであり、まさに治療のパラダイムシフトと言えるでしょう。こうした変革は、企業が生成AI導入で得られるメリットとはという問いに対し、医療の質の飛躍的向上という最も価値ある答えを示し始めています。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

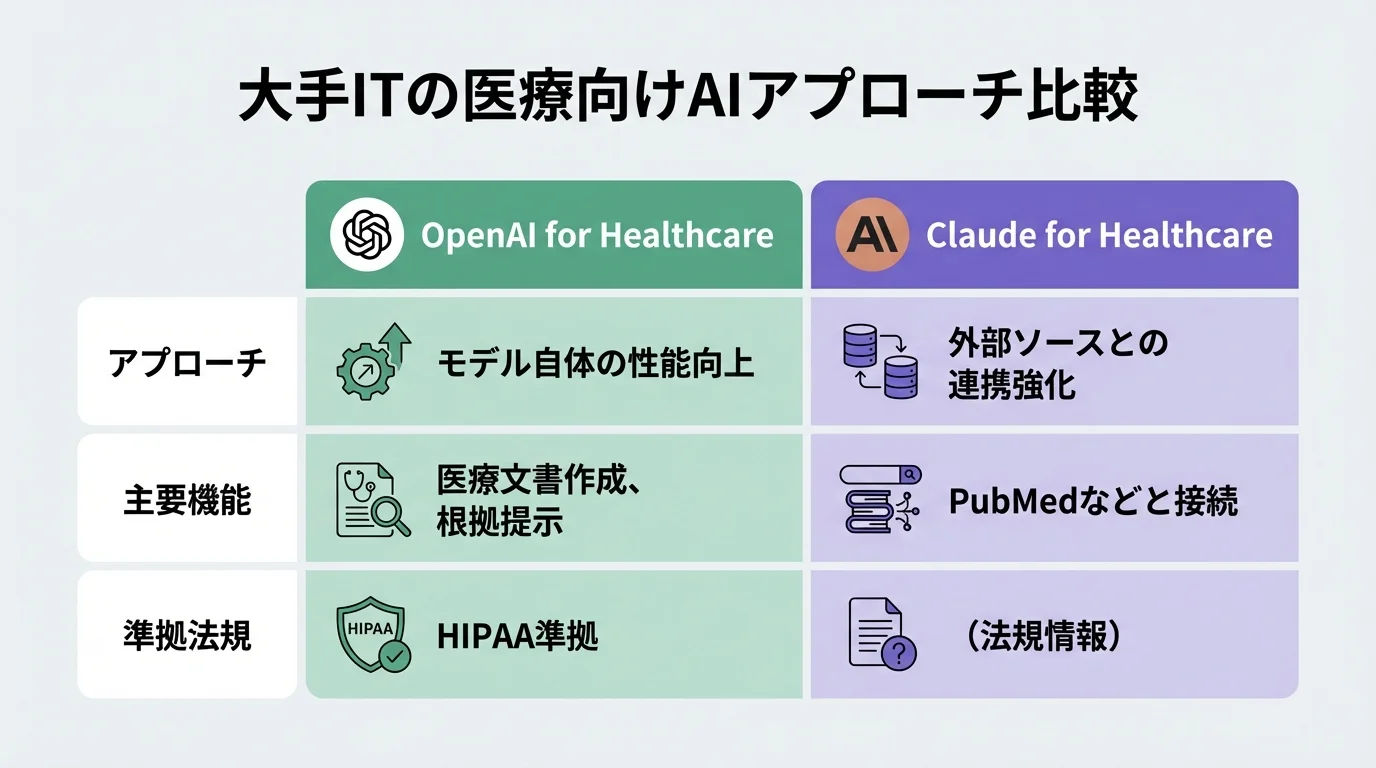

大手IT本格参入が加速させる、医療特化AIの進化

2026年、医療AIは新たな進化の起爆剤を得ました。これまでも技術開発は進んでいましたが、OpenAIやAnthropicといった大手IT企業の本格参入が、その流れを決定的に加速させています。例えば、OpenAIは2026年1月にHIPAA(米国医療保険法)に準拠した「OpenAI for Healthcare」を発表。一方、Anthropicも「Claude for Healthcare」でPubMed(医学文献データベース)など外部情報ソースとの接続を強化しました。これは、汎用AIが医療特有の厳格な規制と高度な専門性に対応する「医療特化型」へと進化している証左です。大手間の競争が技術革新を促し、信頼性と精度を飛躍的に高める。この動きは、企業が生成AI導入で得られるメリットとはを医療の現場で最大化する試みであり、より安全なAIが臨床を支える未来を大きく前進させているのです。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

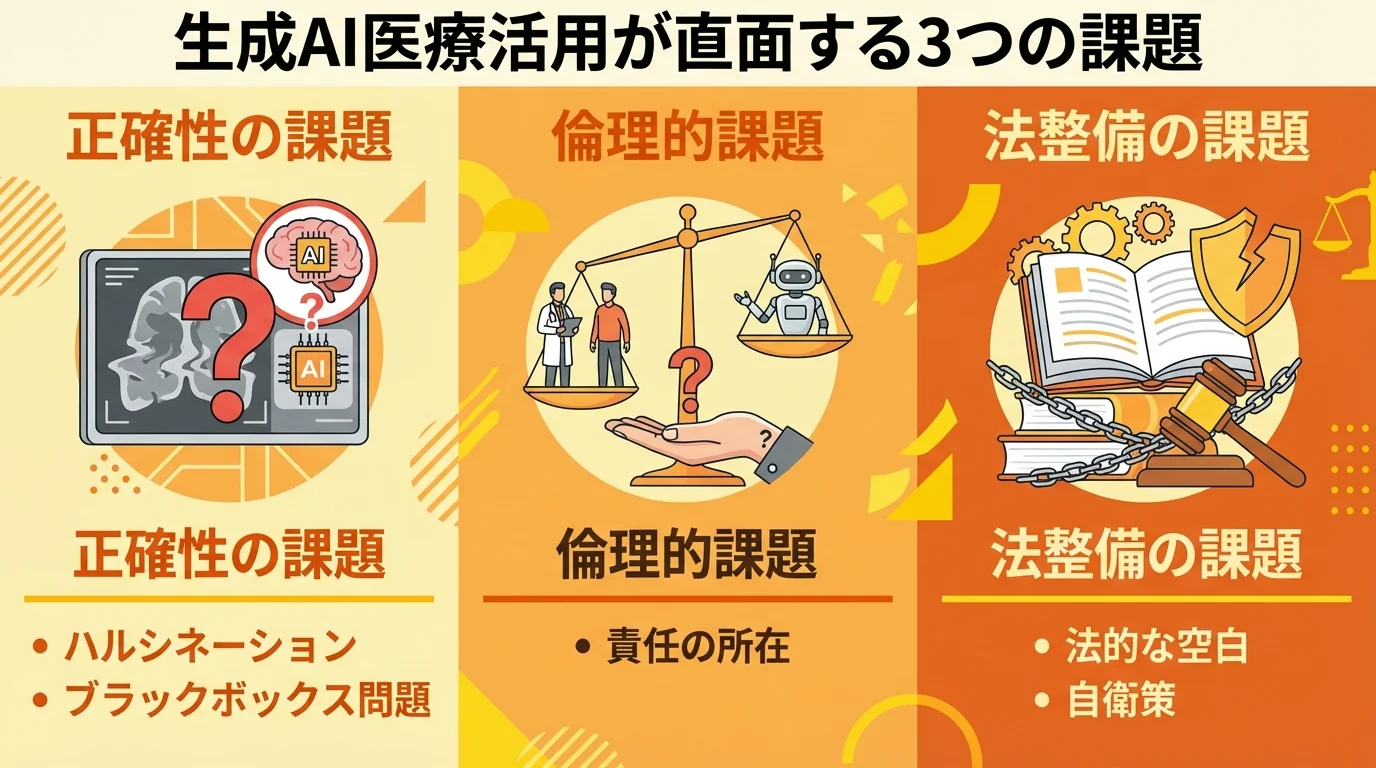

「実装と実証」の時代へ。生成AI医療活用が直面する正確性・倫理・法整備の課題

生成AIが「実装と実証」の時代を迎え、その実用性が現実のものとなる一方で、私たちは技術の光が落とす影、すなわち避けて通れない課題と向き合う必要があります。AIが出力する情報は100%正しいと言えるのかという正確性の問題。AIの判断によって生じた結果の責任の所在はどこにあるのかという倫理的ジレンマ。そして、技術の進化に追いつかない法整備の遅れは、医療現場に新たなリスクをもたらしています。本章では、この3つの核心的な課題の最前線を掘り下げます。

AIの回答は100%正しい?問われる情報の正確性と限界

生成AIが提示する回答は、現時点で100%正確であるとは限りません。特に医療分野では、もっともらしい嘘の情報を生成する「ハルシネーション」が、誤った診断や治療方針に直結する致命的なリスクとなり得ます。また、AIがなぜその結論を導き出したのか根拠が不透明な「ブラックボックス問題」も、医師が最終判断を下す上での大きな障壁です。この課題に対し、2026年にはAnthropic社が医学文献(PubMed)など信頼性の高い外部ソースと接続する機能を発表するなど、情報の正確性を担保する動きが加速しています。しかし、AIはあくまで高度な支援ツールであり、最終的な診断と治療の責任は医師が負うという原則は揺らぎません。なぜ今、この技術の限界を冷静に見極めることが、安全な医療活用の前提となるのです。

あわせて読みたい

生成AI とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

AIが下した判断の責任は誰に?倫理的ジレンマの最前線

生成AIが診断支援ツールとして臨床現場に浸透する一方で、万が一AIの判断に基づいた医療行為で問題が生じた場合、その責任は誰が負うのかという深刻な課題が浮上しています。AI開発者、導入した医療機関、そして最終判断を下した医師。この責任の所在は、AIの判断根拠が不明瞭な「ブラックボックス問題」とも相まって、法整備が追いついていないのが現状です。欧州連合(EU)のAI法が医療機器を「高リスクAI」に分類するように、世界では規制の動きが先行しています。国内でもAIセーフティ・インスティテュート(AISI)が評価ガイドラインの策定に着手するなど、なぜ今こうしたルール作りが急がれるのか、社会的なコンセンサス形成が求められています。技術と倫理の両輪を揃えることこそ、医療AIの健全な発展を支える礎となるでしょう。

あわせて読みたい

生成AI とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

技術の進化に追いつかない法整備、現場が直面するリスク

技術の急速な進化に対し、法整備が追いついていない現状は、医療現場にとって無視できないリスクを生み出しています。例えば、AI支援診断で問題が生じた際の責任の所在は、倫理的な課題であると同時に法的な空白地帯でもあります。この曖昧さが、先進的な技術導入への躊躇や、現場の医師・病院の過度な負担につながりかねません。海外ではEUのAI法のように医療AIを高リスクと位置づけ厳格な規制を課す動きも進む一方、国内では2026年にAISI(AIセーフティ・インスティテュート)がガイドライン策定に着手した段階です。医療機関は、企業が生成AI導入で得られるメリットとはを追求しつつも、ベンダーとの契約内容を精査し、院内ガイドラインを整備するといった自衛策が不可欠となっています。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

なぜ今、医療現場で生成AI活用が加速するのか?業務効率化と個別化医療への期待

技術の可能性や課題が語られる一方で、なぜ今、医療現場での生成AI導入はこれほどまでに加速しているのでしょうか。その原動力は、もはや抽象的な期待ではなく、投資対効果(ROI)として計測できる具体的な成果にあります。文書作成時間が半減し、新薬開発が数ヶ月単位で短縮される――。目に見えるベネフィットが、現場の導入意欲をかつてなく高めているのです。本章では、業務効率化と個別化医療という2つの側面から、この加速の背景を深掘りします。

文書作成から情報収集まで。医師の業務負担を劇的に軽減

医師の業務時間の大半を占めるとされる文書作成や情報収集といった非診療業務は、今まさに生成AIによって革命的な変化を遂げようとしています。例えば、東北大学病院の実証実験では、電子カルテの情報から診療情報提供書などを自動生成することで、文書作成時間を平均47%も削減することに成功しました。さらに、診察中の会話をリアルタイムで記録するアンビエントAIの活用も始まっています。情報収集においても、臨床ナレッジAI「Cubec」に搭載された「高速モード」のように、多忙な現場で結論と要点だけを瞬時に確認できる機能が実装されつつあります。これら企業が生成AI導入で得られるメリットとはの中でも、医師が患者と向き合う本来の業務に集中する時間を創出するという点で、医療の質を本質的に向上させる大きな可能性を秘めているのです。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

「個の医療」の実現へ。データが拓くオーダーメイド治療

生成AIは、画一的な標準治療から一人ひとりの特性に合わせた「個の医療」への移行を強力に後押ししています。AIが患者個人のゲノム情報や電子カルテ、さらには生活習慣データまでを統合的に解析することで、これまで見過ごされてきた治療選択肢や最適な薬剤の組み合わせを提示することが可能になります。例えば、国立がん研究センターの「がんゲノム情報管理センター(C-CAT)」では、AIが集約されたゲノム・臨床情報を分析し、医師の治療方針決定を支援。これは、医師の経験則とガイドラインに加え、データ駆動型の個別最適化が新たな標準となる未来を予感させます。なぜ今、この変革が重要なのか。それは、AIがこれまで不可能だったレベルでの精密医療(Precision Medicine)を実現する鍵を握っているからです。

あわせて読みたい

生成AI とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

「実装と実証」の時代へ。目に見える成果が導入を加速

2026年、生成AIは医療の「未来を語る技術」から「成果を出すツール」へと完全に姿を変えました。もはや概念実証(PoC)の段階ではなく、具体的な成果が次の導入を呼ぶ好循環が生まれています。例えば、創薬分野では「Generative Biology」により開発期間が数年から数ヶ月へと劇的に短縮され、臨床現場では診察中の会話を自動で記録する「アンビエントAI」が実用化フェーズに入りました。こうした目に見える成果こそが、これまで導入に踏み切れなかった医療機関の「なぜ今」という問いに、投資対効果という明確な答えを示しているのです。

あわせて読みたい

生成AI とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

【2026年最新動向】OpenAI本格参入と臨床支援AIの進化が示す医療の最前線

2026年、生成AIの医療活用は、ついに「成果」が問われる実装・実証の最前線に到達しました。この変革を象徴するのが、同年1月に発表されたOpenAIの医療市場への本格参入です。汎用AIの巨人が、HIPAA準拠のサービスで臨床現場に何をもたらすのか。一方で、医師の判断を高速化する「臨床ナレッジAI」も急速な進化を遂げています。技術が現場のニーズをどう満たし、新たな医療のスタンダードを築いていくのか、その核心に迫ります。

OpenAIが医療市場に本格参入!特化型サービスの全貌

2026年1月、ついにOpenAIは医療機関向け製品群「OpenAI for Healthcare」を発表し、この市場への本格的な進出を宣言しました。このサービスの中核をなすのは、米国の医療保険法(HIPAA)に準拠し、最新モデルGPT-5.2を搭載した「ChatGPT for Healthcare」です。これは単なるチャットツールではなく、医療文書の自動作成や医学的根拠の提示機能を備え、医師の臨床判断を支援する専門ツールとして設計されています。同時期にAnthropic社が外部データベースとの連携を強化したこととは対照的に、OpenAIはモデル自体の性能で医療現場の課題解決を目指す姿勢を明確にしました。この動きは、生成AI活用がビジネスとして成立するフェーズに入ったことを示しており、企業が生成AI導入で得られるメリットとはという潮流が、ついに医療という規制の厳しい領域にも到達したことを意味します。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

医師の判断を高速化する「臨床ナレッジAI」の進化

2026年、臨床支援AIは電子カルテの要約といった間接的な業務支援から、医師の思考プロセスそのものを直接サポートする領域へと飛躍的な進化を遂げています。象徴的なのが、臨床ナレッジAI「Cubec」が同年2月に実装した新機能です。多忙な外来で結論だけを求める「高速モード」、根拠を深く掘り下げる「推論モード」など、医師が置かれた状況に応じてAIの思考深度を使い分けられるようになりました。さらにAnthropic社のように、PubMedなどの外部医学情報ソースと直接連携し、常に最新かつ信頼性の高い根拠を提示する動きも加速しています。これは、AIが単なる情報検索ツールから、医師の臨床推論を補助する「思考パートナー」へと変貌していることを示しており、企業が生成AI導入で得られるメリットとはで語られる生産性向上の本質を体現する動きと言えるでしょう。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

ROIで評価される時代へ。実装・実証フェーズの最前線

2026年、生成AIの評価軸は「何ができるか」から「どれだけの成果を生んだか」へと完全に移行しました。もはや技術的な検証ではなく、具体的な投資対効果(ROI)が導入の可否を分ける時代です。その最前線が、創薬分野で加速する「Generative Biology(生成生物学)」。AIが自律的に仮説生成から実験までを行うこのアプローチは、従来2年を要した開発プロセスを7ヶ月に短縮した事例も生み、ROIの概念を根底から覆す可能性を秘めています。また国内では、厚生労働省がAI連携を前提とした標準型電子カルテの開発を進めるなど、国レベルでの実装基盤整備も加速。補助金制度の拡充も、費用対効果を重視する医療現場の導入を後押ししており、なぜ今この技術が重要視されているかの証左と言えるでしょう。

あわせて読みたい

生成AI とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

診断から創薬まで、生成AIは医師の未来をどう変えるか?専門家が予測する変革の可能性

「実装」フェーズを超え、生成AIは医療の根幹を揺るがし始めています。特に、新たな分子構造をゼロから設計するGenerative Biology(生成生物学)は、創薬の常識を覆す可能性を秘めています。AIは名医の診断眼を超えるのか?そして、AIとの協業が必須となる未来で、医師に求められるスキルセットはどう変わるのか。本章では、専門家たちの予測を基に、医師という存在の未来像を具体的に描き出します。

AIは名医を超えるか?診断支援の進化と医師の役割

AIは名医を超えるか?この問いは、もはやSFの世界の話ではありません。膨大な論文や症例データを瞬時に解析し、画像診断で人間の目では捉えきれない微細な病変を発見するAIの能力は、特定のタスクにおいて既にベテラン医師を凌駕しつつあります。実際に、患者のゲノム情報から最適な治療法を提案するなど、個別化医療の実現を強力に後押ししています。

しかし、AIの判断根拠が不明瞭な「ブラックボックス問題」や、事実に基づかない情報を生成する「ハルシネーション」のリスクは依然として存在します。名医の真価とは、データに基づくだけでなく、患者の背景や感情を汲み取り、複雑な状況下で倫理観をもって最終判断を下す点にあります。

結論として、AIは名医を「代替」するのではなく、その知見と判断力を拡張する「最強の聴診器」となるでしょう。医師の役割は、AIが出力する確率論的な答えを解釈し、最終的な意思決定と患者に寄り添う人間的なケアへと、その重心を移していくことになるのです。

ゲノム情報から新薬を創出。生成AIが拓く創薬革命

生成AIは、創薬のプロセスを「探す」から「創り出す」へと根本的に変えています。その革命の中核を担うのが、2026年のトレンドであるGenerative Biology(生成生物学)です。この技術は、膨大なゲノム情報や論文を解析して治療標的を特定するだけでなく、その標的に最適な新しいタンパク質や分子構造をゼロから設計します。事実、中国ではAIが難病の治療薬を設計し、30ヶ月未満という異例の速さで臨床試験を完了。国内でもアステラス製薬が開発プロセスを2年から7ヶ月へ短縮した事例が報告されています。今後は、AIと実験ロボットが連携する「Lab-in-the-Loop」の実現も視野に入り、創薬革命はさらに加速するでしょう。

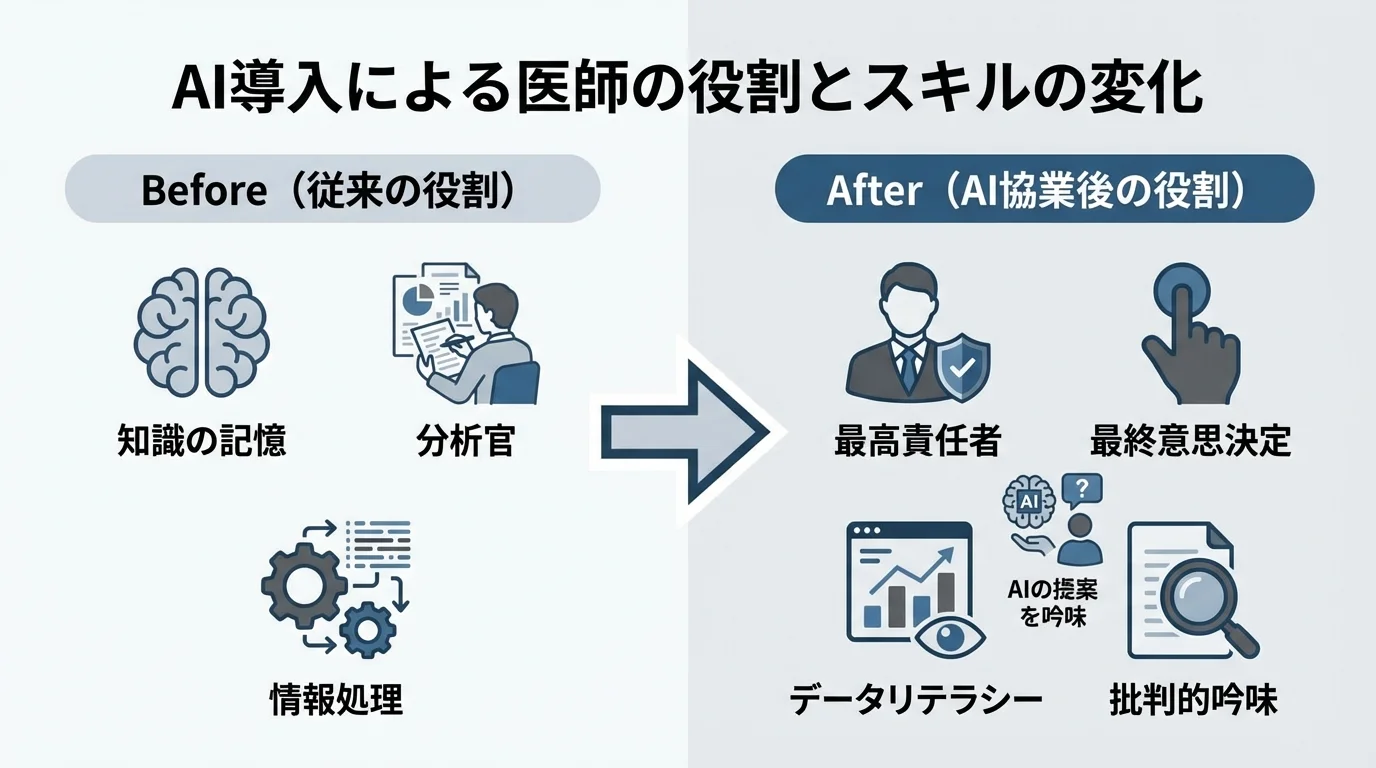

AIとの協業が必須に。医師の役割とスキルセット再定義

生成AIが「実装と実証」の時代を迎えた今、医師の役割は根本から問い直されています。もはやAIが仕事を奪うか否かという議論ではなく、いかにAIと協業し、医療の質を最大化するかという視点が不可欠です。医師の役割は、膨大なデータを処理する分析官から、AIの提案を吟味し、最終的な意思決定を下す最高責任者へとシフトします。AIが提示するハルシネーションのリスクを見抜き、ブラックボックス化された判断根拠を患者に分かりやすく翻訳する、人間ならではの高度なコミュニケーション能力がこれまで以上に重要となるでしょう。

それに伴い、医師に求められるスキルセットも再定義されます。最新の医学論文を追うだけでなく、AIの特性を理解し、その出力を正しく評価するためのデータリテラシーが必須スキルとなります。例えば、臨床ナレッジAI「Cubec」のようなツールを使いこなし、最適な情報を引き出す能力も求められます。これは、なぜ今、生成AIなのかという本質的な問いへの医療現場からの回答であり、AIを「使う側」としての医師の価値を再確立する動きと言えるでしょう。

あわせて読みたい

生成AI とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

変革の波を乗りこなすために。医療従事者が生成AIと向き合う上での心構え

生成AIが「実装と実証」のフェーズへと本格的に移行した今、その存在はもはや無視できない不可逆的な変化となりました。これは単なるツールの導入ではなく、私たちの思考様式そのもののアップデートを迫るものです。AIの判断を鵜呑みにする「依存」でも、変化を拒絶する「懐疑」でもなく、その限界を理解した上で能力を最大限に引き出すためには、どのような心構えが必要なのでしょうか。本章では、技術を賢く使いこなし、変革の波を乗りこなすための思考法と実践的スキルを掘り下げます。

AIは万能ではない。限界を理解し良き相棒にする思考法

生成AIの進化は目覚ましいですが、それは決して「万能」を意味しません。むしろ、その限界を正確に理解することこそ、AIを真のパートナーにする第一歩です。例えば、もっともらしい嘘をつく「ハルシネーション」は、生成AIが構造的に抱えるリスクです。AIの回答を鵜呑みにするのではなく、常に「仮説の一つ」として捉え、最終的な医学的判断は必ず医師自身が行うという原則を徹底せねばなりません。AIを完璧な専門家ではなく、膨大な情報から可能性を提示してくれる極めて優秀なアシスタントと位置づけること。その上で、提示された根拠を批判的に吟味し、自らの専門知識と経験で最終決定を下す。この「主導権は人間にある」という思考法こそが、AIを暴走させず、良き相棒として使いこなすための鍵となるのです。

AIの回答を鵜呑みにしない。「批判的吟味」という新スキル

生成AIがもたらす情報の奔流を前に、医療従事者には新たなリテラシーが求められます。それは、医学論文を読む際に培われてきた「批判的吟味(Critical Appraisal)」のスキルを、AIとの対話に応用する能力です。AIはハルシネーション(もっともらしい嘘)を生成するリスクを常に内包しており、その回答を鵜呑みにすることは許されません。例えば、2026年にアップデートされた臨床ナレッジAI「Cubec」は、結論を素早く示す「高速モード」を搭載しましたが、その回答を起点とし、必要に応じて背景を示す「推論モード」や原典にあたる「論文モード」で検証するプロセスこそが、AI時代の批判的吟味です。これは単なるファクトチェックではなく、AIの論理構成の妥当性を評価し、最終判断の責任を人間が担うという強い意志の表れと言えるでしょう。このスキルを磨くことではじめて、AIは単なる検索ツールから、自らの思考を深めるパートナーへと昇華するのです。

「実装」の時代を生き抜く、変化を恐れず試す学習マインド

生成AIが「実装」の時代へと突入した今、医療従事者に求められるのは、単なる知識のインプットではなく、変化を恐れず自ら「試す」学習マインドです。2026年に入り、臨床ナレッジAI「Cubec」に外来業務を想定した「高速モード」が追加されるなど、ツールの進化は日進月歩で加速しています。このような変化の波に乗り遅れないためには、学習し続ける姿勢が不可欠と言えるでしょう。幸い「デジタル化・AI導入補助金2026」なども整備され、試すためのハードルは下がりつつあります。まずは院内の小さな課題解決からでも、実際にツールに触れてみること。完璧な導入を待つのではなく、不完全さを許容しながら試行錯誤するトライ&エラーの精神こそが、企業が生成AI導入で得られるメリットとはを真に理解し、未来の医療を形作る原動力となるのです。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

生成AI医療活用の限界と批判的視点:技術への過信が招くリスクとは

これまで効率化や個別化医療といった輝かしい未来が語られてきたが、技術への過信は禁物だ。むしろ、その裏側で静かに進行するリスクにこそ、我々は目を向けるべきではないか。学習データに潜む偏見が新たな医療格差を生み、AIの判断プロセスが不透明なブラックボックス化は、医師自身の臨床的判断力を鈍らせる。本章では、こうした喧伝されがちなメリットの影に隠れた、不都合な真実に鋭く切り込む。

学習データに潜む偏見。新たな医療格差を生む危険性

生成AIが「客観的」であるという信仰は、もはや危険な幻想に過ぎない。AIの判断根拠は、所詮、過去のデータセットという名の「偏見の集合体」だ。そのデータが特定の性別、人種、あるいは経済状況に恵まれた層に偏っていたとしたらどうなるか。答えは明白だろう。アルゴリズムは、マイノリティやデータ収集が困難な層に対して、精度の低い医療を提供するだけだ。例えば、高価なウェアラブル端末を持つ層のデータで最適化されたAIは、持たざる者への診断精度を著しく落とす危険を孕む。これは、経済格差が生命の格差へと直結する「デジタル医療カースト」の始まりに他ならない。2026年、「実装」の名の下に拙速な導入が進むが、このアルゴリズミック・バイアスを放置したままでは、技術が新たな差別構造を固定化させるだけである。

最適解への依存が奪う、医師の臨床的直感と判断力

生成AIが瞬時に提示する最適化された治療計画は、一見、医療の標準化と質の向上に貢献するように見える。だが、この「正解」への安易なアクセスは、医師の最も重要な能力を蝕む劇薬になりかねない。AIの推奨を無批判に受け入れることは、自らの頭で考えるプロセスを放棄する思考の外部委託に他ならない。特に、教科書通りにはいかない非典型的な症例や、複数の疾患を抱える患者を前にした時、データ上の最適解だけでは対応できない。経験に裏打ちされた臨床的直感や、多角的な情報を統合して決断する判断力こそが医師の本質であり、AIへの過度な依存は、そのスキルを涵養する機会そのものを奪い去る危険な罠なのである。

判断プロセスが不透明?AIのブラックボックス化が招く不信

生成AIが提示する診断候補や治療計画は、一見すると合理的だ。だが、その結論に至る論理的根拠をAI自身も、開発者さえも完全に説明できない「ブラックボックス」問題は、医療現場における致命的な欠陥と言わざるを得ない。医師が患者に治療方針を説明する際、「AIが最適だと判断したからです」以上の説明ができなければ、それは医療ではなく、一種の神託に等しい。万が一、AIの判断に基づいた治療で問題が生じた場合、その責任の所在はどこにあるのか。開発者か、病院か、それとも最終決定した医師か。この根本的な問いに答えが出ない限り、AIへの不信感が払拭されることはないだろう。

まとめ:生成AIとの共存が拓く、次世代医療と医師の新たな役割

生成AIの医療活用は、診断支援や業務効率化から個別化医療の実現まで、計り知れない可能性を秘めています。本記事で見てきたように、その波はすでに「実装と実証」の段階にあり、正確性や倫理、法整備といった課題と向き合いながら、着実に前進しています。

重要なのは、AIが医師の仕事を奪うのではなく、その能力を拡張する強力なパートナーとなる点です。AIが膨大なデータ処理や定型業務を担うことで、医師は患者との対話や複雑な意思決定といった、より人間的な医療の本質に集中できるようになるでしょう。

技術への過信は禁物ですが、その限界と可能性を正しく理解し、主体的に活用する姿勢が求められます。生成AIとの共存が拓く次世代医療の姿とはどのようなものでしょうか。この大きな変革の波を乗りこなし、より良い未来を創造していくのは、現場に立つ私たち一人ひとりです。

生成AIを活用した医療DXにご興味をお持ちでしたら、ぜひOptiMaxにご相談ください。