AI学習を拒む「見えない透かし」とは?その仕組みと目的を徹底解説

生成AIによる作品の無断学習に、多くのクリエイターが頭を悩ませています。その対抗策として注目されるのが、人間の目には見えない「透かし」技術です。この技術には、AIの学習を妨害しモデルを内部から破壊する「データ汚染」型と、作品の来歴を証明する「電子透かし」という、大きく2つのアプローチが存在します。一体どのような仕組みで、私たちの創作物を守るのでしょうか?その目的と巧妙な手口の最前線に迫ります。

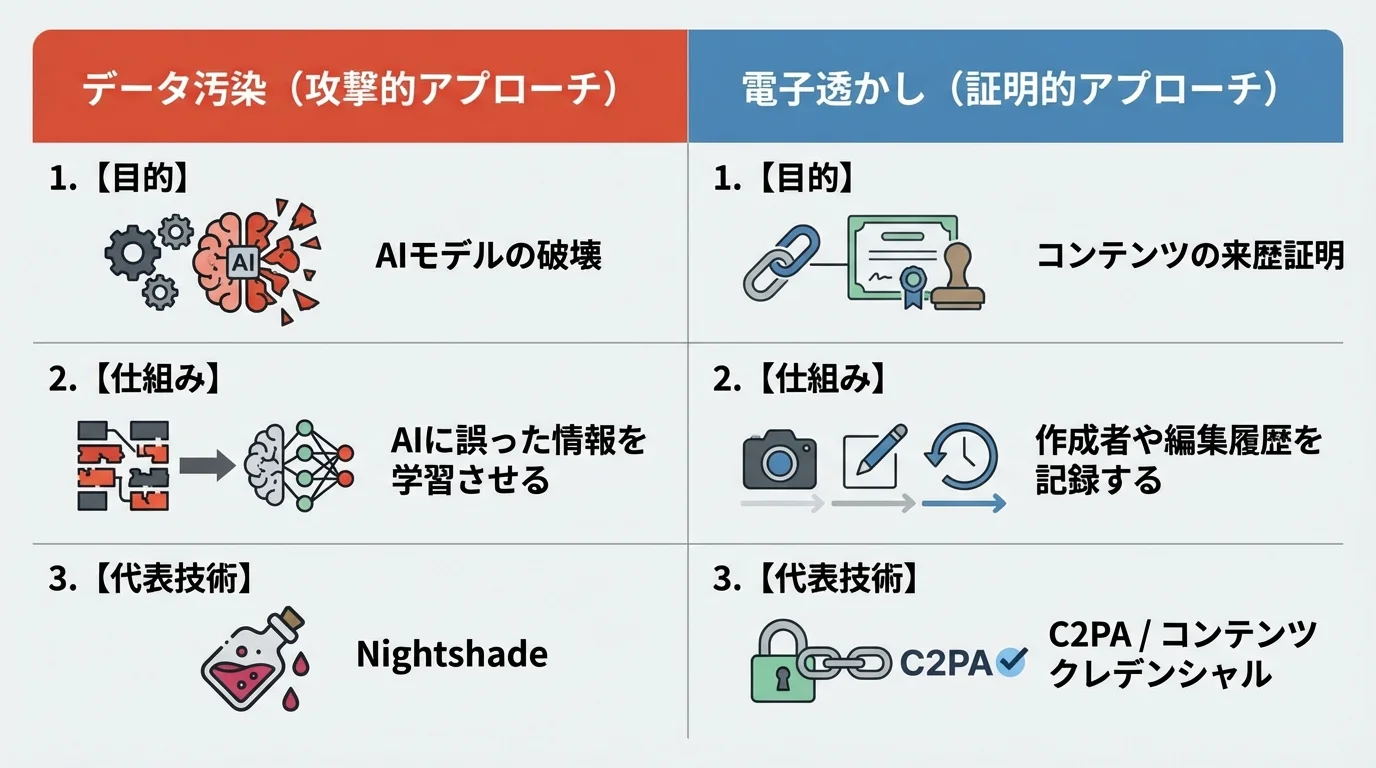

AIを騙す「データ汚染」と来歴を示す「電子透かし」

AI学習への対抗策として注目される「見えない透かし」には、目的が全く異なる2つの潮流が存在します。一つはAIモデルを直接的に攻撃する「データ汚染」技術、もう一つはコンテンツの出自を証明する「電子透かし」技術です。

シカゴ大学が開発したNightshadeに代表されるデータ汚染は、AIに誤った情報を学習させ、モデルを内部から破壊することを目的とした攻撃的なアプローチです。例えば、犬の画像を猫として誤認識させる「毒」を仕込み、AIの判断能力を根本から揺るがします。これはクリエイターによる積極的な自衛策であり、AI開発者との技術的な攻防の最前線と言えるでしょう。

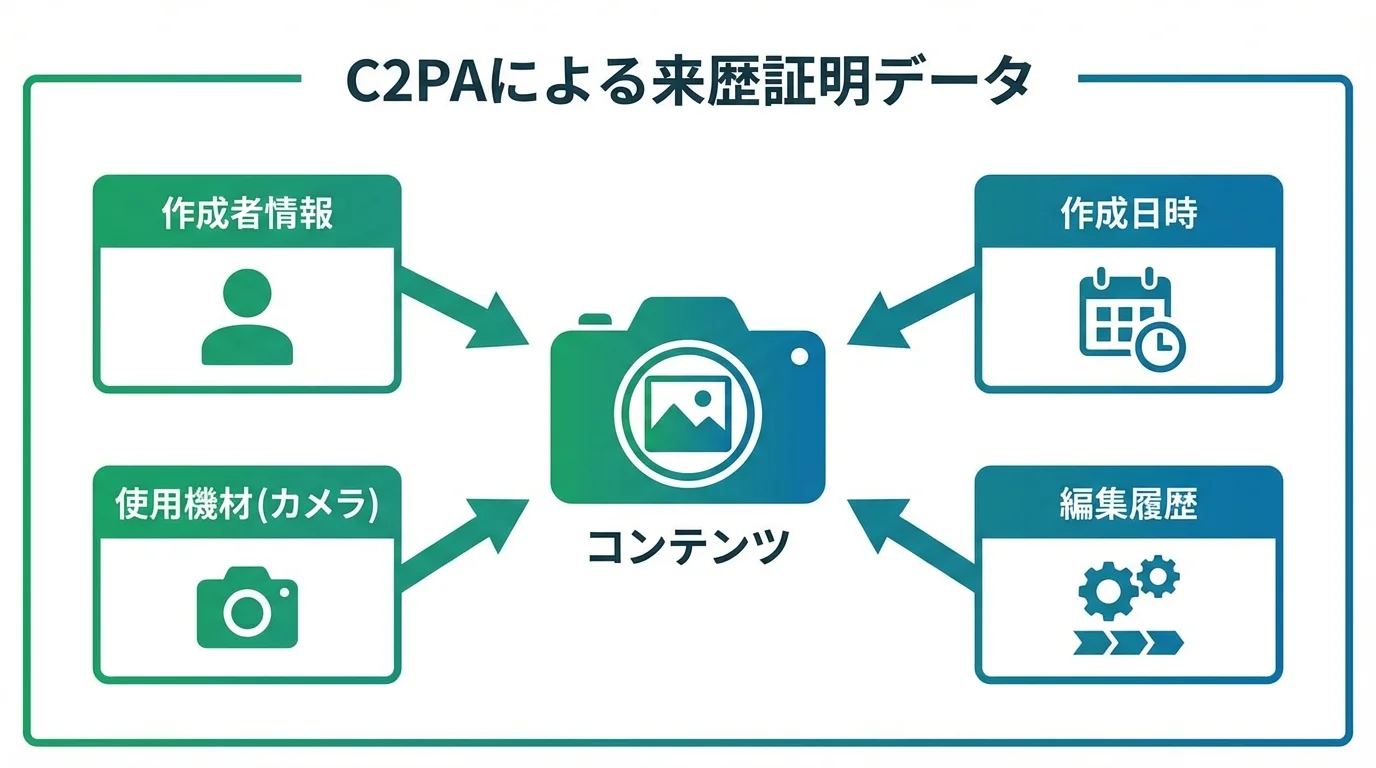

一方、AdobeやGoogleなどが推進するC2PA規格に基づく「コンテンツクレデンシャル」は、全く逆の発想です。これは、コンテンツの作成者や編集履歴といった「来歴」を記録・証明するための電子透かし技術です。このアプローチは、生成AIが作ったものか否かを明確にし、情報の信頼性を担保することで、AIとの共存を目指す動きです。このように、同じ「透かし」という言葉でも、その目的と戦略は大きく異なっているのです。

創作物を守るのが目的!AIの無断学習を拒否する強い味方

自身の作品が意図せず生成AIの学習データにされることは、多くのクリエイターにとって深刻な問題です。この不正利用に対抗する具体的な自衛策として、シカゴ大学が開発した「Glaze」や「Nightshade」は非常に心強い味方となります。GlazeはAIに独自の画風を誤認させて模倣を防ぎ、Nightshadeは学習データに「毒」を混ぜ込んでAIモデルを内部から破壊します。これらは単なる防御技術ではなく、クリエイターが「学習を拒否する」という明確な意思表示を行うための実践的ツールなのです。2026年から施行されるEUのAI法がオプトアウトの尊重を求めるなど、法整備も追い風となっており、こうした技術の重要性はますます高まっています。

AIの判断を狂わせる!データ汚染型技術の巧妙な仕組みとは

AIの学習データに「毒」を盛る——これがデータ汚染型技術の核心です。代表的なツールであるNightshadeは、人間の目にはほとんど分からないレベルで画像ピクセルを改変します。この微細な変更が、AIにとっては全く異なる意味を持つ情報となります。例えば、犬の画像にこの処理を施すと、AIはそれを「猫」として誤学習してしまうのです。このような汚染データが大量に学習データセットに紛れ込むと、生成AIモデルは特定の概念(この場合は「犬」)を正しく出力できなくなり、モデルの内部から性能が破壊されます。これは、これから学習を行うモデルに対する強力な対抗策ですが、AI開発側も「ポイズニング攻撃」の検知技術を開発しており、技術的ないたちごっこが続いています。

クリエイターの叫び - なぜ今、AIの無断学習が深刻な問題なのか

「見えない透かし」のような防御技術が、今なぜこれほどまでに求められているのでしょうか。それは、生成AIによる無断学習が、もはや単なる著作権侵害の域を超え、クリエイターの存在そのものを脅かす深刻な問題へと発展しているからです。自身の作風を瞬時にコピーされ、仕事を奪う「AIクローン」の出現は、魂を削って生み出した創作への冒涜に他なりません。本章では、クリエイターたちが直面する苦悩と、創作意欲が蝕まれていく痛切な現実を浮き彫りにします。

無断学習が生むAIクローン、創作者の仕事を奪う脅威

AIによる無断学習は、単なるデータ利用に留まらず、特定のクリエイターの画風やタッチを完全に再現する「AIクローン」を生み出す段階に至っています。これにより、オリジナルの作家が長年かけて築き上げた独自のスタイルが、安価な生成AIサービスによって瞬時に模倣され、本来クリエイターに依頼されるべき仕事が奪われるという深刻な事態が発生しているのです。この脅威に対し、クリエイターはGlazeのようなツールを用いてAIに意図的にスタイルを誤認させたり、Nightshadeで学習モデル自体を汚染したりといった自衛策を講じています。これはもはや単なる模倣ではなく、クリエイターのアイデンティティと経済的基盤そのものを破壊しかねない問題であり、技術と法整備の両面からの対策が急務となっています。

魂を削った作風がAIに消費される、創作意欲を蝕む現実

クリエイターが何年もかけて築き上げた独自の作風は、その人の魂の結晶です。しかし、特定の生成AIモデルは、その個性を数秒でデータとして吸収し、無限に模倣品を生み出します。これは単なる著作権侵害に留まらず、自らのアイデンティティが安価に消費されていくのを目の当たりにするという、精神的な苦痛を伴います。2026年現在も開発が続くGlazeやNightshadeといったツールは、この現状に対する必死の抵抗です。しかし、AI開発側との技術的な「いたちごっこ」は続き、完全な防御は困難です。自分の作品がいつ無断で学習されるか分からないという不信感は、新しいものを生み出す創作意欲そのものを蝕んでいくのです。

急速に進化するAI、クリエイターの権利侵害が深刻化

AIの進化は、もはや人間の学習速度を遥かに凌駕しています。かつては膨大なデータが必要だった作風の模倣も、今や少数の作品から特徴を抽出し、高精度で再現することが可能になりました。特に問題なのは、悪意がなくとも、誰もが手軽に使える生成AIツールによって、結果的に権利侵害に加担してしまう状況が生まれていることです。技術の進化に法整備が追いつかず、2026年にEUでAI法が施行されるなど対策は進むものの、依然としてクリエイターは自衛手段を講じざるを得ないのが現状です。この技術と倫理の乖離こそが、権利侵害を加速させ、問題をより深刻なものにしています。

EUのAI法も後押し?「透かし」技術が急速に注目される社会的背景

クリエイター個人の叫びから生まれた「透かし」技術は、今や社会全体を巻き込む大きなうねりへと変わりつつあります。その最大の推進力となっているのが、世界的な法整備の潮流です。特に2026年から段階的に施行されるEUのAI法は、AI開発者に学習データの透明性を求め、クリエイターの「学習させない」という意思表示を尊重するよう義務付けています。なぜ今、社会はここまで透明性を求め、法が技術の普及を後押しするのでしょうか。その背景にある、大きな時代の要請を読み解きます。

EUのAI法が追い風に!クリエイター保護の世界的潮流

クリエイターの自衛策として生まれた「透かし」技術が、今、法整備という強力な追い風を受けています。その象徴が、2026年から段階的に施行されるEUのAI法(AI Act)です。この法律はAI開発者に対し、学習データの開示や、著作権者が学習利用を拒否する「オプトアウト」の意思表示を尊重する義務を課します。これにより、「学習させない」という透かしに込められたクリエイターの意思が、単なる技術的な抵抗から法的な意味を持つ主張へと昇華する可能性が出てきました。この動きは欧州にとどまらず、米国カリフォルニア州でも学習データの透明性を義務付ける法律が施行されるなど、世界的な潮流となりつつあります。こうした法整備は、生成AI開発における透明性と倫理を問い直し、クリエイターの権利が尊重されるエコシステム構築への大きな一歩と言えるでしょう。

高まる透明性への要求、社会が透かし技術を求める理由

クリエイターの権利保護という枠を超え、今や社会全体がコンテンツの「出自」を問う時代になりました。その背景にあるのは、巧妙なフェイクニュースや偽情報が社会を混乱させるリスクです。私たちが日々接する情報が、人間によるものか生成AIによるものかを知ることは、もはや基本的な権利と言えるでしょう。この社会的な要請に応えるのが、Adobeなどが推進する「コンテンツクレデンシャル」のような来歴証明技術です。これは、AI生成物であることを示すだけでなく、誰がいつ作ったかという情報を記録することで、コンテンツの透明性を確保します。透かし技術は、もはや単なる防御策ではなく、デジタル社会の信頼性を支えるための必須インフラへと進化しているのです。

「学習拒否」の意思表示、法整備が技術の普及を加速させる

これまでクリエイター個人の自衛策と見なされてきた「学習拒否」の意思表示が、法整備という強力な追い風を受け、その意味合いを大きく変えようとしています。決定打となるのが、2026年から段階的に施行されるEUのAI法です。この法律は、AI開発者に対して著作権者が示した「オプトアウト(学習拒否)」の意思を尊重するよう義務付けています。これにより、GlazeやNightshadeといった透かし技術は、単なる妨害ツールではなく、「法的に意味のある意思表示」の手段へと昇華されるのです。法が「拒否する権利」を明文化し、技術がその具体的な行使手段を提供する。この相乗効果が、健全な生成AIのエコシステム構築を加速させていくでしょう。

【2026年最新動向】「C2PA」標準化と進化するAI学習妨害技術の最前線

クリエイターの権利保護を求める声は、技術開発を新たな次元へと押し上げています。2026年、その最前線で起きているのは二つの大きな潮流です。一つは、コンテンツの信頼性を証明する標準規格「C2PA」の普及。そしてもう一つは、AIの学習を妨害する技術と、それを無効化しようとするAI開発側の終わりなき「いたちごっこ」です。守りから攻めへ、そして信頼性の証明へ――進化する技術は、果たしてクリエイターの決定打となるのでしょうか。

信頼性の証明へ、C2PA標準化が導くコンテンツの未来

AI学習を妨害する技術とは別に、コンテンツの「出自」を証明することで信頼性を確保する動きが業界標準となりつつあります。その中心が、AdobeやGoogleなどが推進する標準規格「C2PA」です。これは、画像や動画に作成者や編集履歴といった来歴情報を電子透かしとして埋め込む技術です。もはや単なるソフトウェアの機能に留まらず、ニコンやソニーといったカメラメーカーが撮影時点で情報を付与する機能を開発するなど、コンテンツが生まれる源流から信頼性を担保する動きが加速しています。C2PAは学習を直接禁止しませんが、「来歴不明」コンテンツの価値が相対的に低下する未来を創り出します。これは、クリエイターが自身の作品の正当性を主張し、無数の生成AIコンテンツと差別化するための強力なインフラとなるでしょう。

守りから攻めへ!より巧妙化するAI学習妨害技術の今

これまでのAI学習妨害は、自身の作品を学習対象から外してもらう「守り」の発想が中心でした。しかし今、その潮流はより積極的な「攻め」へと転換しつつあります。その象徴が、シカゴ大学が開発した「Nightshade」です。これは、AIに画風を誤認させる「Glaze」の思想をさらに推し進め、学習データに毒を仕込むデータ汚染(ポイズニング攻撃)によって、無断学習を行う生成AIモデル自体を内部から破壊することを狙います。もちろん、AI開発側もこうした攻撃を検知・無効化する対抗技術を開発しており、まさに技術的な「いたちごっこ」の様相を呈しています。この攻防の激化は、クリエイターが自衛のために、より直接的で強力な手段を求め始めたことの表れと言えるでしょう。

誰が作ったかを示す、コンテンツ来歴証明技術の重要性

AIによるコンテンツ生成が日常化し、「何が本物か」を見極めることが困難な時代に、その重要性が再定義されています。もはや問題は著作権侵害だけに留まらず、社会全体の情報信頼性を揺るがしかねません。そこで不可欠となるのが、コンテンツの出自と履歴を証明するコンテンツ来歴証明技術、特にC2PA規格です。これにより、クリエイターは自身の作品の正当性を証明でき、生成AIによる安易な模倣に対抗する強力な武器を得ます。また、報道写真の来歴が保証されれば、それはフェイクニュースに対する社会的な防波堤となり得ます。この技術は、AIと人間が共存するための信頼性のインフラであり、デジタル社会の新たな秩序を築く上で欠かせない基盤なのです。

技術と法整備はクリエイターを救うか?「見えない透かし」が描く今後の展望

クリエイターを守る「見えない透かし」技術と、EUのAI法に代表される世界的な法整備。これまで別々に進んできた二つの潮流が、今まさに交わろうとしています。技術という「盾」が、法という「後ろ盾」を得るとき、クリエイターの権利保護はどのような新時代を迎えるのでしょうか。本章では、技術と法が両輪となって描く、公正な創作環境の未来を展望し、AI開発者に透明性を求める法的根拠がもたらす変化の可能性を探ります。

法規制と技術革新が両輪に!創作者保護の新時代が到来

クリエイター個人の自衛策だった「見えない透かし」は、今や法規制という強力な追い風を受け、その役割を大きく変えようとしています。2026年から段階的に施行されるEUのAI法では、AI開発者に学習データの開示や著作権者の「オプトアウト」を尊重する義務が課されます。これにより、Glazeなどの技術は単なる妨害ツールではなく、オプトアウトの意思を技術的に表明する法的な意味を持つ手段へと進化する可能性があるのです。技術という「盾」と法という「ルール」が連携し、クリエイターが自らの権利を主張できる、まさに生成AIとの共存に向けた新しい秩序が生まれつつあります。

法的根拠を得た「透かし」がクリエイターの権利を守る砦に

これまでクリエイター個人の自衛策だった「見えない透かし」は、今まさに法的な「盾」としての役割を帯びようとしています。その最大の転換点となるのが、2026年から段階的に施行されるEUのAI法です。この法律は、生成AIの開発者に対し、著作権者が学習利用を拒否する「オプトアウト」の意思表示を尊重するよう義務付けます。これにより、透かし技術は単なる妨害ツールではなく、クリエイターの明確な意思を示す法的に保護されるべき証拠へと昇華するのです。Nightshadeを施した作品が無断学習された場合、クリエイターは「オプトアウトの意思を踏みにじられた」と主張しやすくなります。まさに技術が法的な後ろ盾を得て、クリエイターの権利を守る強固な砦となる時代の幕開けと言えるでしょう。

AI開発者に透明性を要求、法が拓く公正な創作環境の未来

クリエイターによる自衛技術だけでは、AIの無断学習との「いたちごっこ」に終止符を打つことは困難です。そこで今、大きな転換点となっているのが、AI開発者側に情報の透明性を求める世界的な法整備の潮流です。例えば、2026年から段階的に施行されるEUのAI法では、開発者に対して学習データの要約を開示する義務が課せられます。同様に、米カリフォルニア州でも、学習データに著作物が含まれるかの情報公開を義務付ける法律が施行されました。これらの法規制は、クリエイターが「知らないうちに作品を使われる」という不利益な状況から脱却し、自身の権利を主張するための強力な後ろ盾となります。法が生成AI開発者に説明責任を課すことで、初めて公正な創作環境の土台が築かれるのです。

私たちの作品をどう守る?クリエイターが今すぐ取るべき具体的な対抗策

AIと法の大きな潮流を前に、ただ待つだけでは作品は守れません。大切なのは、自らの手で具体的な防御策を講じることです。AIモデルを内部から混乱させるデータ汚染ツール、作品の正当性を証明するC2PAへの対応、そして学習を拒否する明確な意思表示。本章では、クリエイターが今すぐ手に取れる「武器」を、具体的な手順と注意点を交えながら一つずつ解説していきます。

AI学習妨害ツールを導入、データ汚染で作品を守る

作品の来歴を証明する防御策とは別に、より直接的にAIへ介入する「データ汚染」という攻撃的なアプローチも存在します。代表格はシカゴ大学が開発した「Glaze」と「Nightshade」です。Glazeが画風の模倣を防ぐ“盾”であるのに対し、NightshadeはAIモデルに誤った情報を学習させ、内部から性能を破壊する“毒”として機能します。例えば、犬の画像に処理を施すことで、AIには猫として認識させるといった具合です。しかし、AI開発側もこうしたポイズニング攻撃を検知・除外する技術を開発しており、終わりのない技術的な攻防が続いています。これは単なる自衛策の域を超え、生成AIのエコシステム全体に倫理的な問いを投げかけているのです。

まずは意思表示から!AI学習のオプトアウトを宣言する

高度な技術的防御策を講じる前に、私たちがまず取り組むべき最も基本的で重要なステップがあります。それは「私の作品をAIの学習に利用しないでほしい」という明確な意思表示、すなわち「オプトアウト」の宣言です。具体的には、自身のWebサイトにrobots.txtファイルを設置し、特定の生成AIクローラーの巡回を拒否する方法が有効です。これはもはや単なるお願いではありません。2026年から段階的に施行されるEUのAI法は、このオプトアウトの意思を尊重するようAI開発者に求めており、クリエイターの宣言は法的な後ろ盾を得つつあります。技術という盾を構える前に、まずは自らの権利を声高に宣言すること。それが、無断学習との戦いにおける最初の防衛線となるのです。

作品の来歴を証明!C2PA対応ツールで信頼性を担保

AIの学習を妨害する攻撃的なアプローチとは別に、自らの作品の正当性を証明し、守りを固める方法があります。その中心となるのが、AdobeやMicrosoftなどが推進する標準規格「C2PA」です。これは、画像や動画に作成者や編集履歴といった「来歴情報」を埋め込む技術で、いわばデジタルコンテンツの「出生証明書」と言えるでしょう。すでにニコンやソニーは撮影時点でこの情報を記録するカメラの開発を進めており、私たちの創作活動に浸透しつつあります。この仕組みを使えば、万が一作品が無断利用された際に、自身のオリジナル性を客観的に証明する強力な証拠となります。C2PAは、生成AIが氾濫する時代において、作品の信頼性を自らの手で担保するための不可欠な盾となるのです。

「見えない透かし」は万能ではない?技術的な限界と残された課題

クリエイターの救世主として期待を集める「見えない透かし」だが、この技術を手放しで賞賛するのは時期尚早だ。透かしを無効化しようとするAI開発者との技術的ないたちごっこは既に始まっており、その効果は永続的ではない。本章では、こうした技術的な限界や、そもそも悪意ある開発者には無力である可能性、そしてクリエイターにのしかかる新たな負担といった、この技術が抱える不都合な真実を冷静に検証していく。

透かしを破るAI登場?終わりなき技術競争の現実

クリエイターが「Nightshade」のような毒を仕込んでも、それは所詮、一時しのぎに過ぎない。一部のAI開発企業は、こうしたポイズニング攻撃を検知し、学習データから自動的に除外する対抗技術の開発を公言している。まさに盾と矛の競争であり、防御策が編み出されれば、それを無効化する技術がすぐに後を追うという終わりなき技術競争の現実だ。さらに専門家は、規制の及ばないオープンソースAIでは、透かしを無効化する機能が組み込まれるリスクも指摘する。技術的な防衛策に過度な期待を抱くのは、あまりに楽観的と言わざるを得ない。

悪意ある開発者には無力?技術の実効性への根本的疑問

そもそも、透かし技術やEUのAI法といった対策は、AI開発者がルールを守るという性善説に立っていないだろうか。悪意ある開発者や、法規制の及ばない国の事業者にとって、これらは絵に描いた餅でしかない。オープンソースのAIモデルを改変し、透かしを検知・回避する機能を意図的に無効化してしまえば、全ての防御策は水泡に帰す。クリエイターからの「学習禁止」の意思表示など、彼らにとっては無視すればよいだけのデータだ。結局、技術や法は遵法精神のある相手にしか通用せず、紳士協定の限界を露呈している。悪意の前では、所詮は気休めに過ぎないというのが冷徹な現実である。

クリエイターへの新たな負担?導入コストと技術的障壁

AIから作品を守るという大義名分のもと、なぜクリエイターが新たな負担を強いられねばならないのか。GlazeやNightshadeといった自衛ツールは、導入や画像処理に手間と時間を要し、わずかな画質の劣化も作品の質を追求する者には看過できない。さらに、C2PAのような新しい標準規格への対応も求められ、創作以外の技術的障壁は増すばかりだ。本来、無断学習する側にこそ対策コストを負う責任があるはずが、現状は被害者であるクリエイターが自らのリソースを削って防御策を講じるという、実に歪な構図である。このままでは、技術リテラシーの差がクリエイター間の格差を広げ、創作に集中したい者が淘汰される本末転倒な未来が待っているだけだろう。

まとめ:AIとの共存時代へ - 「透かし」はクリエイターの権利を守る切り札となるか

生成AIによる無断学習という大きな課題に対し、「見えない透かし」はクリエイターの権利を守るための重要な鍵となり得ます。本記事で見てきたように、この技術は単なる防御策にとどまらず、C2PAのような標準化を通じてコンテンツの信頼性を担保し、AIとの共存に向けた新たな秩序を築く可能性を秘めています。

しかし、「透かし」は決して万能の盾ではありません。技術的な限界や、法整備との連携など、乗り越えるべき課題も残されています。この技術を真の「切り札」とするためには、私たち一人ひとりがクリエイターの権利について考え、倫理的なAI活用を社会全体で推進していく必要があります。AIと創造性が共栄する未来は、私たちの選択にかかっているのです。

自社のビジネスにAIをどう活かせば良いか、具体的な戦略を描けていますか?

【期間限定】2025年最新版『AI・DX推進戦略ハンドブック』無料プレゼント中です。100社以上の相談実績から導き出した「失敗しないAI導入の7ステップ」を解説しています。ご希望の方には、ハンドブックの内容に基づいた「自社専用AI活用ロードマップ」の無料作成会も実施しておりますので、ぜひこの機会にご活用ください。