なぜ今、AIリスク管理が重要視されるのか?

AIのビジネス活用が急速に拡大する一方、その裏に潜むリスクを見過ごすことはできません。誤った判断による信用の失墜や、情報漏洩、差別的なアウトプットなど、その危険性は多岐にわたります。本セクションでは、世界的な法規制の強化や、企業の社会的責任といった観点から、なぜ今「AIリスク管理」が単なる技術課題ではなく、企業の存続を左右する経営課題として重要視されているのかを解説します。

AI技術の急速な進化と社会への浸透

近年、ディープラーニングや生成AIの登場により、AI技術はかつてない速度で進化を遂げています。その影響は研究開発の領域に留まらず、医療の画像診断支援、金融の不正検知、製造業の品質管理など、社会のあらゆる場面で活用が不可欠なものとなりました。しかし、この急速な浸透は、アルゴリズミック・バイアスによる差別的な判断や、AIの意思決定プロセスが不透明なブラックボックス問題といった新たなリスクを生み出しています。これらのリスクを放置すれば、企業の信頼失墜や法規制違反に直結しかねません。そのため、AIの恩恵を安全に享受するためには、プロアクティブなリスク管理体制の構築が今、強く求められているのです。

顕在化する倫理的・法的な課題への対応

AIの普及は、採用AIにおけるバイアスや差別、個人データの不適切な利用といった倫理的な問題を顕在化させています。さらに、生成AIによる著作権侵害リスクや、EUのAI規制法のように、法的な枠組みも急速に整備されており、これらに準拠できなければ事業継続が困難になる可能性があります。

これらの課題に対応するため、企業は独自のAI倫理ガイドラインを策定し、全社的に浸透させることが不可欠です。また、判断プロセスを可視化する「説明可能なAI(XAI)」技術の導入や、学習データの品質を管理するデータガバナンス体制の構築が、法的・倫理的リスクを回避し、信頼されるAI活用を実現する鍵となります。

国内外で進む法規制と高まる企業責任

AIの利活用が広がる中、そのリスクを管理するための法的な枠組み作りが世界中で加速しています。特に、EUのAI法(AI Act)は、リスクレベルに応じた規制を課すアプローチを採用し、グローバルな標準となりつつあります。日本国内でも、AI戦略会議を中心にルール整備が進められており、企業はAIによる判断の説明責任を強く問われるようになります。万が一、AIが差別的な判断や不利益を生じさせた場合、その責任は提供企業が負うことになります。こうした法的リスクに対応するためには、開発段階から倫理原則を組み込み、AIガバナンス体制を構築することが急務です。自社のAI利用状況を把握し、定期的なリスクアセスメントを行うことが、事業継続の鍵となります。

AI導入に伴う主なリスクと企業への影響

AIの導入は業務効率化や新たな価値創出の強力な推進力となる一方、その裏には見過ごせない重大なリスクが潜んでいます。本セクションでは、情報漏洩やAIの判断ミス、倫理的な問題といった具体的なリスクを挙げ、それらが企業の信用の失墜や経済的損失にどう繋がるのかを詳しく解説します。

情報漏洩とセキュリティの脆弱性

AI、特に生成AIの利用は、意図しない情報漏洩の温床となり得ます。最も懸念されるのは、従業員がプロンプトに顧客情報や開発中の製品データといった機密情報を入力し、それがAIの学習データとして外部に流出するケースです。また、AIモデル自体へのサイバー攻撃によって、内部データが抜き取られるセキュリティの脆弱性も深刻な問題です。

対策として、まず「機密情報や個人情報をプロンプトに直接入力しない」という厳格な社内ガイドラインの策定と周知徹底が不可欠です。さらに、金融や医療など機密性の高い情報を扱う業界では、入力データを学習に利用しないセキュアなサービスを選定するか、オンプレミス環境で独自のAIモデルを運用することが極めて重要となります。

AIの誤った判断による事業信用の低下

AIの判断ミスは、単なるシステムエラーでは済まされず、企業の社会的信用を根本から揺るがすリスクを伴います。例えば、金融業界の与信審査AIがアルゴリズムバイアスによって特定の顧客層を不当に排除したり、採用AIが過去のデータに基づき無意識の差別を行ったりするケースです。これはブランドイメージの毀損に直結します。

この問題の根幹には、AIの判断過程が不透明な「ブラックボックス問題」や、学習データの質が挙げられます。対策として、AIの判断結果を継続的にモニタリングし、異常を検知する体制の構築が不可欠です。また、なぜその結論に至ったかを説明できる「説明可能性(XAI)」技術の導入や、重要な意思決定には必ず人間が介在するワークフローを設計することが、信用低下を防ぐ鍵となります。

法的・倫理的な責任問題の発生リスク

AIの生成物が、意図せず他社のコンテンツと酷似して著作権侵害にあたるケースや、学習データに起因するアルゴリズムの偏り(バイアス)によって不適切なアウトプットを生み出す法的・倫理的リスクがあります。例えば、金融業界の与信審査AIが特定の属性に不利益な判断を下す可能性も指摘されています。これらの問題を防ぐには、明確なAI利用ガイドラインの策定が急務です。入力データに個人情報や機密情報を含めないルールの徹底や、AIの生成物は必ず人間によるファクトチェックと倫理的観点からのレビューを行うプロセスを導入することが、企業の信頼を守る上で不可欠です。

AIリスク管理が企業の成長を加速させる3つのメリット

多くの企業でAI活用が進む一方、その潜在的なリスクへの懸念も高まっています。しかし、AIリスク管理は単なる防御策ではありません。むしろ、それは企業の成長を加速させるための攻めの戦略となり得るのです。本セクションでは、適切なリスク管理がもたらす「信頼性の向上」「イノベーションの促進」「持続可能な事業展開」という3つのメリットを具体的に解説します。

社会的信頼の獲得でブランド価値が向上

AIによる差別的な判断や個人情報の不適切な利用は、企業の信頼を一夜にして失墜させる深刻なリスクです。特に、判断プロセスが不透明なブラックボックス問題は、顧客や社会に大きな不安を与えかねません。

こうしたリスクに対し、企業がAI倫理ガイドラインを策定・公表し、AIの意思決定プロセスを説明可能にする取り組みは極めて重要です。このような「責任あるAI」を推進する姿勢は、企業の透明性と倫理観の高さを示し、顧客や取引先からの社会的信頼を獲得します。その信頼は、最終的に競合他社との明確な差別化要因となり、企業のブランド価値を大きく向上させるのです。

攻めのAI活用でイノベーションを創出

AI導入のリスクを恐れ、活用がPoC(概念実証)や限定的な業務に留まっていませんか。実は、適切なリスク管理体制こそが、イノベーション創出のアクセルとなります。例えば、製造業でAIの予測精度や判断根拠を継続的に監視する「AIガバナンス」を確立すれば、単なる検品自動化に終わりません。安心して基幹業務へAIを組み込めるため、サプライチェーン最適化や製品の需要予測といった事業の根幹にまで活用範囲を拡大できます。守りの体制が整うことで、競合他社が躊躇するような「攻めのAI活用」が可能になり、新たなビジネス価値を創出できるのです。

法規制遵守による事業の継続性を確保

AIの活用が急速に進む中、国内外で「EU AI法」や改正「個人情報保護法」といった法規制の整備が加速しています。これらの規制への対応を怠ると、巨額の罰金やサービス停止命令といった深刻なペナルティが課され、事業の根幹を揺るがしかねません。

特に金融業界の与信審査や人事評価AIなど、個人の権利に影響を与える領域では、アルゴリズムの公平性や透明性の確保が厳しく求められます。こうしたリスクを回避し事業の継続性を確保するためには、開発段階から倫理原則を組み込み、データ管理を徹底する「AIガバナンス体制」の構築が不可欠です。法規制遵守は、守りの一手であると同時に、社会からの信頼を獲得し、持続的な成長を遂げるための攻めの投資と言えるでしょう。

【業界別】AIリスク管理の導入事例と効果

AI技術の活用が広がる中、AIリスク管理はあらゆる業界で重要な課題となっています。しかし、具体的にどのような対策が有効なのでしょうか。本セクションでは、金融、医療、製造業などを中心に、AIリスク管理の先進的な導入事例とその具体的な効果を徹底解説します。各業界の成功例から、自社に最適なリスク管理体制を構築するヒントを見つけましょう。

金融業界:不正検知とコンプライアンス遵守の事例

金融業界では、巧妙化する不正取引や厳格な規制遵守が大きな課題です。AIはこれらのリスク管理に不可欠なツールとなっています。例えば、クレジットカードの不正利用検知では、機械学習モデルが個人の取引パターンを学習し、異常な取引をリアルタイムで検知します。これにより、従来のルールベースシステムでは見逃しがちだった未知の不正手口にも対応し、偽陽性(誤検知)を大幅に削減できます。また、マネーロンダリング(AML)対策では、自然言語処理(NLP)を用いて膨大な取引データやニュースを分析し、疑わしい取引の監視を自動化。コンプライアンス業務の効率化と高度化を実現しています。

医療業界:誤診防止と個人情報保護への取り組み

医療業界では、AIによる画像診断支援などが進む一方、誤診のリスクと機微な個人情報の保護が最重要課題です。これに対し、多くの医療機関ではAIをあくまで診断支援ツールとして位置づけ、最終的な診断責任は医師が負うという運用ルールを徹底しています。また、AIの判断根拠を可視化する説明可能なAI(XAI)技術の導入も、誤診防止に貢献します。個人情報保護の面では、データを匿名化・仮名化処理することはもちろん、外部から隔離されたセキュアな環境でAIを運用する対策が不可欠です。こうした多層的なリスク管理によって、医療の質の向上と患者の安全を両立させています。

製造業:品質管理の自動化と予知保全での効果

製造業では、人手による目視検査のばらつきや設備の突発的な故障が大きな経営リスクとなります。AIの導入はこれらの課題解決に効果的です。品質管理の面では、AI画像認識技術が活躍します。製品の微細な傷や欠陥を高精度かつ高速に検出することで、ヒューマンエラーのリスクを排除し、不良品の流出を未然に防ぎます。

また、予知保全では、設備のセンサーデータをAIが分析し、故障の兆候を事前に検知します。これにより、突然の生産ライン停止を防ぎダウンタイムを最小化。計画的なメンテナンスが可能となり、コスト削減と安定稼働を実現します。

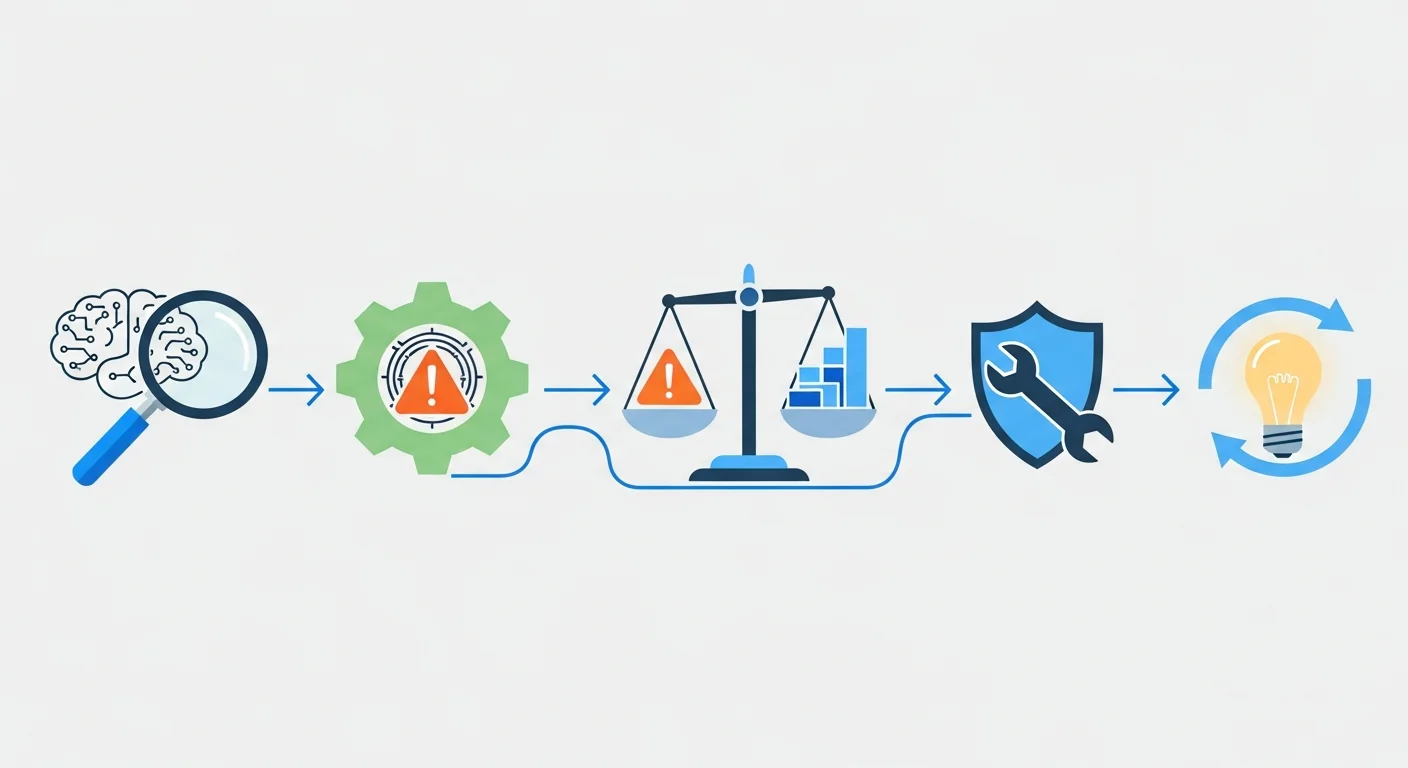

AIリスク管理体制を構築するための具体的なステップ

AIの導入が進む中、その潜在的なリスクをいかに管理するかが企業の重要課題です。本セクションでは、実効性のあるAIリスク管理体制を構築するための具体的なステップを、計画から運用、改善まで網羅的に解説します。リスクの特定と評価、そして継続的な監視に至るまでの実践的な手順を理解し、安全で効果的なAI活用を実現しましょう。

AI利用における潜在リスクの特定と評価

AIリスク管理の第一歩は、潜在リスクを網羅的に特定し、その影響を正しく評価することです。まずは、AIの利用目的や技術仕様ごとに「AIユースケースの棚卸し」を実施します。その上で、法務、開発、事業部門など関連部署を巻き込み、差別やバイアス、プライバシー侵害、セキュリティ脆弱性、説明責任の欠如といったリスクを洗い出します。

特定したリスクは、「発生可能性」と「事業への影響度」の2軸で評価し、優先順位を決定します。例えば金融業界の与信モデルにおけるバイアスや、医療分野での診断AIの誤診は、極めて深刻な影響を及ぼすため、特に高い優先度で評価すべきです。この評価結果をリスクマップとして可視化することが、効果的な対策を講じるための重要な基礎となります。

管理体制の構築と社内ガイドラインの策定

AIリスク管理の第一歩は、責任体制の明確化です。法務、IT、事業部門などから成る部門横断的な専門チーム(AI倫理委員会など)を設置し、有事の際の報告ルートや意思決定プロセスを定めます。次に、このチームが主導してAI利用ガイドラインを策定します。ガイドラインには、利用目的の定義、禁止事項、データ取り扱いのルール、著作権リスクの回避策などを明記しましょう。特に、金融業界における与信モデルの公平性担保など、自社の事業に潜む特有のリスクを洗い出し、具体的な指針を盛り込むことが実効性を高める鍵です。策定後は、定期的な見直しと従業員教育を徹底し、形骸化を防ぎます。

継続的なモニタリングと改善プロセスの導入

AIのリスク管理は、体制を構築して終わりではありません。市場環境やユーザー行動の変化により、AIモデルの性能は時間と共に劣化する可能性があるため、継続的なモニタリングが不可欠です。

具体的には、入力データの傾向が変化する「データドリフト」や、予測精度などの「モデルのパフォーマンス低下」を監視するダッシュボードを整備します。そして、設定した閾値を超えた際にアラートを発する仕組みを導入しましょう。検知された問題に対しては、原因を分析し、定期的な再学習やアルゴリズムのチューニングを実施します。この監視・分析・改善のPDCAサイクルを組織的に回すことが、AIの価値を長期的に維持し、信頼性を確保する鍵となります。

AIリスク管理を成功に導くためのポイント

AI技術の活用を推進する上で、潜在的なリスクへの対策は避けて通れません。AIリスク管理を形骸化させず、ビジネスの成長に繋げるためには、どのような点に注意すべきでしょうか。このセクションでは、AI活用の成功を左右する重要なポイントを、組織体制の整備から技術的な対策、継続的なモニタリングまで具体的に解説していきます。

潜在的リスクを網羅的に特定・評価する

AIリスク管理は、潜在的リスクを網羅的に特定・評価することから始まります。企画・開発から運用・廃棄に至るAIのライフサイクル全体を俯瞰し、技術的な欠陥だけでなく、データの偏りによる差別的な判断といった倫理的・法的・社会的側面からのリスク特定が不可欠です。実践的なアプローチとして、多様な部門を巻き込んだリスクシナリオの洗い出しや、NIST AI RMFのようなフレームワークの活用が有効です。特定したリスクは「発生可能性」と「影響度」で評価するリスクマトリクスを用いて優先順位を付け、対策の礎とします。

全社横断でのAIガバナンス体制を構築する

AIリスク管理は、開発部門や特定部署だけの課題ではありません。部門ごとにAIの利用方針やリスク評価が異なると、思わぬコンプライアンス違反やブランドイメージの毀損に繋がります。この課題を解決するためには、経営層の主導のもと、法務、開発、事業部門など複数の部署を巻き込んだ「AIガバナンス委員会」のような横断組織を設置することが不可欠です。この組織が中心となり、全社共通のAI利用ガイドラインを策定し、開発から運用、廃棄に至るまでのライフサイクル全体を管理する責任を負います。定期的なリスクアセスメントの実施や、インシデント発生時の対応フローを明確に定めることで、実効性のあるガバナンスが実現します。全社一丸となってAIと向き合う姿勢が、持続可能なAI活用とリスク管理の鍵となります。

継続的なモニタリングと改善の仕組みを作る

AIモデルを取り巻く環境は常に変化するため、一度のリスク評価で完結することはありません。市場や顧客の行動変化によって発生するデータのドリフト(入力データの傾向変化)や、新たな脆弱性を常に監視する仕組みが不可欠です。

具体的には、モデルの精度、公平性、セキュリティ指標などを可視化する監視ダッシュボードを構築し、設定した閾値を超えた際にアラートを発する体制を整えましょう。そして、定期的なレビューを通じて課題を特定し、モデルの再学習や改善プロセスを回すMLOpsの体制を整備することが重要です。この継続的な改善サイクルこそが、AIの価値を長期的に維持する鍵となります。

まとめ

AIの活用がビジネス成長に不可欠な現代において、そのリスク管理は企業の未来を左右する重要な経営課題です。本記事で解説したように、データ偏りやセキュリティといったリスクへの対策は、単なる防御策ではありません。適切なAIリスク管理は、企業の信頼性を高め、イノベーションを促進し、持続的な成長を支える攻めの戦略となります。

効果的な「リスク管理」こそが、「AI」のポテンシャルを最大限に引き出す鍵です。まずは自社のAI利用状況と潜在リスクの把握から、体制構築への第一歩を踏み出しましょう。