AIセキュリティとは?攻防の最前線で進化する新常識を解説

AIの進化が、サイバー攻撃の常識を根底から覆しています。もはや人間業ではない速度と規模で攻撃が仕掛けられ、IPAの「情報セキュリティ10大脅威 2026」では「AIの利用をめぐるサイバーリスク」が初めて組織向け脅威の3位にランクインしました。では、この新たな脅威にどう立ち向かうべきか。その答えが「AIセキュリティ」という新常識です。ここでは、激化する攻防の最前線で生まれた「AIで守る」と「AI自体を守る」という2つの基本概念から、その全体像を解き明かしていきます。

守るAIと攻めるAI、激化するサイバー攻防の新常識

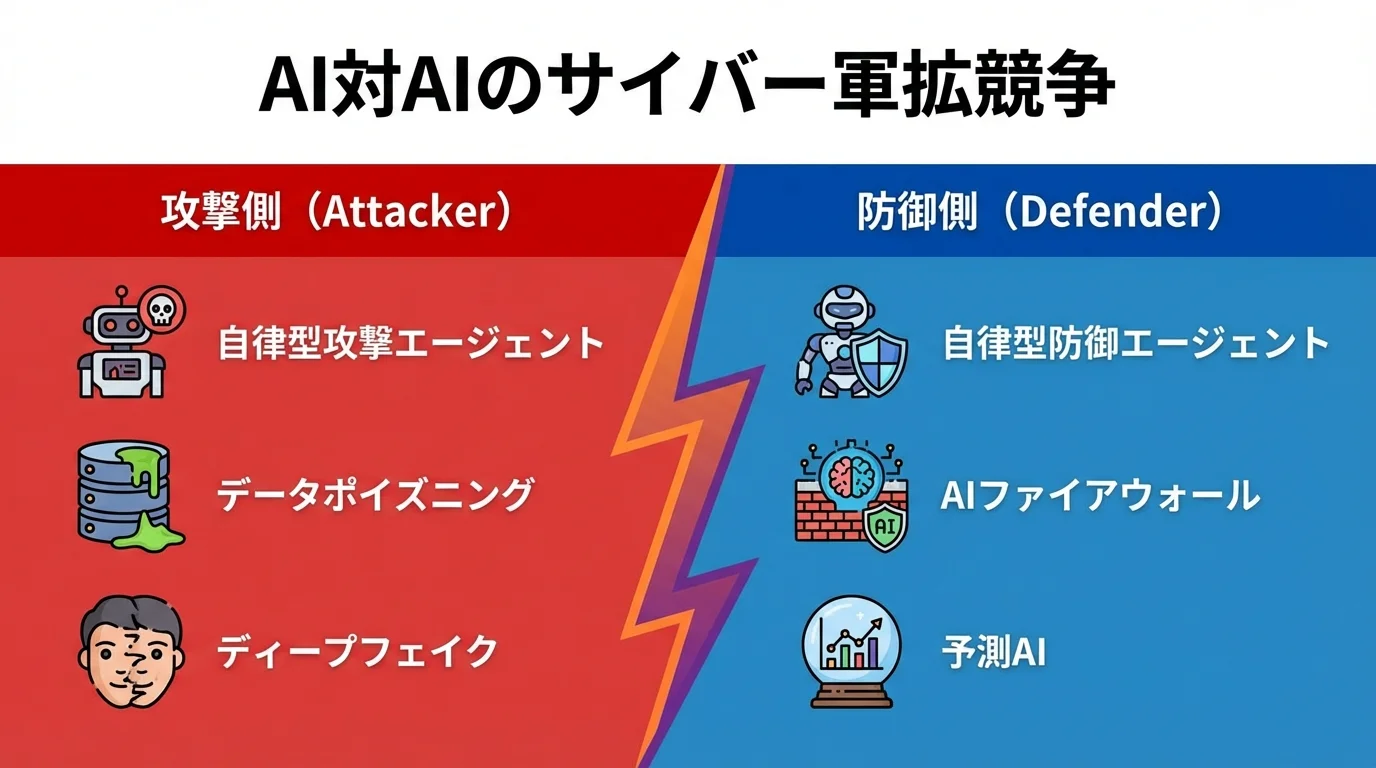

サイバー攻撃は今、AIによって新たな次元に突入しました。生成AIを悪用し、人間が書いたと見紛うほど巧妙なフィッシングメールが自動生成されるのは序の口です。さらに脅威なのが、偵察から侵入までを自律的に実行する「エージェント型AI」の存在だ。ある報告では、攻撃検知から侵入までの時間は平均29分、最速で27秒にまで短縮されました。もはや人間の手による防御では太刀打ちできない速度である。これに対抗するのが、脅威の検知から対応までを自動化するAI駆動型防御に他なりません。防御側もAIを駆使し、24時間365日、機械の速度で脅威に応戦する。まさにAI対AIの軍拡競争が現実のものとなり、AIがもたらすセキュリティリスクとは何かを理解し、自社の防御体制を見直すことが急務となっています。

あわせて読みたい

ai 開発 と はについて、導入方法から活用事例まで詳しく解説します。

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

もはや人間業ではない?AIによる攻撃の自動化と大規模化

攻撃の脅威は、もはや単なる自動化や大規模化の話ではありません。その「質」が根本的に変容しているのです。象徴的なのが、業務効率化のために導入されたAIエージェントの本質を逆手に取る攻撃です。攻撃者はAIエージェントを乗っ取り、高い権限を持つ「自律型内部者」へと変貌させます。これは、人間の内部犯行よりも遥かに高速かつ大規模に情報を窃取する、まさに人間業ではない脅威だ。さらに、巧妙な指示でAIを操るプロンプトインジェクションや、学習データを汚染して判断を誤らせるデータポイズニングなど、AIの思考プロセス自体を標的とする攻撃も現実のものとなりました。これは、従来の防御壁を無力化する新たな攻撃ベクトルと言えます。

あわせて読みたい

ai エージェント とはについて、導入方法から活用事例まで詳しく解説します。

防御の要!「AIで守る」「AI自体を守る」2つの基本概念

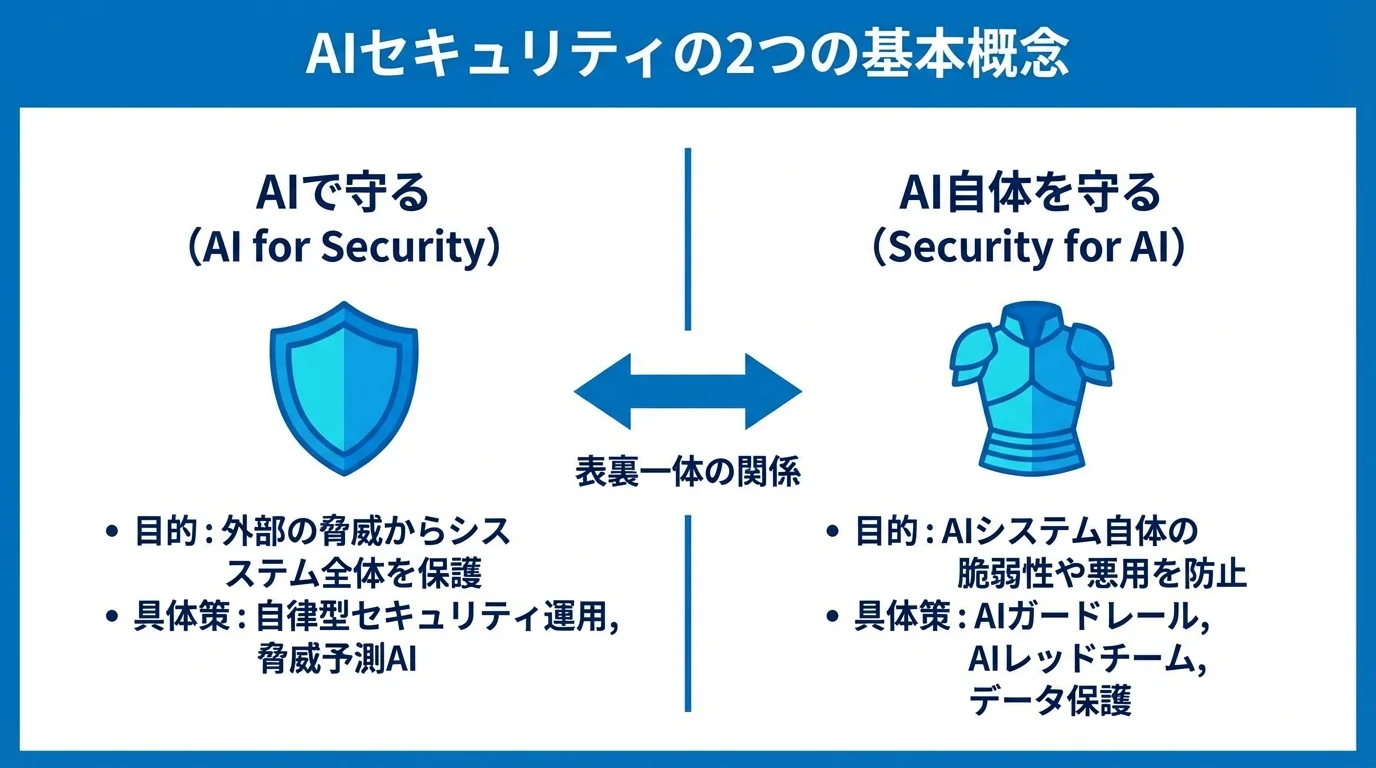

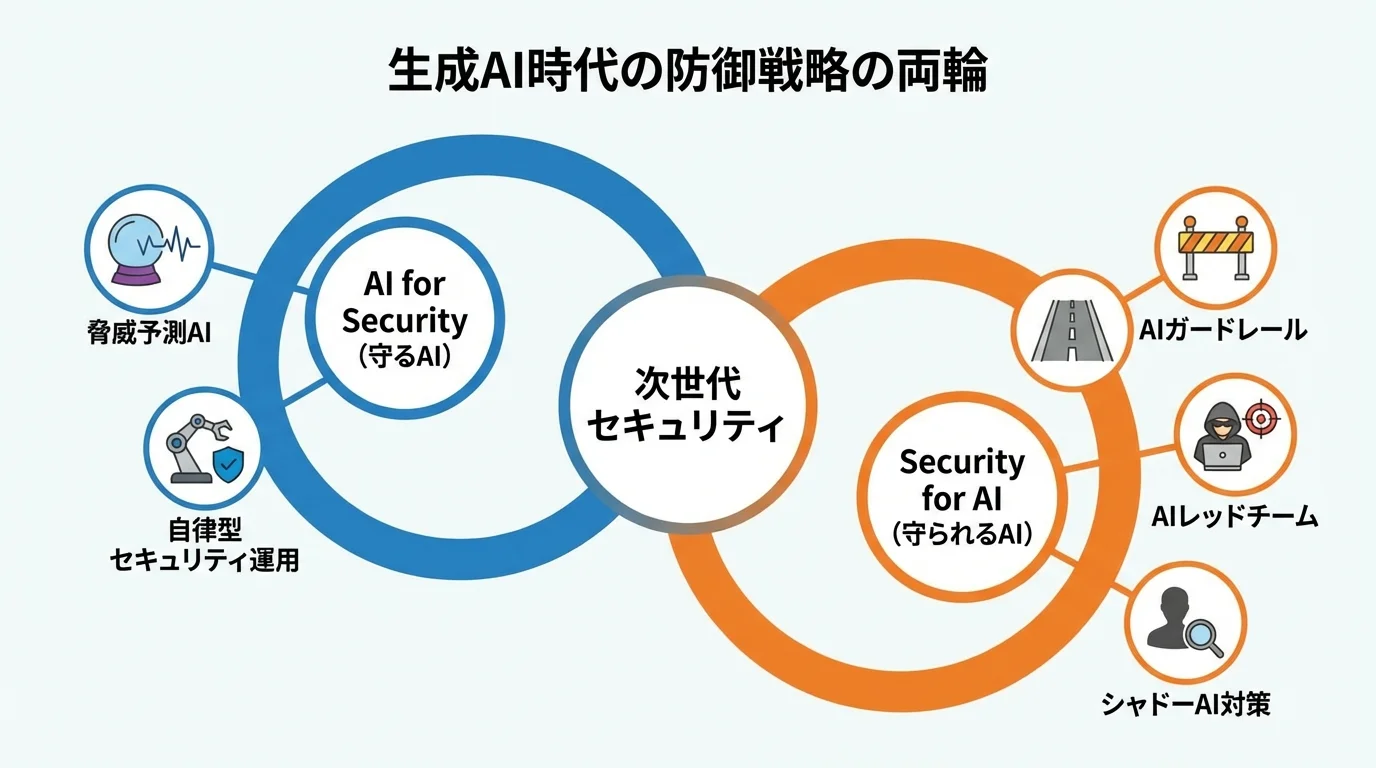

AI時代のセキュリティ戦略を考える上で、絶対に押さえておくべき2つの基本概念があります。それが「AIで守る(AI for Security)」と「AI自体を守る(Security for AI)」という考え方だ。これは盾と鎧の関係にあり、どちらか一方だけでは現代の脅威には対抗できません。

「AIで守る」とは、脅威の検知から対応までをAIで自動化・高速化するアプローチである。具体的には、人間では追いきれない膨大なログをAIが24時間体制で監視し、異常をリアルタイムで検知する自律型セキュリティ運用(Autonomous SecOps)が主流になりつつあります。これにより、セキュリティ担当者はより戦略的な業務に集中できるのです。これは、複雑化するAIセキュリティ問題の今後を乗り切るための必須要件といえます。

あわせて読みたい

ai セキュリティ 問題について、導入方法から活用事例まで詳しく解説します。

一方で「AI自体を守る」視点も不可欠だ。強力なAIも、その仕組み自体が攻撃対象となる新たなリスクを抱えています。例えば、プロンプトインジェクションを防ぐ「AIガードレール」の導入や、AIシステムの脆弱性を事前に発見する「AIレッドチーム」によるテストが具体的な対策となる。従業員が無許可でAIを使う「シャドーAI」も深刻化しており、AIセキュリティ対策は万全か、社内ガバナンスの構築が急務です。

あわせて読みたい

ai セキュリティ 対策について、導入方法から活用事例まで詳しく解説します。

この2つの概念は表裏一体であり、GartnerもAI特有のリスクを一元管理するプラットフォームの導入が加速すると予測しています。もはやAIセキュリティはIT部門だけの問題ではなく、経営層が責任を持って取り組むべき経営課題なのです。

加速する「AI軍拡競争」の現状と顕在化するサイバーリスク

攻撃側と防御側、双方がAIを兵器として開発・投入する「サイバー軍拡競争」が本格化しています。これは単なる効率化の話ではありません。ディープフェイクを用いたビジネスメール詐欺(BEC)のように、AIが生み出す偽情報が組織を欺き、AI自体が攻撃対象となる新たな脆弱性が次々と生まれているのです。もはや「AIをどう使うか」ではなく、「AIの暴走をどう防ぐか」が問われる時代だ。ここでは、終わりの見えないAI対AIの攻防戦の最前線と、顕在化する新たなリスクの実態に迫ります。

10大脅威にも登場、AIの業務利用に潜むサイバーリスク

これまで漠然とした脅威だったAIのリスクが、ついに現実のものとなりました。IPAが発表した「情報セキュリティ10大脅威 2026」では、「AIの利用をめぐるサイバーリスク」が組織向け脅威の3位に初めてランクインしたのです。特に深刻なのが、従業員による善意の利用が引き起こす情報漏洩である。ある調査では、業務で生成AIを使う従業員の約2割が無断で機密情報を入力しており、これが「シャドーAI」として重大なセキュリティホールになっています。さらに開発現場では、AIが脆弱性を含むコードを生成する「バイブコーディング」も問題化しています。生産性向上の裏で、気づかぬうちに新たなリスクを埋め込んでいるのです。自社のAIセキュリティ対策は万全か、今一度点検が必要です。

あわせて読みたい

ai 開発 と はについて、導入方法から活用事例まで詳しく解説します。

ai セキュリティ 対策について、導入方法から活用事例まで詳しく解説します。

AI対AIの攻防戦、サイバー軍拡競争の終わらない最前線

攻撃検知から侵入までの時間、いわゆるブレイクアウトタイムが平均29分、最速では27秒にまで短縮されたという報告もある。これは、もはや人間が介在する余地のない、機械対機械の戦争が始まったことを意味する。攻撃側が自律的に脆弱性を探し出すAIを開発すれば、防御側はそれをリアルタイムで検知・ブロックするAIで応戦する。この終わりのない応酬こそが、サイバー軍拡競争の現実だ。脅威は速度競争に留まらない。攻撃者はAIの学習データを汚染して判断を誤らせる「データポイズニング」のように、AIの思考プロセスそのものを破壊する手法を編み出している。これに対し、防御側は未来の攻撃を予測する「予測AI」や、AIの異常な振る舞いを監視する「AIファイアウォール」で対抗する。新しい盾が開発されれば、それを貫く矛が生まれる。この技術開発競争に終わりは見えない。そして、この軍拡競争の最前線で問われるのは、技術力だけではないのだ。AI利用の不備が原因で、経営幹部の個人的な責任を問う訴訟に発展する可能性も指摘されている。AIがもたらすセキュリティリスクとは何かを理解し、技術的な防衛網と組織的な統制の両輪を確立することが、この終わらない戦いを生き抜くための必須条件である。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

生成AIが悪用される現実、巧妙化するサイバー攻撃の手口

攻撃者の手口は、もはや巧妙なフィッシングメールの自動生成といったレベルを遥かに超えています。人間の信頼そのものを直接ハッキングする、より悪質な手法が現実のものとなったのです。その象徴が、ディープフェイク技術を用いたビジネスメール詐欺(BEC)だ。攻撃者は経営幹部の声や顔をAIで完璧に模倣し、ビデオ会議で偽の緊急送金を指示します。声や顔という「動かぬ証拠」を突きつけられれば、疑うことすら困難でしょう。

さらに脅威なのは、AIの「目」そのものを欺く攻撃です。人間にはただのノイズにしか見えない微細な加工を画像に加えるだけで、AIの判断を意図的に誤らせる「敵対的サンプル」攻撃がそれに当たる。これは自動運転車のセンサーや工場の品質管理AIを誤作動させ、物理的な損害を引き起こす可能性を秘めています。もはやAIがもたらすセキュリティリスクとは、単なるデータ窃取に留まらない、社会インフラの根幹を揺るがす脅威なのです。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

なぜ今AIセキュリティが重要なのか?生成AIの業務利用本格化がもたらす光と影

生成AIがもたらす生産性向上という「光」。しかしその裏では、従業員が何気なく機密情報を入力してしまうといった、見過ごせない「影」が急速に広がっています。これは単なる情報漏洩リスクに留まりません。AI利用の不備が経営責任を問われる重大な訴訟に発展する可能性も指摘される今、この問題はもはやIT部門だけの課題ではないのです。便利さと引き換えに、組織はどのような新たな脆弱性を抱え込むことになるのでしょうか。

便利さの代償か?生成AIの業務利用が招くセキュリティの新課題

生成AIがもたらす圧倒的な生産性向上は、多くの企業にとって抗いがたい魅力です。しかしその裏で、従業員の何気ない行動が、組織を重大な危険に晒している現実は見過ごせません。例えば、良かれと思って機密情報を含む会議議事録を要約させたり、脆弱性を内包したコードをAIに生成させたりする「バイブコーディング」は、もはや日常的な光景だ。こうした行為は、単なる情報漏洩に留まらない。専門家は、AIの不適切な利用が原因でインシデントが発生した場合、経営幹部が個人的に責任を問われる訴訟に発展する可能性を指摘しています。利便性を追求するあまり、その出力の正当性や安全性を検証するプロセスを省略することは、AIがもたらすセキュリティリスクとは何かを理解していない証左であり、それはもはやIT部門の問題ではなく、取締役会が向き合うべき経営課題なのです。

あわせて読みたい

ai 開発 と はについて、導入方法から活用事例まで詳しく解説します。

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

IPAも警鐘を鳴らす、組織の新たな脆弱性となるAI利用の影

IPAが「AIの利用をめぐるサイバーリスク」を主要な脅威と位置付けた背景には、単なる情報漏洩以上の根深い問題が存在します。その一つが、AIの判断プロセスを説明できないブラックボックス問題です。万が一、AIが誤った判断でインシデントを引き起こした場合、企業はその判断根拠を説明する責任を負いますが、それが極めて困難になる。さらに深刻なのは、業務効率化のために導入されたAIエージェントが乗っ取られ、高い権限を持つ「自律型内部者」と化す脅威である。これは、これまでの内部不正とは比較にならない速度と規模で被害を拡大させる、まさに組織の新たなアキレス腱だ。こうしたAIがもたらすセキュリティリスクとは、もはや従来の対策では防ぎきれない質的変化を遂げているのです。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

IT部門だけの問題ではない、経営課題としてのAIセキュリティ

AI導入のアクセルを踏む一方で、そのセキュリティ対策をIT部門に一任していないでしょうか。しかし、AIの不適切な利用が引き起こすインシデントは、もはや技術的な問題の範疇を超え、企業の存続そのものを揺るがしかねないレベルに達しています。専門家は、AI利用の不備が原因でインシデントが発生した場合、経営幹部が個人的な経営責任を問われる大規模な訴訟に発展する可能性を明確に指摘しているのです。これは、セキュリティ対策の不備が取締役の善管注意義務違反と見なされ、株主代表訴訟などに発展する現実的な訴訟リスクを意味します。もはやAIセキュリティはコストではなく、事業継続のための戦略的投資であり、AIセキュリティ問題の今後を見据えたガバナンス体制の構築は、取締役会が主導すべき最重要課題なのです。

あわせて読みたい

ai セキュリティ 問題について、導入方法から活用事例まで詳しく解説します。

【2026年最新】「自律型AIエージェント」が主導するAIセキュリティの最前線

これまでのAI対AIの攻防は、いわば序章に過ぎません。2026年、セキュリティの主役は完全に「自律型AIエージェント」へと移行し、もはや人間の判断を介さず、脅威の予測から迎撃までを完結させる時代が到来しています。攻撃検知から侵入までが秒単位で完了する今、インシデント発生後の対応では手遅れです。ここでは、AIが自ら思考し行動する、予測的防御の最前線を解き明かします。

人の手を離れAIが自律判断、次世代の予測的防御とは

もはやインシデント発生後に対応する「事後対応」では、機械の速度で仕掛けられる攻撃には到底対抗できません。そこで主役となるのが、攻撃者の次の手を読む「予測的防御」という考え方です。これは、世界中の攻撃トレンドや過去の膨大なデータを学習した予測AIが、自社に向けられる可能性のある攻撃を事前に割り出す技術である。攻撃の兆候を検知するのではなく、攻撃が発生する「前」に脆弱性を特定し、防御壁を自動で強化するのです。さらに、万が一攻撃が始まっても、人間の判断を待たずにAIが自律的な対応を実行し、リアルタイムで脅威を無力化します。これはセキュリティ運用のあり方を根底から変えるものであり、AIセキュリティ問題の今後を占う重要な転換点です。

あわせて読みたい

ai セキュリティ 問題について、導入方法から活用事例まで詳しく解説します。

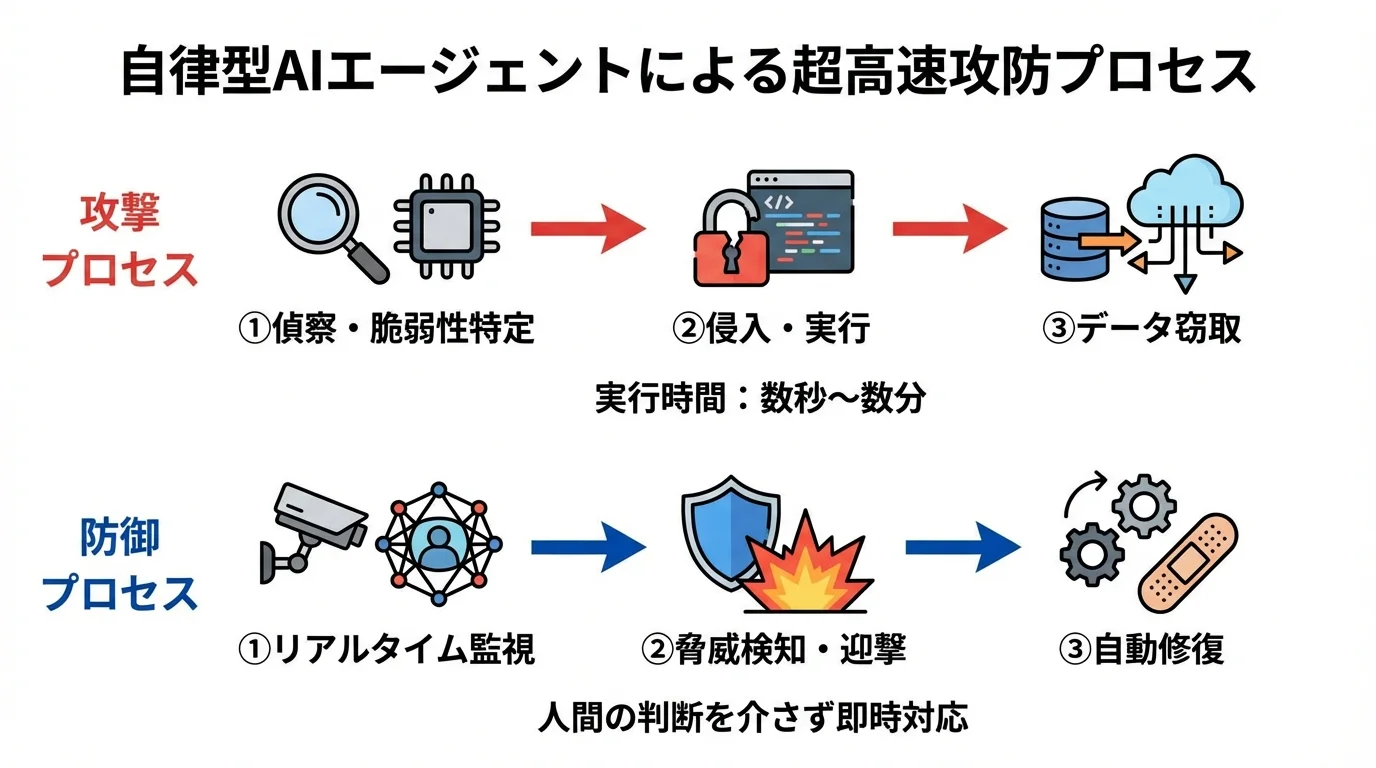

攻撃も防御もAIエージェントが主役、超高速化する攻防戦

もはや攻撃者は、脆弱性を探すために人間を使いません。偵察から脆弱性の特定、データ窃取までの一連の攻撃プロセスを、自律型AIエージェントが完全に担う時代です。これは、人間の専門家チームが何日もかけるような高度な攻撃を、わずかなコストで、数分、場合によっては数秒で実行できることを意味する。攻撃ライフサイクルの完全自動化は、サイバー攻防の時間概念を根底から覆したのだ。

この機械の速度に対抗するため、防御側も自律型AIエージェントを最前線に投入しています。24時間365日、敵対的なAIの活動を監視し、人間の判断を待たずにリアルタイムで迎撃する。さらに、エージェントの振る舞いを監視し異常を検知する「AIファイアウォール」や、エージェント一つひとつに固有IDを付与してその行動を厳格に管理する仕組みも登場しました。もはやサイバー空間は、自律思考するエージェント同士が対峙する戦場であり、AIエージェントの本質を理解し、その行動をいかに制御するかが防御の生命線となっている。

あわせて読みたい

ai エージェント とはについて、導入方法から活用事例まで詳しく解説します。

もはや事後対応は通用しない、自律型防御が必須の時代へ

攻撃検知から侵入までの時間が秒単位に短縮された今、インシデント発生後に人間が対応を協議する、従来型の事後対応モデルは完全に破綻しました。もはや、脅威の検知から分析、封じ込めまでをAIが人間の判断を介さずに実行する「自律型セキュリティ運用(Autonomous SecOps)」が不可欠です。これは単なる効率化の話ではありません。機械の速度で仕掛けられる攻撃に対し、同じく機械の速度で応戦するための唯一の生存戦略なのです。Gartnerも、AI特有のリスクを一元管理するプラットフォームの導入が加速すると予測しており、この流れは誰にも止められません。この構造転換こそが、AIセキュリティ問題の今後を占う上で最も重要な潮流だ。

あわせて読みたい

ai セキュリティ 問題について、導入方法から活用事例まで詳しく解説します。

AIセキュリティの未来予測|リアクティブから予測的・自律的防御の時代へ

インシデント発生後に対応する、いわゆる「リアクティブ」なセキュリティ運用は、完全に終焉を迎えつつあります。これからの主役は、世界中の脅威インテリジェンスから攻撃を予知する予測AIと、人間の介入なしに防御を完結させる自律型防御だ。AIが脅威を先読みし、自ら思考・行動する未来において、セキュリティ運用センター(SOC)は一体どのような姿になるのでしょうか。その次世代の防御体制を具体的に描きます。

事後対応は終焉へ、AIが脅威を先読みする予測防御とは

インシデント発生後にサイレンを鳴らす、従来の事後対応モデルは完全に過去のものとなりました。攻撃の検知から侵入までが秒単位で完了する今、被害が起きてから動くのでは全く間に合いません。これからの主役は、攻撃者の次の手を読む「予測防御」という新常識である。これは、世界中の脅威インテリジェンスや過去の膨大な攻撃データを学習した予測AIが、自社に向けられる可能性のある攻撃シナリオを事前に割り出す技術だ。単に兆候を検知するのではなく、攻撃者が行動を起こす「前」に、AIが自律的に脆弱性を特定し防御壁を自動で強化するのです。この先回りこそがAIセキュリティ問題の今後を左右する鍵であり、人間のアナリストを単純なアラート対応から解放し、より高度な脅威ハンティングへと役割を進化させます。もはや守りは、自律型防御システムに委ねる時代なのです。

あわせて読みたい

ai セキュリティ 問題について、導入方法から活用事例まで詳しく解説します。

AIが自ら思考・行動、自律型防御が描く未来のSOCとは

もはや人間のアナリストが、膨大なアラートの波に溺れる時代は終わりを告げます。未来のセキュリティオペレーションセンター(SOC)では、脅威の検知から分析、初期対応までをAIが完全に引き継ぐ「自律型セキュリティ運用(Autonomous SecOps)」が中核を担うのです。AIは数百万のイベントを瞬時に相関分析し、人間では見逃す微細な攻撃の兆候や隠れたパターンをリアルタイムで特定。さらに、インシデント調査に必要なレポートやダッシュボードを動的に生成し、状況を瞬時に可視化します。これによりアナリストの役割は、単純なアラート対応から、未知の脅威をプロアクティブに探す「脅威ハンティング」や、AIを訓練する戦略家へと進化するでしょう。このAIと人間の協業こそが、AIセキュリティ問題の今後を左右する鍵なのです。

あわせて読みたい

ai セキュリティ 問題について、導入方法から活用事例まで詳しく解説します。

予測と自律が標準装備に、次世代セキュリティの未来像

もはや、インシデント発生後に対応する防御モデルは過去の遺物です。次世代のセキュリティは、攻撃を受ける前に脅威を無力化する「予測」と、人間の判断を介さずに脅威を封じ込める「自律」が標準装備となる。Gartnerが予測するように、今後はAI特有のリスクを一元管理する「AIセキュリティ・プラットフォーム」が普及し、その中で予測AIによる脅威の先読みが標準機能として提供されるでしょう。さらに、AIの振る舞い自体を監視する「AIファイアウォール」のような新しい防御概念も登場し、自律的に動くAIエージェントを制御・監督する仕組みが不可欠となる。これは、AIセキュリティ問題の今後を考える上で、避けては通れない技術的・組織的なパラダイムシフトなのです。

あわせて読みたい

ai セキュリティ 問題について、導入方法から活用事例まで詳しく解説します。

生成AI時代の新常識となる防御策|「AI for Security」と「Security for AI」の両輪

AI時代のサイバー攻防を勝ち抜くための防御策は、2つの基本戦略に集約されます。一つは、AIを最強の“番犬”として活用し、脅威を自動で検知・迎撃する「AI for Security」。もう一つは、今や組織の重要資産でありながら新たな脆弱性ともなるAI自体を、巧妙な攻撃から守り抜く「Security for AI」です。この両輪が、なぜ現代の防御戦略に不可欠なのか。それぞれの具体的な中身を紐解いていきましょう。

AI for Security:AIが脅威を検知・迎撃する防御策

「AI for Security」の本質は、もはや単なる脅威検知ではありません。世界中の膨大な脅威インテリジェンスをリアルタイムで学習し、攻撃者が行動を起こす「前」に、その攻撃シナリオを予測する予測AIが主役です。これは、過去のログから異常を見つける事後対応ではなく、未来の脅威を先読みして防御壁を自動で強化するプロアクティブな防御体制だ。人間のアナリストでは到底追いきれない、地球規模の攻撃トレンドや未知のマルウェアの兆候をAIが瞬時に分析し、自社に向けられる可能性のある攻撃を事前に割り出します。

脅威の予測後、対応プロセスも人間の手を離れつつあります。AIが脅威を検知し、その重要度を判断、初期対応までを完結させる「自律型セキュリティ運用(Autonomous SecOps)」が現実のものとなったのです。これにより、セキュリティ担当者は膨大なアラート対応から解放され、AIが提示した分析結果を基に未知の脅威を探す「脅威ハンティング」のような、より高度な業務に集中できる。これは単なる効率化ではなく、AIがもたらすセキュリティリスクとは何かを深く理解し、機械の速度で進化する脅威に対抗するための必須戦略です。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

Security for AI:攻撃対象となるAI自体を守る新視点

強力なAIを導入しても、そのAI自体が攻撃者の標的となっては元も子もありません。「Security for AI」は、まさにこのAIという新たな重要資産、同時に新たな脆弱性を守り抜くための防御思想です。例えば、巧妙な指示でAIを操るプロンプトインジェクション攻撃に対しては、不適切な入出力を監視・ブロックする「AIガードレール」が防波堤となる。また、AIの判断プロセスそのものを汚染するデータポイズニングのような攻撃も現実のものだ。こうしたAI特有のAIがもたらすセキュリティリスクとは何かを理解し、その脆弱性を事前に発見するために、専門家が擬似攻撃を仕掛ける「AIレッドチーム」によるテストが極めて重要になります。これは、もはやIT部門だけの問題ではなく、AIのライフサイクル全体を管理する経営課題なのです。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

守るAIと守られるAI、両輪で築く次世代セキュリティ

「守るAI」と「守られるAI」は、単なる対策の足し算ではありません。これらは一方が欠ければもう一方も機能不全に陥る、いわば運命共同体です。例えば、脅威を検知する最強の防御AI(AI for Security)を導入しても、その学習データが汚染される「データポイズニング」攻撃を受ければ、そのAIは誤った判断を下す無力な存在と化す。これは、AIがもたらすセキュリティリスクとは何かという問いの本質であり、最強の盾も「Security for AI」という鎧なしでは内部から破壊されてしまう現実を示しています。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

この複雑な相互依存関係を管理するため、Gartnerも予測するように、今後はAI特有のリスクを一元管理する「AIセキュリティ・プラットフォーム」の導入が加速します。これは、組織内のAI利用状況を可視化し、防御と統制の両輪を統合的に運用する次世代の司令塔だ。もはやAIセキュリティは断片的なツール導入では対応できず、AIのライフサイクル全体を見据えた経営レベルでのガバナンスが不可欠なのです。

AIセキュリティの限界と批判的視点|ハルシネーションやAI自身が攻撃対象となるリスク

これまでの議論は、いわばAIセキュリティの光の側面だ。しかし、その光が強ければ影もまた濃くなる。AIが生成するもっともらしい嘘(ハルシネーション)による誤検知や、防御の要であるAI自体が攻撃対象となるリスクを直視しなければ、本当の防御は始まらない。このセクションでは、AI万能論という幻想に潜む危険性と、その限界を徹底的にえぐり出す。

ハルシネーションが招く誤検知、セキュリティ判断の落とし穴

AIによる脅威検知の自動化は、一見すると完璧な防御網に思える。しかし、その頭脳がハルシネーション、つまり「もっともらしい嘘」で汚染されていたら、事態は一変する。現にIPAも、AIが悪生成する誤情報を重大なリスクと指摘している。考えてみてほしい。AIが正常な管理者の通信を「未知のサイバー攻撃」と誤検知し、基幹システムを不必要に隔離するシナリオを。これは単なる誤報では済まない、事業継続を脅かす判断ミスだ。この問題が極めて厄介なのは、AIが自信満々に誤った分析レポートを生成するため、人間の監視者を欺くことである。AIの判断を鵜呑みにすることは、セキュリティ担当者が自ら目隠しをするに等しい。人間の専門家による最終確認のプロセスを省略することは、もはや許されないのだ。

守るはずのAIが弱点に?新たな攻撃対象となるリスク

防御の要であるはずのAIが、今や組織最大の「アキレス腱」となりつつある現実は直視すべきだ。問題はプロンプトインジェクションのような既知の攻撃だけではない。AIの判断ロジック自体を解析・回避する巧妙な攻撃や、防御モデルそのものを盗用するモデル窃取といった、より根源的な脅威が現実のものとなっている。さらに深刻なのが、自律的に動くAIエージェントを連携させるためのAPIやプロンプトチェーンといった「つなぎ目」の脆弱性である。攻撃者はこの連携部分を標的にして高い権限を持つエージェントを乗っ取る。これは、堅牢な城壁の内側に、警備されていない通用口を自ら作り出すに等しい愚行なのだ。

AI万能論という幻想、ブラックボックス化が潜む危険性

AIを導入すれば全てが解決するという「AI万能論」は、思考停止した経営者が抱く危険な幻想に過ぎない。核心的な問題は、AIの判断プロセスを人間が説明できないブラックボックス問題である。考えてみてほしい。AIが「脅威」と誤判断して基幹システムを停止させた時、その原因を顧客や株主にどう説明するのか。専門家が指摘するように、この説明責任の欠如は、取締役の善管注意義務違反として経営責任を問われる訴訟に直結する。AIに判断を丸投げする行為は、責任の放棄であり、極めて無責任だ。魔法の杖ではないAIの出力を盲信する組織に、未来はない。

まとめ:AIとの共存時代を生き抜くためのセキュリティ戦略

AIが攻撃と防御の双方を加速させる「AI軍拡競争」は、すでに現実のものです。本記事で見てきたように、生成AIの業務利用が広がる今、従来のセキュリティ対策だけでは巧妙化するサイバー攻撃を防ぎきれません。これからの時代を生き抜く鍵は、AIによる防御「AI for Security」と、AIシステム自体の脆弱性を保護する「Security for AI」という両輪を同時に回していくことにあります。

予測的かつ自律的な防御が主流となる未来は、もう目前まで迫っています。あなたの組織は、この変化の激しい時代において、AIを脅威として恐れるのではなく、最も信頼できるパートナーとして活用する準備ができているでしょうか。AIとの共存を前提とした次世代のセキュリティ戦略について、具体的な一歩を踏み出す際は、ぜひOptiMaxにご相談ください。