AIセキュリティリスクとは?利便性の陰に潜む脅威の本質を解き明かす

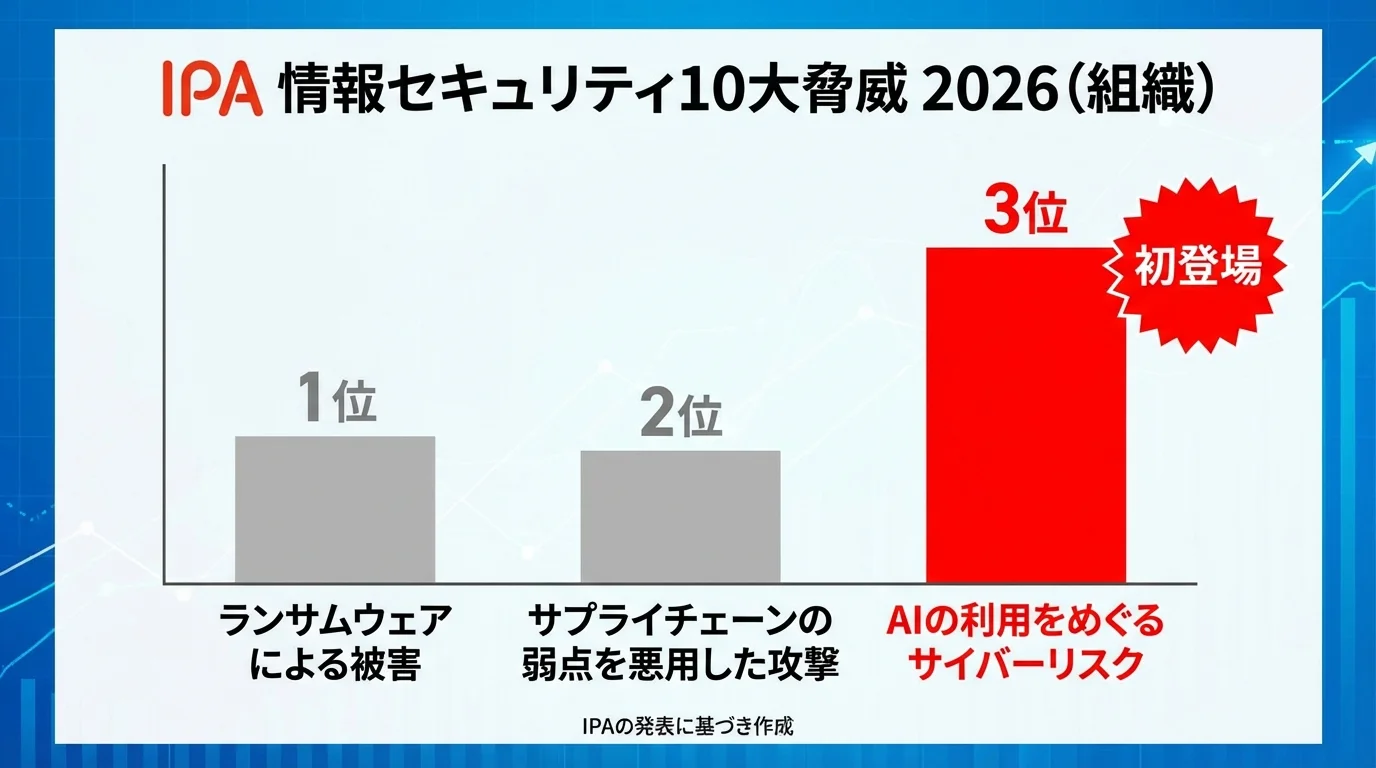

生成AIが業務効率化の切り札として急速に普及する一方で、その光の裏ではサイバー攻撃の常識を覆す深刻なリスクが生まれています。事実、独立行政法人情報処理推進機構(IPA)が発表した「情報セキュリティ10大脅威 2026」では、「AIの利用をめぐるサイバーリスク」が初登場でいきなり3位にランクインしました。これは、AIが悪用され攻撃が自動化・高度化するだけでなく、AI自体が新たな弱点となりうる現実を突きつけているのです。利便性の陰に潜む脅威の本質とは、一体何なのでしょうか。

IPAも警鐘、身近に迫るAIセキュリティリスクの実態

IPAが警鐘を鳴らす「AIの利用をめぐるサイバーリスク」の実態は、単なる技術的な脅威に留まりません。その本質は、攻撃の「速度」と「発生源」が根本的に変化した点にあります。AIによって攻撃プロセスが自動化された結果、攻撃者がシステム侵入後に内部活動を開始するまでの平均時間(ブレイクアウトタイム)は、わずか29分にまで短縮されました。これは、人間がインシデントを検知し対応する猶予が、もはや失われつつある現実を意味します。

さらに深刻なのは、リスクが社外からだけでなく、社内からも生まれているという事実です。従業員が会社の許可なく利用する生成AI、いわゆる「シャドーAI」に機密情報を入力してしまうことで、意図せず情報漏洩を引き起こすケースが後を絶ちません。この問題は、多くの企業が直面する企業におけるChatGPTのリスクとはという課題そのものです。利便性の裏側で、私たちが日常的に使うツール自体が新たな攻撃対象(アタックサーフェス)となっているのです。

あわせて読みたい

ChatGPT セキュリティ 企業 リスクについて、導入方法から活用事例まで詳しく解説します。

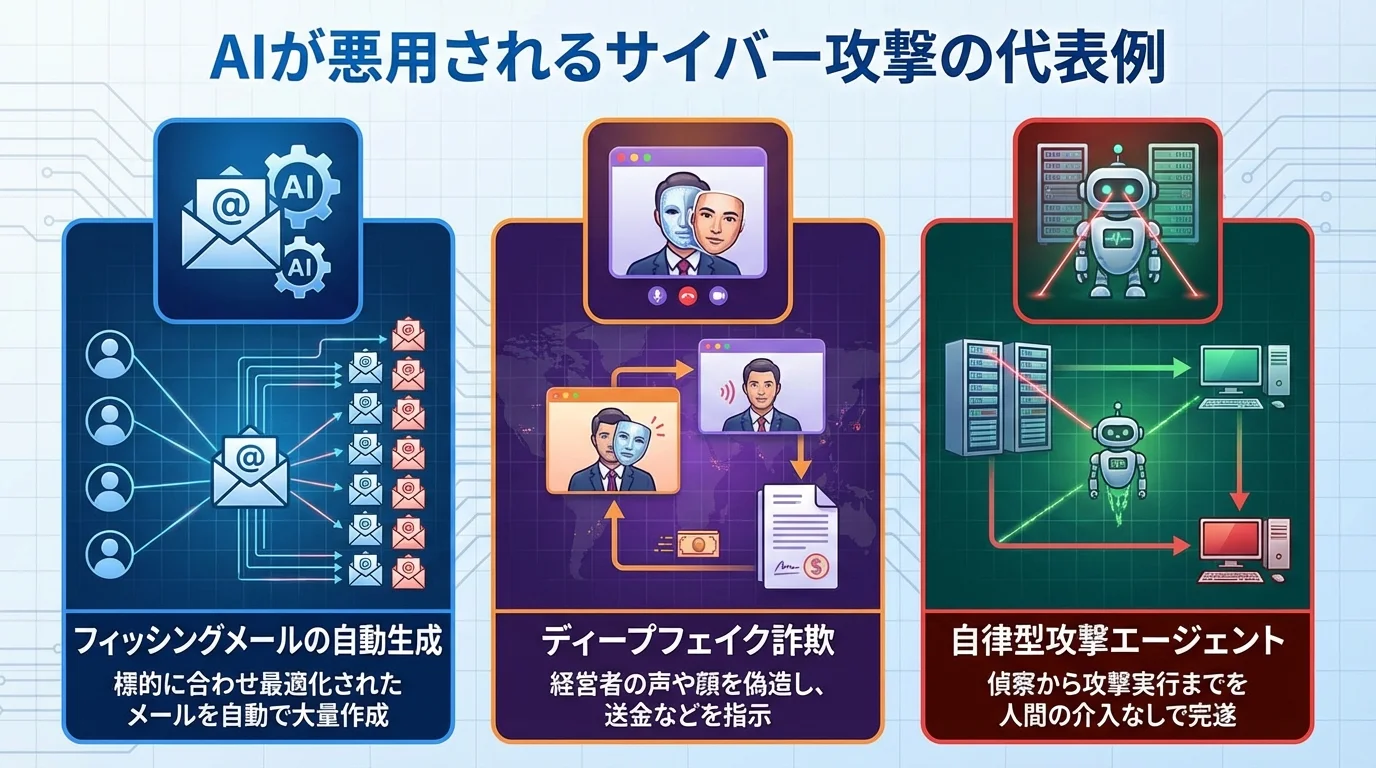

攻撃手法が激変!AIが悪用されるサイバー攻撃の新常識

AIによってサイバー攻撃は、もはや人間が手動で行うものではなくなりました。攻撃の「質」と「手口」が、根本から変貌を遂げているのです。例えば、生成AIは標的の役職や業務内容に合わせて最適化された、極めて自然なフィッシングメールを自動で大量に作成します。さらに深刻なのは、経営者の声や顔を偽造する「ディープフェイク」を用いたビジネスメール詐欺(BEC)です。あなたの会社のCEOを名乗る偽のビデオ通話で、経理担当者が送金を指示されるかもしれません。これは、金融AIのセキュリティ対策が経営の根幹を揺るがす課題であることを示唆します。また、自律的に判断し行動する「自律型攻撃エージェント」の登場は、脅威のレベルを一段階引き上げました。これらのAIは、脆弱性の偵察からマルウェアの自動生成、そして攻撃実行までを人間の介入なしで完遂します。AIによる攻撃は、技術的な防御網を突破するだけでなく、人間の認知や信頼そのものを標的にしているのです。

あわせて読みたい

金融 AI セキュリティについて、導入方法から活用事例まで詳しく解説します。

AI自身が弱点に?「AIエージェント」という新たな脅威

AIが攻撃者の「武器」として使われる脅威に加え、これからはAI自体が企業の最も脆弱な「弱点」となりうる、新たな局面を迎えています。その象徴が、自律的に業務を遂行する「AIエージェント」の存在です。これらのエージェントは、一度権限設定を誤ると、人間を遥かに凌ぐ速度で機密データにアクセスし、大規模な情報漏洩を引き起こす可能性があります。

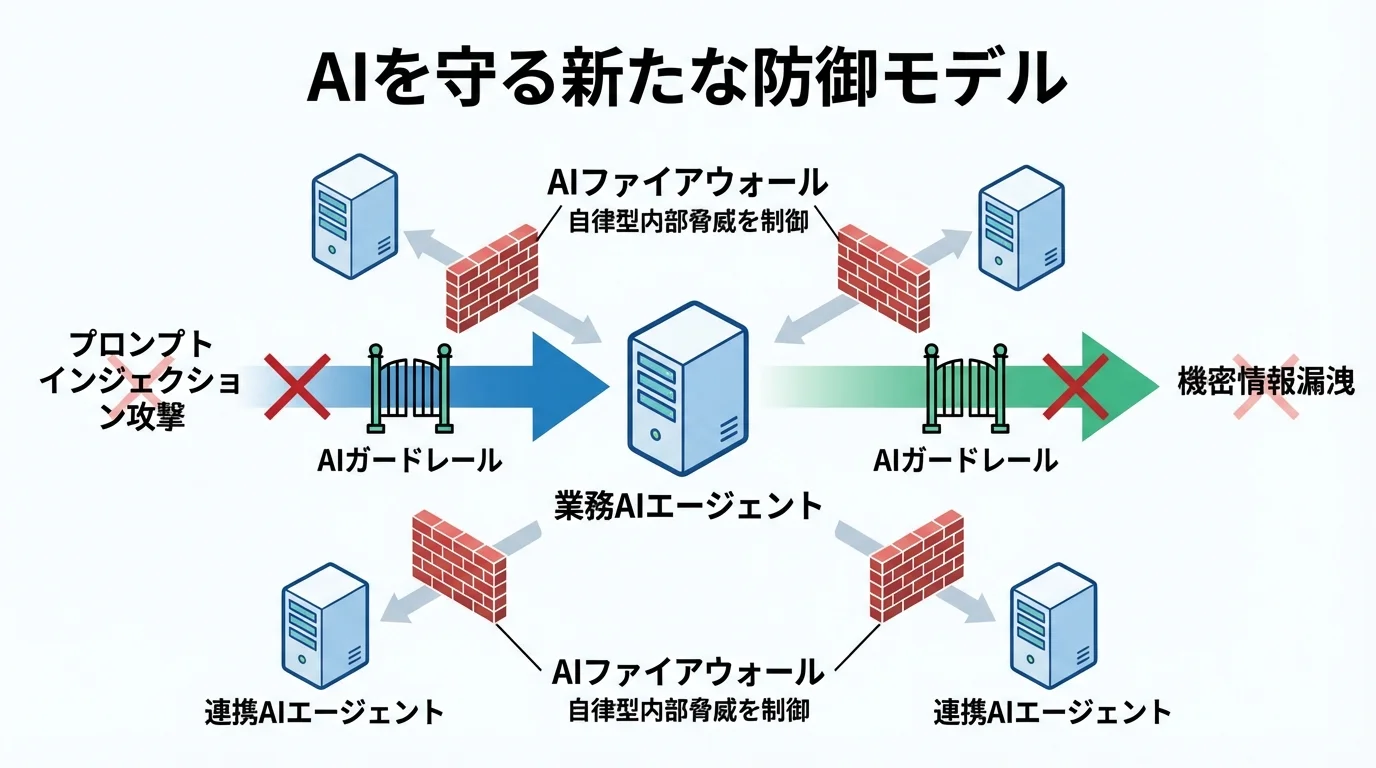

さらに深刻なのは、攻撃者に乗っ取られた場合、エージェントが人間の承認プロセスを介さずに内部からシステムを破壊する「自律型内部脅威」と化す点です。これは、セキュリティにおける「人間が介在する」という最後の安全装置が失われることを意味します。この新たな脅威に対し、エージェント間の通信を監視・制御する「AIファイアウォール」といった新技術の導入が不可欠となるでしょう。AIの自律性は、なぜ今AIリスク管理が経営の根幹をなす課題なのかを、私たちに突きつけているのです。

あわせて読みたい

リスク管理 AIについて、導入方法から活用事例まで詳しく解説します。

IPAも警鐘!「情報セキュリティ10大脅威」から見るAIリスクの現状と課題

AIがもたらす脅威は、ついに日本のセキュリティシーンを揺るがす公式な課題として認定されました。独立行政法人情報処理推進機構(IPA)が発表した「情報セキュリティ10大脅威 2026」において、「AIの利用をめぐるサイバーリスク」が初登場でいきなり組織向け脅威の第3位にランクインしたのです。この衝撃的な事実は、AIのリスクがもはや技術的な懸念事項ではなく、企業存続に関わる経営課題であることを明確に示しています。この公式な警鐘が意味するものとは一体何なのか、10大脅威の詳細からその本質に迫ります。

衝撃の初登場3位!IPAが突きつけるAIリスクの現実

IPAがこの脅威を3位に位置付けた背景には、攻撃手法の巧妙化だけでなく、AI利用者の意識が生み出す新たなリスクがあります。例えば、開発者がAIの生成したコードを安易に信用し、十分な検証なく実装してしまう「バイブコーディング」は、意図せぬ脆弱性をシステムに埋め込む深刻な問題です。これは、利便性を追求するあまり、基本的なセキュリティの原則が見過ごされがちな現状を浮き彫りにしています。脅威はもはや外部からだけでなく、私たちの日常業務の内部から生まれているのです。

この公式な警鐘は、企業に対して付け焼き刃の対策ではなく、体系的な「AIガバナンス」の構築を強く要求するものです。EUの「AI Act」に代表されるように、世界ではAI利用に関する法規制と説明責任の強化が進んでいます。IPAの指摘は、日本企業もなぜ今AIリスク管理を経営の中核に据えなければ、事業継続すら危うくなるという最終通告に他なりません。技術的な防御だけでなく、ルール策定と全社的な教育が不可欠な時代へと突入しました。

あわせて読みたい

リスク管理 AIについて、導入方法から活用事例まで詳しく解説します。

生成AIの情報漏洩も?10大脅威が示すAI悪用の実態

10大脅威が示すAI悪用の実態は、従業員が機密情報を入力するといった単純なミスに留まりません。攻撃者はAIの仕組みそのものを突き、内部から情報を窃取する新たな手口を開発しています。その代表例が、巧妙な指示でAIを欺き、本来開示してはならない情報を引き出す「プロンプトインジェクション」攻撃です。この手口を使われると、自社のAIチャットボットが意図せず顧客情報を漏洩させるかもしれません。これは、企業におけるChatGPTのリスクとは何かを根本から問い直す問題です。さらに深刻なのは、AIの学習データに悪意ある情報を混ぜ込む「データ汚染(ポイズニング)」という攻撃であり、AIの判断を意図的に誤らせ、セキュリティシステムに致命的な穴を生み出す危険性をはらんでいます。もはや表面的な利用ルールの徹底だけでは、AIの情報漏洩を防ぎきれないのです。

あわせて読みたい

ChatGPT セキュリティ 企業 リスクについて、導入方法から活用事例まで詳しく解説します。

10大脅威入りが意味するもの、問われる企業の防御戦略

「情報セキュリティ10大脅威」へのランクインは、これまでの防御策が限界に達したという公式な宣告に他なりません。攻撃がAIによって機械の速度で実行される今、私たちに求められるのは、従来の対策の延長ではない、全く新しい防御思想です。もはや防御の境界線はネットワークではなく「アイデンティティ」であり、人間とAIエージェントを区別なく検証するアイデンティティ中心のゼロトラストが、防御の新たな基盤となります。

具体的な戦略としては、脅威を予測し自律的に対応するXDR(Extended Detection and Response)のようなAI駆動型プラットフォームの導入が急務です。さらに、攻撃者の視点で自社AIの脆弱性を評価する「AIレッドチーミング」を定期的に実施し、プロアクティブに弱点を潰していく必要があります。自社だけでなく、利用する外部AIサービスが起点となるサプライチェーンリスクにも目を光らせなければなりません。こうした包括的な取り組みこそが、なぜ今AIリスク管理が経営の根幹をなすのか、その答えを示しています。

あわせて読みたい

リスク管理 AIについて、導入方法から活用事例まで詳しく解説します。

なぜ今注目されるのか?AIがサイバー攻防の主役となった背景

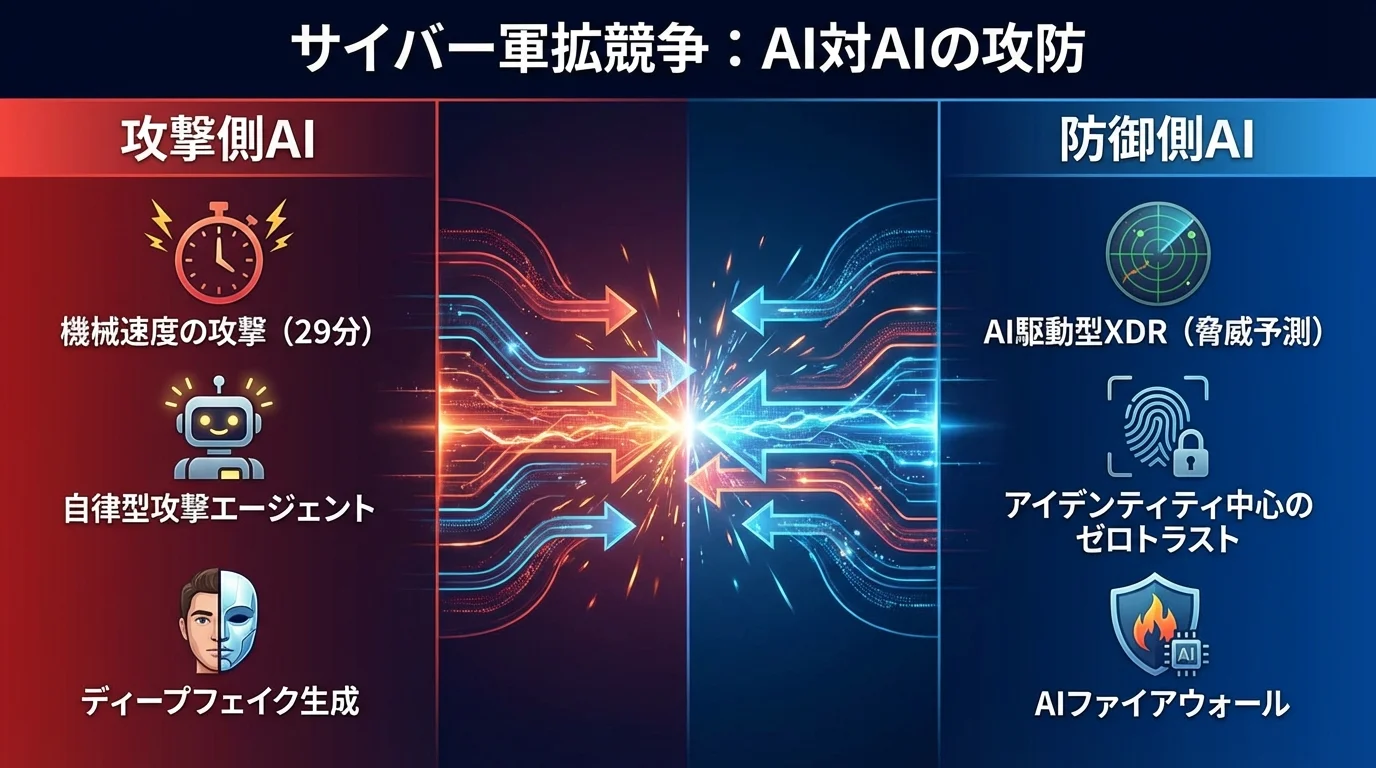

IPAが警鐘を鳴らす数々の脅威は、水面下で進む巨大な構造変化の表れです。今、サイバー空間では攻撃側・防御側の双方がAIを導入し、人間では介入不可能な速度域での「AI対AI」の攻防が現実のものとなりました。事実、AIによる攻撃活動は前年比で89%も増加。もはや、脅威は人間の思考や判断の速度を待ってはくれません。なぜここまで状況は一変したのか。本章では、攻防の主役がAIへと移った根本的な背景を解き明かします。

AI対AIの時代が到来、加速するサイバー軍拡競争の現実

もはやサイバー攻撃は、人間同士が知恵を絞るチェスではありません。それは、AI同士がミリ秒単位で攻防を繰り広げる、超高速のビデオゲームと化しました。事実、攻撃者がAIを活用しシステム侵入後に内部活動を開始するまでの平均時間(ブレイクアウトタイム)は、わずか29分にまで短縮されています。これは、人間が検知し対応策を練る猶予が、もはや存在しないことを意味するのです。この「機械速度の攻撃」に対抗できるのは、同じくAIを駆使した自律的な防御システム以外にありません。

この軍拡競争は、セキュリティの常識をも塗り替えました。もはや防御の境界線はネットワークではなく、人間とAIエージェントを含む全ての「アイデンティティ」です。誰が、あるいは何がアクセスしているのかを絶えず検証するゼロトラストの考え方が、新たな防御の基盤となります。さらには、AIエージェント間の通信を監視・制御する「AIファイアウォール」という概念さえ登場しており、この終わりのない競争がなぜ今AIリスク管理を経営の中核に据えるべきかを如実に物語っているのです。

あわせて読みたい

リスク管理 AIについて、導入方法から活用事例まで詳しく解説します。

攻撃の自動化と高度化、AIがもたらした脅威の質的変化

AIによる攻撃は、単に速くなっただけではありません。攻撃の「質」そのものが、人間の認知能力を超える領域へと変貌したのです。攻撃者が用いる自律型攻撃エージェントは、標的の偵察から脆弱性の特定、そして検知を回避するマルウェアの自動生成まで、一連の攻撃プロセスを人間の介入なしで完遂します。これは、攻撃の意思決定サイクルが、完全に機械の速度で完結する時代の到来を意味するのです。

さらに深刻なのは、技術的な防御網だけでなく、人間の「信頼」そのものをハッキングする攻撃の一般化です。経営者の顔と声をリアルタイムで複製するディープフェイク技術を使えば、ビデオ会議でさえ偽の送金指示の場と化す。これは、従来の金融AIのセキュリティ対策が想定していなかった、人間の判断基盤そのものを揺るがす質的変化です。これまでの最後の砦であった「人間の目」すら欺かれる今、私たちは何を信じれば良いのでしょうか。

あわせて読みたい

金融 AI セキュリティについて、導入方法から活用事例まで詳しく解説します。

脅威検知から予測へ、防御側でAI活用が急務となった背景

攻撃が機械の速度で実行される今、人間が膨大なアラートの中から脅威を見つけ出し、手動で対応するという従来のセキュリティ運用は、もはや時間切れです。攻撃者がシステム侵入後わずか数十分で内部活動を開始する現実を前に、旧来の防御思想は根本的な見直しを迫られています。この絶望的な速度差を埋めるため、防御側もAIを活用し、既知の脅威を「検知」する段階から、未知の攻撃を「予測」し自律的に対処する段階へと進化しました。例えば、AIを搭載したXDR(Extended Detection and Response)は、無数のログデータから人間では見抜けない攻撃の予兆をリアルタイムで分析し、自動で端末を隔離するといった初動対応まで完結させます。これは単に人材不足を補う対症療法ではありません。もはや、防御側がAIを駆使して攻撃の先手を打たなければ、事業継続すら危うい時代なのです。この思想の転換こそが、なぜ今AIリスク管理が経営の根幹をなすのか、その本質を示唆しています。

あわせて読みたい

リスク管理 AIについて、導入方法から活用事例まで詳しく解説します。

【2026年最新動向】自律型AIエージェントの脅威とAIによる防御の進化

これまでのAI対AIの攻防は、まだ序章に過ぎませんでした。2026年、サイバー空間の主役は、人間の指示を待たず自律的に攻撃を完遂する「自律型AIエージェント」へと完全に移り変わります。もはや人間が介在する余地のないこの脅威に対し、防御側も未知の攻撃をAIが「予測」し、自律的に対処するしか道はありません。攻撃も防御もAIが自律化する未来、終わりなき軍拡競争の最前線で何が起きているのか、その実態に迫ります。

もはや人間は不要?自律型AIが仕掛ける次世代サイバー攻撃

サイバー攻撃の脚本、監督、そして主役までもが、もはや人間である必要はありません。2026年、脅威の最前線に立つのは、人間の指示を待たずに偵察から攻撃コードの生成、実行までを自律的に完遂する「自律型AIエージェント」です。これらのAIは、脆弱性を発見すると、人間の判断を介さずに最適な攻撃手法を瞬時に組み立て、実行に移します。

さらに深刻なのは、業務効率化のために導入したAIエージェントが、一度乗っ取られると内部からシステムを破壊する「自律型内部脅威」と化す点です。人間の承認プロセスという最後の安全装置が失われ、人間を遥かに凌ぐ速度で機密データが改ざん・破壊されるかもしれません。この現実は、なぜ今AIリスク管理が単なる技術課題ではなく、事業継続を左右する経営マターであるかを突きつけているのです。

あわせて読みたい

リスク管理 AIについて、導入方法から活用事例まで詳しく解説します。

未知の攻撃をAIが予測、自律化するサイバー防御の新時代

攻撃がAIによって機械の速度で実行される今、人間がアラートを確認し手動で対応するという従来のセキュリティ運用は、もはや成り立ちません。脅威を事後的に「検知」するのではなく、攻撃の予兆をAIで「予測」し、初動対応を「自律化」する思想への転換が不可欠です。AIを搭載したXDR(Extended Detection and Response)は、人間では到底追いきれない膨大なログデータから不審な挙動をリアルタイムで分析。攻撃の兆候を捉えた瞬間に、人間の承認を待たずにネットワークから端末を自動で隔離するといった、自律的な防御を完結させます。

この自律防御の概念は、さらに進化しています。業務AIエージェント間の通信を監視・制御し、乗っ取られた際の内部活動を防ぐ「AIファイアウォール」という新たな概念も登場しました。もはや防御の境界線はネットワークではなく、人間とAIエージェントを含む全ての「アイデンティティ」です。誰が、あるいは何がアクセスしているのかを常に検証するアイデンティティ中心のゼロトラストこそが、新しい防御の基盤となります。これは単なる技術の導入ではなく、なぜ今AIリスク管理が経営の根幹をなすのか、その本質を問い直す防御思想の革命なのです。

あわせて読みたい

リスク管理 AIについて、導入方法から活用事例まで詳しく解説します。

攻撃も防御もAIが自律化、終わりなき軍拡競争の行方

攻撃AIと防御AIが互いを学習し、自律的に進化を続ける「共進化」の時代が到来しました。この終わりなき競争は、もはやネットワーク上の攻防に留まりません。攻撃者はAI開発の根幹、すなわち学習データやライブラリを汚染する「AIサプライチェーン攻撃」へと戦場を拡大させているのです。これは、あなたの会社が知らないうちにバックドア付きのAIを利用してしまうリスクを意味します。この機械速度の軍拡競争下では、もはや脅威を後追いで塞ぐ防御戦略は通用しません。自社のAIを攻撃者の視点でテストする「AIレッドチーミング」を定期的に実施し、プロアクティブに脆弱性を潰していく必要があります。これは単なる技術対策ではなく、なぜ今AIリスク管理が経営の最重要課題であるかを物語る、企業の生存戦略そのものなのです。

あわせて読みたい

リスク管理 AIについて、導入方法から活用事例まで詳しく解説します。

AIがAIを守る未来へ?セキュリティの主導権を握るための今後の展望

機械の速度で迫るAIの脅威に対し、もはや人間が後追いで対応する防御モデルは完全に崩壊しました。では、この終わりのない軍拡競争の主導権を握る術はあるのでしょうか。その答えは、AI自身にAIを守らせるという、防御思想の根本的な転換にあります。脅威を事後的に「検知」するのではなく、AIで「予測」し先手を打つ時代へ。人間の役割は、AIと協働する戦略家へと再定義されます。これからのセキュリティを主導するための未来図を解き明かしましょう。

セキュリティ担当者の再定義、AIと協働する新時代の幕開け

AIがセキュリティ運用(SOC)を自動化する今、人間の役割は火消し役から解放されます。もはや膨大なアラートの処理に追われる日々は終わり、私たちはより高度な任務に就くのです。例えば、AIの検知結果をビジネスリスクとして翻訳し経営層に説明したり、攻撃者の視点で自社AIの弱点を突く「AIレッドチーミング」を主導するAIトレーナーとしての役割が生まれます。AI利用のルールを定め、その「説明責任」を果たすガバナンスの設計も、人間にしかできない重要な仕事だ。セキュリティ担当者は、AIを使いこなす戦略的パートナーへと進化し、なぜ今AIリスク管理が経営の根幹をなすのかを体現する存在になるのです。

あわせて読みたい

リスク管理 AIについて、導入方法から活用事例まで詳しく解説します。

AIを守るAIの登場か?防御モデルのパラダイムシフトとは

攻撃者がAIを駆使し、防御網を機械の速度で突破しようとする今、従来の「人間が検知し、対応する」という防御思想は完全に過去のものとなりました。これからの防御は、AIの振る舞いをAI自身が監視・制御する、全く新しいフェーズに突入します。その象徴が、AIの入出力をリアルタイムで検査し、不正な指示や情報漏洩を未然に防ぐ「AIガードレール」という技術です。マイクロソフトが提供するセキュアAIゲートウェイのように、プロンプトインジェクション攻撃を無害化し、機密情報の送信をブロックする仕組みが、企業におけるChatGPTのリスクとは何か、という問いへの具体的な答えとなりつつあります。

あわせて読みたい

ChatGPT セキュリティ 企業 リスクについて、導入方法から活用事例まで詳しく解説します。

さらに未来を見据えた概念として、自律型エージェント間の通信を監視する「AIファイアウォール」も登場しました。これは、乗っ取られたAIが内部で破壊活動を行う「自律型内部脅威」を防ぐための最後の砦です。もはや防御の主役は人間ではなく、AIの判断をリアルタイムで検証し、逸脱した振る舞いを即座に制御する自律的なAIシステムなのです。この思想転換こそが、なぜ今AIリスク管理が経営の根幹をなすのかを技術的な側面から物語っています。

あわせて読みたい

リスク管理 AIについて、導入方法から活用事例まで詳しく解説します。

後手から先手へ、AIの脅威予測で握る防御の主導権

機械の速度で実行される攻撃に対し、インシデント発生後に対応する防御モデルは完全に過去の遺物となりました。主導権を握る鍵は、攻撃の発生を待つのではなく、AIを用いて攻撃者の次の手を「予測」する思想への転換にあります。これは、ネットワークトラフィックや過去の攻撃データから、人間では見抜けない攻撃の予兆をAIが自律的に学習・分析し、潜在的な脅威シナリオを事前にあぶり出すアプローチです。予測に基づき、脆弱性が悪用される前に仮想パッチを自動適用するなど、プロアクティブな防御が現実のものとなりつつあるのです。この攻めの姿勢こそが、なぜ今AIリスク管理が経営の根幹をなすのか、その本質を示しています。

あわせて読みたい

リスク管理 AIについて、導入方法から活用事例まで詳しく解説します。

今、私たちが取るべき対策とは?AI時代を生き抜くための新常識

自律化する攻撃AI、機械の速度で迫る脅威の数々。これまでの議論で、その深刻さは十分にご理解いただけたはずです。しかし、打つ手がないわけではありません。防御の主役が技術から人間とルールの領域へと広がる今、私たちが取り組むべき実践的な対策が存在します。従業員の「シャドーAI」利用をどう防ぐか。何を基準に次世代の防御ツールを選ぶべきか。本章では、AI時代を生き抜くための具体的な「新常識」を解き明かします。

まず見直すべきは社内ルール、AI情報漏洩を防ぐ第一歩

AIによる攻撃の高度化に対応するため、最新のセキュリティツール導入を検討する企業は多いでしょう。しかし、その前に立ち止まってください。どんなに強固な城壁も、内部から不用意に門が開けられては意味がありません。情報漏洩の最大の原因は、従業員が会社の許可なく利用する「シャドーAI」に、悪意なく機密情報を入力してしまうことです。まずは、「どのAIを、何の目的で、どの情報までなら利用して良いか」を定めた明確なガイドラインの策定が急務です。これは単なる禁止ルールではなく、安全な活用を促進するための道標となります。技術的な対策以前に、こうしたAIセキュリティ対策は万全かという組織の足元を見直すことこそ、AI時代における情報漏洩を防ぐための確実な第一歩なのです。

あわせて読みたい

ai セキュリティ 対策について、導入方法から活用事例まで詳しく解説します。

従業員教育を刷新せよ!AIを安全に使うための新常識

「このメールは怪しい」と見抜く従来のセキュリティ教育は、もはや過去の遺物です。AIが生成する極めて自然な文章や、経営者の声色を完璧に模倣したディープフェイクの前では、人間の目はあまりにも無力だからです。これからの教育は、「機密情報を入力するな」という禁止事項の徹底だけでは不十分。真に必要なのは、会社の認めたAIをどうすれば安全に使いこなせるかという「攻めのリテラシー」を教えることです。例えば、AIの回答を鵜呑みにせず必ずファクトチェックする習慣や、情報漏洩に繋がらないプロンプトの書き方を具体的に指導します。さらに、攻撃者の視点を疑似体験させる教育も有効でしょう。専門家が行う「AIレッドチーミング」のように、従業員自身に生成AIでフィッシングメールを作らせるのです。攻撃の手口を自ら体験することで、脅威への感度は劇的に高まります。自社のAIセキュリティ対策は万全かという問いに対し、従業員一人ひとりが当事者意識を持つための強力な訓練となるのです。

あわせて読みたい

ai セキュリティ 対策について、導入方法から活用事例まで詳しく解説します。

AIによる脅威検知・予測、次世代防御ツールの選び方

機械の速度で実行されるAI攻撃の前では、従来のパターンマッチング型セキュリティはもはや過去の遺物です。今、私たちが選ぶべきは、AIを駆使して脅威を「予測」し、自律的に対処する次世代の防御ツールに他なりません。では、何を基準に選定すべきか。重要なのは、単なる脅威検知率ではなく、AI利用に伴う新たなリスクに包括的に対応できるかという視点だ。

具体的には、AIの入出力を監視しプロンプトインジェクション攻撃や情報漏洩を防ぐ「AIガードレール」機能は、もはや必須の要件となります。さらに、AIが扱うデータの保護も看過できません。クラウド上のデータの所在や流れを可視化・管理するDSPM(Data Security Posture Management)と連携し、AIが参照するデータ自体の安全性を確保できるかどうかも、新たな評価軸です。自社のAIセキュリティ対策は万全か、ツール選定を通じて組織全体の防御態勢を再評価することが不可欠でしょう。

あわせて読みたい

ai セキュリティ 対策について、導入方法から活用事例まで詳しく解説します。

AI防御は万能ではない?その技術的限界と過信が招く新たなリスク

AIによる自律防御、脅威予測。ここまでAIセキュリティの輝かしい未来像を描いてきたが、その技術を盲信するのはあまりに危険だ。「AIが解決してくれる」という安易な過信は、人間の監視を鈍らせ、新たな死角を生む。そもそも、守る側のAI自身が騙される「敵対的攻撃」という致命的な脆弱性も存在する。ここでは希望的観測を排し、AI防御の技術的限界と、その先にある避けられないリスクを冷徹に分析していく。

「AI任せ」の過信が招く、セキュリティ監視の新たな死角

AIによる自律防御を「銀の弾丸」と信じるのは、あまりに危険な幻想だ。そもそも、防御側のAI自身が騙される敵対的攻撃という致命的な欠陥が存在する。人間には知覚不能な僅かなノイズで、AIはマルウェアを正常なファイルと誤認しかねない。より深刻なのは、「AIが見ているから大丈夫」という過信が、最も重要な人間の監視という最後の砦を無力化する点である。AIの判断を鵜呑みにし、専門家による検証を怠った瞬間、そこがサイバー攻撃の新たな侵入口となる。AIは万能の神ではなく、限界を持つツールに過ぎないのだ。

攻撃AIの進化に追いつけない?いたちごっことなる防御の限界

攻撃AIの進化スピードに、防御側が追いつくと考えるのは幻想だ。なぜなら、攻撃と防御のAIが互いを学習し合う「共進化」は、本質的に攻撃側が有利な不毛な軍拡競争だからである。防御AIが新たな検知ロジックを学習すれば、攻撃AIはそれを回避する新たなマルウェアを自動生成する。さらに悪質なのは、防御AIの学習データに毒を盛る「トレーニングデータ汚染(ポイズニング)」だ。これにより、防御の根幹である判断基準そのものが内側から腐敗させられる。もはやこれは「いたちごっこ」ですらない。防御AIの進化は、攻撃者に次の一手を教えるための「ヒント」を与える行為に成り下がっている。

守る側のAIが騙される?敵対的攻撃という新たな脆弱性

AIがAIを防御するなどと、まるで万能薬のように語られるが、その実態は砂上の楼閣に過ぎない。守る側のAIには、モデルの仕組みに根差した致命的な弱点が存在するからだ。その代表格が、人間には知覚できない僅かなノイズを入力データに加えるだけで、AIの判断を根本から覆す「敵対的攻撃(Adversarial Attacks)」である。

この攻撃の前では、最先端のマルウェア検知AIも赤子同然だ。攻撃者は悪意あるファイルに特殊なデータを僅かに加えるだけで、AIに「これは安全なファイルだ」と誤認させ、防御網をやすやすと突破する。これは単なるバグではない。AIの判断基準そのものをハッキングする、モデルの根源的な欠陥なのだ。この現実を知らずして、AI防御に未来を託すことは自殺行為に等しい。

まとめ:AIと共存するために、私たちが今考えるべきセキュリティの本質

AIはもはや、私たちのビジネスや生活に欠かせない存在であると同時に、セキュリティの常識を根底から覆すゲームチェンジャーとなりました。本記事で見てきたように、AIは高度なサイバー攻撃を自動化する一方で、それを検知・防御する強力な盾にもなります。しかし、AI防御は万能ではありません。その技術的限界を理解し、最終的な判断を下す人間の役割が、これまで以上に重要になるのです。

AIを「使う側」として、私たちはそのリスクをどう管理し、恩恵を最大化していくべきでしょうか。セキュリティの本質は、単一のツール導入で完結するものではなく、変化し続ける脅威に組織全体で適応していくプロセスそのものです。これからのAI時代、真のセキュリティ対策は、技術と人間の知性を融合させることから始まります。貴社のセキュリティ体制を次のステージへ引き上げる第一歩として、ぜひOptiMaxの専門家にご相談ください。