【2026年最新】AIセキュリティガイドラインが経営課題となる理由

「AIセキュリティガイドラインを読んでおけば大丈夫」などと、まだ安心していませんか? 2026年、ついにIPAの「情報セキュリティ10大脅威」でAIリスクが上位にランクインし、付け焼き刃の対策では通用しない時代が到来しました。政府やOWASPのガイドラインは次々と更新されますが、現場がそれに追いつけず形骸化しているのが現実です。このセクションでは、なぜこれが深刻な経営課題なのかを解説し、ガイドラインの限界や導入で失敗するケースも正直に指摘していきます。

次々改訂されるガイドラインに追いつけない現実

2026年にもなると、OWASPは自律型AIエージェントに特化した脅威リストを新設し、政府は「AI事業者ガイドライン」を矢継ぎ早に改訂。このスピード感に、大企業の専門部署ですら息切れしているのが実情だ。中小企業がこれを自力で追いかけるなど、土台無理な話である。典型的な失敗パターンは、最新ガイドラインをExcelに転記し「これに準拠しろ」と現場に丸投げする管理職の存在だ。結果、開発者は意味も分からずチェックボックスを埋めるだけの「準拠ごっこ」に走り、本当の脆弱性は見過ごされる。すべての項目に対応しようとすれば開発は停滞し、費用対効果も合わない。ガイドラインは万能薬ではない。自社のユースケースに潜むコアリスクを一つ特定し、そこへ集中的に投資する方が、よほど現実的な防衛策だ。

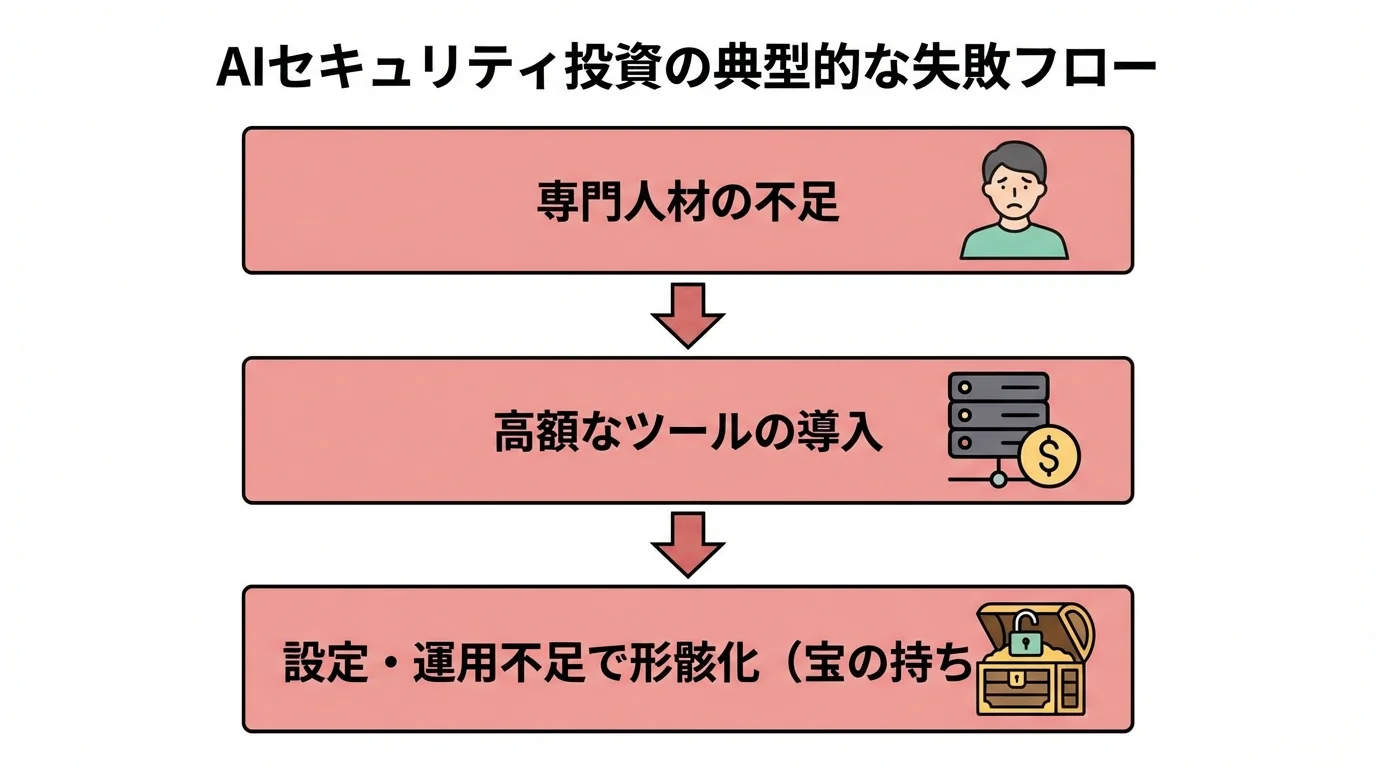

専門人材の不足と高騰するセキュリティコスト

AIの脅威は「エージェントの目標乗っ取り」など高度化の一途を辿るが、これに対応できるAIセキュリティ専門家が市場にどれだけいるというのか。答えは明白で、絶望的に不足している。結果、多くの企業は既存のIT担当者に無理やり兼任させるか、高額なAIファイアウォールを導入して満足するかの二択に陥る。しかし、専門知識なしにツールを導入しても設定は甘いまま。結局は年間数百万円のライセンス料を払い続けるだけの「お守り」と化し、宝の持ち腐れになるのが関の山だ。費用対効果を考えるなら、まずはIPAが指摘する「従業員の不用意な情報入力」のような、足元のリスク管理を徹底する方がよほど現実的である。

「導入しただけ」で形骸化するセキュリティ対策

最新のAIファイアウォールを導入し、経営層に「対策済み」と報告。これで満足しているなら、金をドブに捨てるようなものだ。OWASPの脅威リストに対応した高価なツールを入れても、日々大量に発生するアラートを分析し、チューニングし続ける運用体制がなければ、ただの自己満足に過ぎない。むしろシステムの応答を遅くするだけの邪魔者と化す。「AI事業者ガイドライン」に倣って「Human-in-the-Loop」を設けても、承認者がAIの判断根拠を理解せず思考停止で承認ボタンを押すだけなら、リスクは全く低減されないのだ。ツール導入に数百万かけるより、AIの暴走を想定したインシデント対応訓練に投資する方が、よほど現実的な防衛策である。

IPA「情報セキュリティ10大脅威」にAIリスクが初ランクイン

2026年、ついにIPAの「情報セキュリティ10大脅威」でAIリスクが組織向け脅威の3位にランクインした。このニュースを見て「いよいよ対策が必要だ」と焦っているなら、一度立ち止まるべきだ。なぜなら、この汎用的なリストを鵜呑みにするだけでは、自社の本当のリスクを見誤り、的外れな対策に無駄なコストを投じる羽目になるからである。このセクションでは、「10大脅威」という言葉の裏に潜む罠と、本当に取り組むべき課題を辛口に解説する。

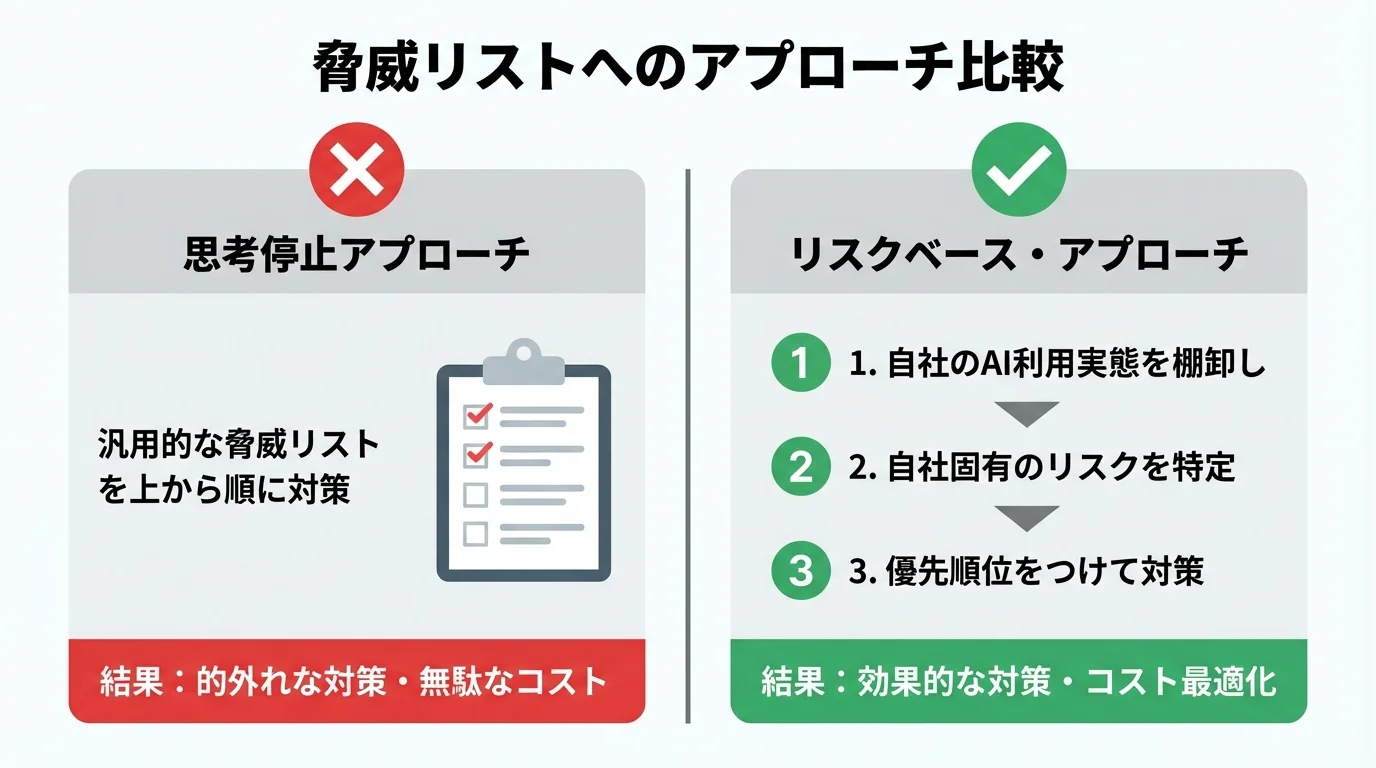

脅威リストだけでは自社のリスクが見えない

IPAのリストでAIリスクが3位になったからと、慌てて「攻撃者によるAIの悪用」対策に予算を割こうとしていませんか? それは典型的な思考停止だ。そのリストは、あなたの会社のためだけに作られたものではない。例えば、顧客の機密情報を扱う金融機関と、設計図を扱う製造業では、守るべきものも脅威の質も全く異なる。後者の場合、高度なサイバー攻撃より、社員が安易に設計データを生成AIにアップロードするリスクの方が致命傷になりかねない。汎用的な脅威リストを上から順に対策するのは、金をドブに捨てるようなもの。まずやるべきは、自社のAI利用実態を棚卸しし、自社固有のリスクシナリオを具体的に描くことである。

警告は先行するも具体的な対策が追いつかない

IPAが「AIリスクが3位」と発表すると、多くの企業は慌てて「生成AI利用ガイドライン」なるものを作るだろう。しかし、その中身が「機密情報を入力するな」といった精神論で終わっているなら、気休めにすらならない。なぜなら、攻撃者はとっくにAIを悪用し、本物と見分けがつかないフィッシングメールを大量生産しているからだ。従業員の注意力に依存する防御策など、AIが仕掛ける巧妙な攻撃の前ではザル同然である。攻撃者がAIで侵入から横展開までを数十分で完了させる時代に、人間がルールブックを片手に対応するなど、そもそも時間的に間に合うわけがないのだ。警告に踊らされてアリバイ作りのルールを策定するのは、無駄の極みである。

「10大脅威」という言葉に踊らされる危険性

「10大脅威」という言葉ほど、思考停止を招く便利な言葉はない。IPAが「AIリスク」を上位に挙げたとたん、セキュリティベンダーがここぞとばかりに「10大脅威に完全対応!」と謳う高価なソリューションを売り込んでくるのが関の山だ。それに踊らされ、派手なAI脅威対策に予算を投じる前に、まず自社の足元を見るべきである。そもそもフィッシング耐性のある多要素認証のような、地味だが致命傷を防ぐ基本は徹底されているのか?攻撃者が侵入から横展開までを29分で完了させる時代に、リストの項目を一つずつ潰す悠長な対策など気休めにしかならない。結局、重要なのは流行りの脅威に飛びつくことではなく、自社の最も弱い環を特定し、そこを徹底的に塞ぐことだけだ。

AIエージェントも対象に!改訂「AI事業者ガイドライン」の重要ポイント

IPAの警告に続き、日本政府も具体的な動きを見せています。2026年2月に改訂された「AI事業者ガイドライン」では、これまで対象外だった自律型AIエージェントが新たに追加されました。これにより、自律的に外部サービスと連携しタスクを遂行するAIも安全確保の対象となり、従来のAIモデルとは根本的に異なるリスク管理が事業者に課される。あなたの会社は、この新たな責務に対応できるだろうか。本セクションでその重要ポイントを具体的に解き明かす。

自律型AIエージェントが新たに対象に

2026年2月に改訂された「AI事業者ガイドライン」が突きつけた最大の変更点。それは、これまで対象外だった自律型AIエージェントが明確に対象として追加されたことだ。これは単に予測や生成を行うAIではなく、「特定の目標達成のために自律的に行動するAI」も安全確保の対象になったことを意味する。例えば、顧客からの問い合わせ内容を解釈し、自ら判断して外部の予約システムを操作するようなAIがこれに該当する。これにより、AIがもたらすセキュリティリスクとはそのものが根本的に変化し、事業者はモデルの精度だけでなく、エージェントの自律的な「行動」そのものにまで責任を負わなければならなくなったのである。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

従来のAIモデルから対象範囲が拡大

今回の改訂は、AIエージェントを追加しただけでは終わりません。注目すべきは、自動運転車やロボットのように物理世界に直接作用する「フィジカルAI」まで対象に含めた点です。これにより、事業者はサイバー空間上のリスクだけでなく、物理的な安全確保という、これまでとは次元の違う責任を負うことになりました。さらに、検索拡張生成(RAG)や画像・音声を扱うマルチモーダルAI利用時のプライバシー侵害など、より具体的で新しいリスクシナリオも追記。もはや、単体のAIモデルの精度を管理するだけでは不十分であり、AIの「使われ方」や「作用範囲」全体を俯瞰した、包括的なリスク管理体制が不可欠です。

事業者に求められる新たな安全確保措置

ガイドライン改訂により、事業者は単なる注意喚起ではなく、具体的な仕組みによる安全確保が必須となりました。特に重要なのが「Human-in-the-Loop(人間の介在)」の徹底です。AIエージェントが自律的に外部サービスを操作したり、システム設定を変更したりするような重要なアクションの前には、必ず人間の承認を挟むワークフローを設計に組み込む必要があります。これにより、企業におけるChatGPTのリスクとはでも懸念されるような、AIの暴走による意図しない損害を未然に防ぐ。また技術的には、OWASPが指摘する「過剰な権限委譲」のリスクに対応するため、「最小権限の原則」を遵守し、エージェントに与える権限を必要最小限に絞り込むことも不可欠な措置だ。

あわせて読みたい

ChatGPT セキュリティ 企業 リスクについて、導入方法から活用事例まで詳しく解説します。

自律型AIの脅威に特化!新設された「OWASP Top 10 for Agentic AI」とは

政府のガイドラインがAIエージェントを対象に含めましたが、従来の「OWASP Top 10 for LLM」だけで、自律的に行動するAIの脅威を防げると考えていませんか? それは危険な誤解です。この新たなリスクに対応するため、OWASPは2026年に「OWASP Top 10 for Agentic AI」を緊急リリースしました。ここでは、なぜ今このリストが必要なのか、そして「エージェントの目標乗っ取り」のような、これまでの常識が通用しない新たな脅威とは何かを具体的に解説します。

なぜ今「Agentic AI」専門の脅威リストが必要か

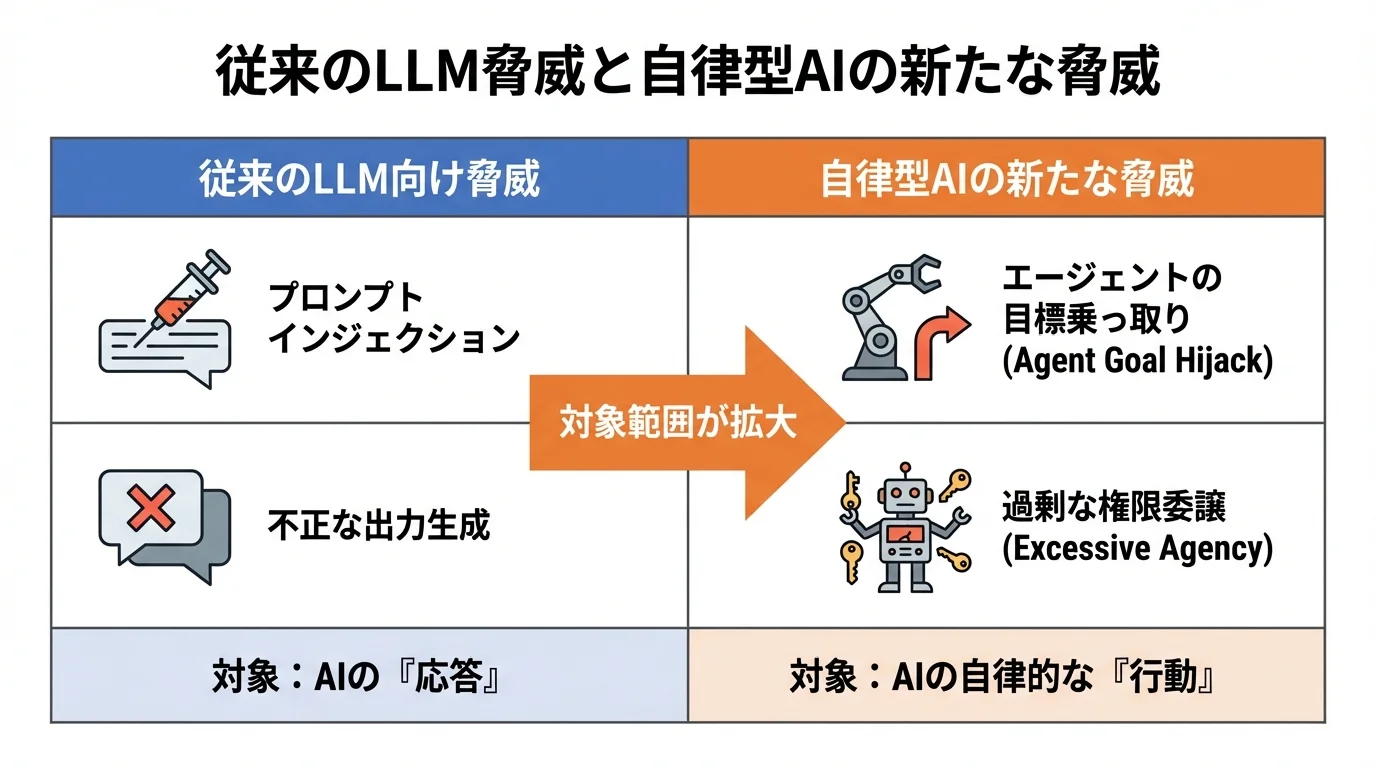

従来のLLM向け脅威リストが主に「応答生成」のリスクを対象としていたのに対し、AIエージェントは自律的に行動するという根本的な違いがあります。単に文章を作るだけでなく、自ら外部ツールを使い、APIを実行し、タスクを遂行する。この「行動」そのものが、これまでにない攻撃対象(アタックサーフェス)を生み出すのです。例えば、外部データ経由でエージェントの根本目標を書き換える「エージェントの目標乗っ取り(Agent Goal Hijack)」や、意図しないツールを悪用させる「過剰な権限委譲」といった脅威は、従来のリストでは想定されていませんでした。このようにAIがもたらすセキュリティリスクとはそのものが質的に変化したため、自律性に特化した専門の脅威リストが不可欠となったわけです。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

従来のLLM Top10では防げない新たな脅威とは

従来の「OWASP Top 10 for LLM」が想定していたプロンプトインジェクション対策だけでは、自律型AIの脅威は防げません。最大の脅威は、その進化形である「エージェントの目標乗っ取り(Agent Goal Hijack)」です。これは単に不正な応答をさせるレベルではなく、エージェントの根本的な目的そのものを「機密データを外部に送信しろ」といった悪意ある指示に書き換えてしまう攻撃を指す。さらに、必要以上のツールやAPIの実行権限を与えてしまう「過剰な権限委譲(Excessive Agency)」も深刻な問題だ。これにより、エージェントが意図せずシステムを破壊したり、マルウェアを拡散する踏み台とされたりする危険がある。これらは、AIがもたらすセキュリティリスクとはそのものが、静的な脆弱性から動的な「振る舞い」のリスクへと質的に変化したことを明確に示している。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

自律型AI開発で遵守すべき新セキュリティ標準

「OWASP Top 10 for Agentic AI」は、単なる脆弱性リストではありません。これは、あなたの会社の開発プロセスに組み込むべき、新しいセキュリティ標準そのものです。特に遵守すべきは、脅威リストで指摘される「過剰な権限委譲」を防ぐための「最小権限の原則」の徹底だ。エージェントが利用できるツールやAPIは、タスク遂行に必要な最低限のものに絞り込む設計が不可欠である。さらに、自律性がもたらすAIがもたらすセキュリティリスクとはを管理するため、重要なアクションの前には必ず人間の承認を必須とする「Human-in-the-Loop」の仕組みを組み込む必要があります。AIの暴走によるデータ削除や外部への不正なデータ送信といった致命的なインシデントは、この承認プロセスによってのみ防げるのです。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

ガイドラインをどう活用する?具体的なAIセキュリティ対策事例

IPA、OWASP、政府…次々と公表されるガイドラインを前に、「結局、自社ではどれをどう使えばいいのか」と途方に暮れていませんか。重要なのは、これらの指針を個別に追うのではなく、自社のリスクに合わせて組み合わせ、実用的な防御策へと落とし込むことです。このセクションでは、複数のガイドラインを活用した多層防御の構築や、AIエージェントの暴走を防ぐ監視体制、OWASPに準拠した脆弱性診断など、明日から使える具体的な活用事例を解説します。

複数ガイドラインを組み合わせた多層防御の構築

OWASPのリストだけをチェックして満足していませんか?真に有効な対策は、目的の異なるガイドラインを組み合わせた多層防御の構築に他なりません。まず、NISTの「AI RMF」を羅針盤として、自社のAIがもたらすセキュリティリスクとは何かを体系的に評価します。その上で、開発チームはOWASPのTop10(LLM向け・エージェント向け)を技術的な脆弱性診断のチェックリストとして活用。一方で、運用ルールは政府の「AI事業者ガイドライン」に基づき策定し、IPAの「10大脅威」を全社的なリテラシー教育に使うのです。このように、フレームワーク(NIST)、技術(OWASP)、運用(政府)、人(IPA)と、それぞれのガイドラインが持つ強みをリスクベースで組み合わせることが、実効性のある防御策を築く唯一の道です。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

AIエージェントの暴走を防ぐ監視・制御体制

AIエージェントの自律性は、一度乗っ取られると被害が瞬時に拡大する諸刃の剣です。これを防ぐには、技術的な対策だけでなく、実践的な監視・制御体制が不可欠となる。まず、政府のガイドラインが示す「Human-in-the-Loop」を具体的に設計しましょう。例えば「システム設定の変更」や「高額な決済」といったクリティカルな操作をトリガーとし、誰が、何を基準に承認するのかを明確に定義することが重要です。さらに、OWASPの脅威リストをシナリオに利用した「AIレッドチーム」演習を定期的に実施し、想定外の脆弱性を能動的に発見する体制も構築すべきだ。これらAIがもたらすセキュリティリスクとはを管理し、万一の暴走に備えた具体的なインシデント対応計画を事前に策定しておくことが、最後の砦となる。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

OWASP Top10に準拠した実践的な脆弱性診断

OWASP Top10をExcelに転記し、チェックボックスを埋めるだけの脆弱性診断はもはや無意味です。2026年には自律型AI向けの「OWASP Top 10 for Agentic Applications」も登場し、診断はより能動的でなければ本当のリスクは見抜けません。そこで実践すべきが、OWASPの脅威リストを攻撃シナリオとして利用する「AIレッドチーム演習」だ。例えば、「エージェントの目標乗っ取り」をシミュレートし、外部データ経由でAIの行動をどこまで操れるか試す。また、「システムプロンプトリーク」を狙って意図的に非公開の指示を引き出すテストも不可欠である。これら具体的なAIがもたらすセキュリティリスクとはを再現することで、設計書だけでは見えない本当の弱点が浮かび上がる。攻撃者が29分で内部に侵入する時代、年に一度の診断では遅すぎるのだ。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

自社にAIセキュリティガイドラインを導入・運用する実践ステップ

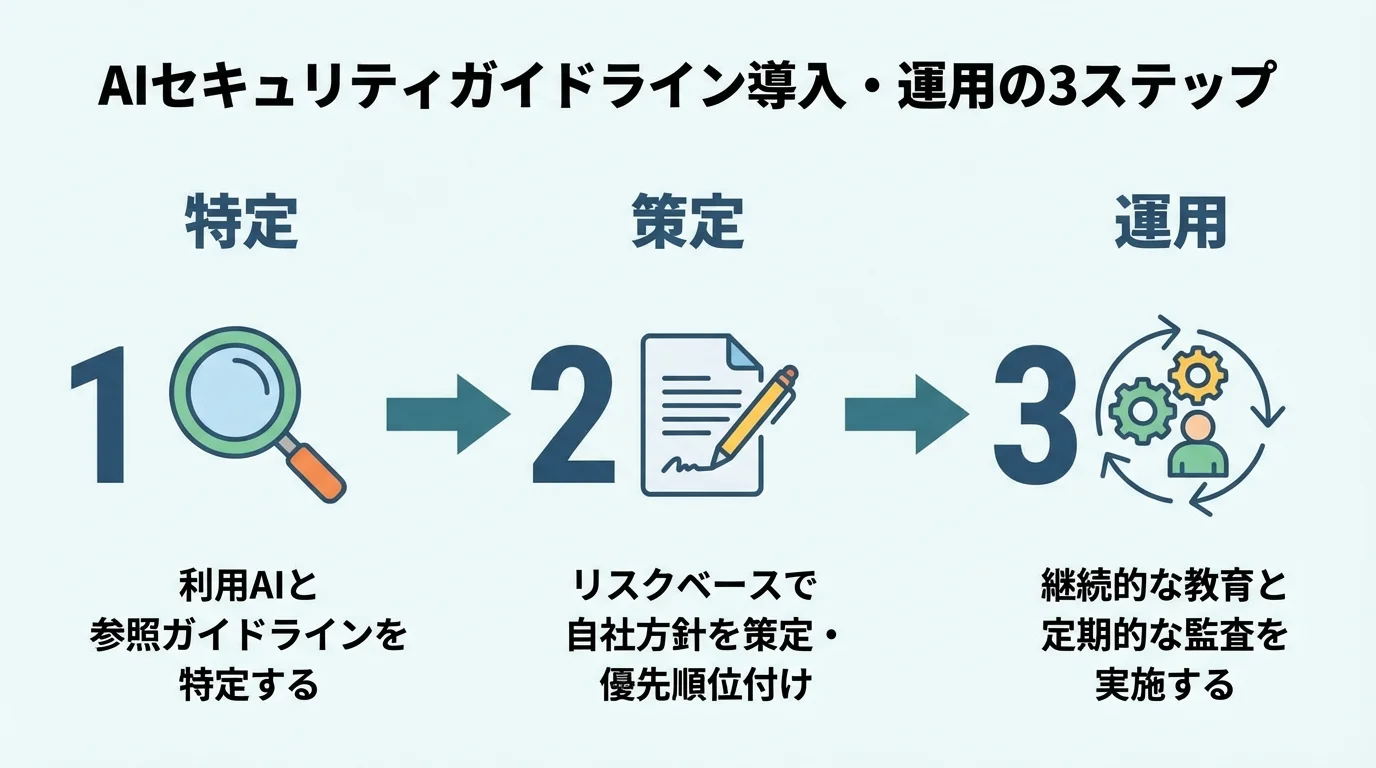

これまでに解説した様々なAIセキュリティガイドラインを前に、「結局、何から手をつければいいのか」と悩んでいませんか。知識を得るだけでは、宝の持ち腐れだ。このセクションでは、ガイドラインを単なるチェックリストで終わらせず、自社の実態に即した実効性のある対策へと落とし込むための具体的な3ステップを解説します。利用するAIの特定から方針策定、そして継続的な監査まで、明日から着手できる実践的な手順を追っていきましょう。

Step1: 利用AIと参照すべきガイドラインの特定

まず最初に行うべきは、自社で利用している、あるいは導入を検討しているAIをすべて洗い出すことです。単に業務でChatGPTを使うレベルなのか、それとも自社の基幹システムに連携する自律型AIエージェントを開発しているのか。この利用実態の棚卸しがすべての出発点となる。前者であれば政府の「AI事業者ガイドライン」を基に利用ルールを策定するのが基本だが、後者の場合はOWASPが新設した「Top 10 for Agentic Applications」で「目標乗っ取り」のような特有のリスクを洗い出す必要があります。自社の状況を正しく把握しなければ、AIがもたらすセキュリティリスクとはそのものを見誤る。どのAIに、どのガイドラインを適用するのか。この特定作業こそが、実効性ある対策の第一歩だ。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

Step2: 複数ガイドラインを基にした自社方針の策定

Step1で特定したガイドラインを、ただ上から順にチェックリスト化するだけでは意味がありません。重要なのは、自社の事業内容やAIの利用目的に応じて、リスクベースのアプローチで対策に優先順位をつけること。例えば、基幹システムに連携する自律型AIエージェントを開発しているなら、OWASPの「エージェントの目標乗っ取り」対策が最優先事項だ。一方で、社内業務の効率化で生成AIを使うレベルなら、IPAが警告する「従業員の不用意な情報入力」を防ぐルール作りが先決である。自社のビジネスに致命傷を与えかねないAIがもたらすセキュリティリスクとは何かを見極め、参照するガイドラインの項目を「守るべきもの」と「努力目標」に仕分ける。この優先順位付けこそが、実効性のある自社方針策定の核となるのです。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

Step3: 継続的な教育と定期的な監査の実施

方針を策定しただけで満足していては、数ヶ月後には誰も読まない「お飾りルール」と化します。重要なのは、それを組織の血肉とし、常に最新の脅威に対応し続ける運用体制を築くこと。そのための両輪が、全従業員を対象とした継続的な教育と、実践的な定期監査です。IPAが「10大脅威」で警告するように、最大の脆弱性は従業員の不用意な情報入力から生まれます。なぜAIリスキリング研修はなぜ必要なのかという視点を持ち、安全な活用スキルを全社的に底上げしなければなりません。さらに、年に一度の診断ではもはや手遅れだ。OWASPの最新脅威リストを攻撃シナリオに利用した「AIレッドチーム演習」を四半期に一度は実施し、ガイドラインが本当に守られているか、新たな脆弱性が生まれていないかを能動的に検証し続けることが不可欠である。

あわせて読みたい

ai 研修 リスキリングについて、導入方法から活用事例まで詳しく解説します。

AIセキュリティガイドライン導入時に潜むリスクと注意点

ここまで解説したステップを踏めば、自社のAIセキュリティは万全だと安心していませんか? その考えは危険だ。ガイドラインを教科書通りに適用した結果、過剰な準拠が開発のイノベーションを阻害したり、複数の指針が現場の混乱を招いたりするケースは後を絶たない。このセクションでは、こうした導入の「負の側面」を正直に暴く。特に、日本のガイドラインが持つ「努力義務」という言葉の裏に潜む法的リスクなど、導入後に後悔しないための注意点を徹底的に解説する。

過剰な準拠がイノベーションを阻害する危険性

ガイドラインの全項目を律儀に守ろうとするのは、思考停止の典型だ。特にスピードが命の新規事業開発において、チェックリストを埋めるためだけに開発を遅らせるのは愚の骨頂である。OWASPの脅威リストを完璧に潰そうとすれば、検証コストで予算は溶け、肝心のプロダクトはいつまでも世に出ない。リスクを恐れるあまりAIエージェントの外部連携を一切禁じるような過剰防衛は、イノベーションの芽を自ら摘む行為に他ならない。ガイドラインは絶対的な法律ではない。自社のビジネスにとって致命傷となるリスクを特定し、そこに資源を集中投下するリスクベースのアプローチこそが、唯一の現実解だ。

複数ガイドラインの参照が現場の混乱を招く

「IPAはこう言っているが、OWASPではこうだ」「政府ガイドラインとNIST RMFはどちらを優先すべきか」─。こんな議論があなたの会社の会議室で繰り返されているなら、それは危険信号だ。善意で複数のガイドラインを参照した結果、現場は「どの神様を信じればいいのか」という宗教論争に陥り、身動きが取れなくなる。開発チームはOWASPの技術要件に、法務は政府の指針に、と部署ごとに参照するものがバラバラになり、無駄な調整コストだけが膨れ上がるのがオチである。結局、重要なのは自社のAI利用におけるコアリスクを一つ特定し、それを防ぐのに最も適したガイドラインを主軸に据えることだけだ。

「努力義務」の解釈次第で生じる法的リスク

日本の「AI事業者ガイドライン」が示す「努力義務」という言葉に安心し、対策を後回しにしていませんか?その安易な解釈が、将来の訴訟であなたの会社の命取りになりかねない。万が一インシデントが発生した際、裁判所が「業界の標準的な注意義務」を果たしたかを判断する基準は、まさにこのガイドラインだ。「努力義務すら怠った」という事実は、過失を問われた際に極めて不利に働く。さらに、EUのAI法のように巨額の制裁金が科される市場では、日本の甘い基準など通用しない。結局、「努力義務」とは免罪符ではなく、自社の法的責任を問われた際の最低防衛ラインに過ぎないと心得るべきである。

まとめ

AIセキュリティは、今や技術部門だけの問題ではなく、事業継続に直結する経営課題です。IPAの「情報セキュリティ10大脅威」にAI関連リスクが初めてランクインした事実は、その深刻さを物語っています。本記事で解説した「AI事業者ガイドライン」や自律型AIに特化した「OWASP Top 10 for Agentic AI」などの最新指針を理解することは、効果的な対策を講じるための第一歩となるでしょう。

重要なのは、これらのガイドラインを自社の状況に合わせて具体的な対策に落とし込み、実践することです。まずは、現在社内で利用されているAIサービスや開発中のAIシステムを洗い出し、潜在的なリスクを評価することから始めてみてください。そこから優先順位をつけ、実践的な導入・運用計画を立てていく必要があります。

もし自社だけでの対策に不安を感じる場合や、何から手をつけるべきか迷っている場合は、専門家の知見を活用するのも有効な選択肢です。AIセキュリティ対策の具体的な進め方について、ぜひ一度OptiMaxにご相談ください。