生成AIで巧妙化する「なりすまし」の脅威となぜAI検知が必須なのか

生成AIの急速な進化は、「なりすまし」の手口を劇的に巧妙化させ、もはや人間の目や耳では到底見抜けないレベルに達しています。本物と見紛うディープフェイクは、オンライン上の本人確認や金融取引における深刻な脅威です。従来の目視確認が限界を迎える中、AI技術を用いて偽物を見破る「なりすまし検知AI」の導入が、今やビジネスの安全性を守る上で不可欠となりました。本章では、この新たな脅威の実態と、なぜAIによる検知が必須なのかを詳しく解説します。

生成AIで巧妙化、人間には見抜けない偽装の手口

生成AIの進化は、なりすましの手口を根底から変えました。もはや静止画や録画された映像を使うレベルではありません。例えば、SNSに投稿されたわずか数秒の音声データから本物そっくりの声を作り出し、家族や上司になりすまして電話をかける「AI音声詐欺」が急増しています。さらに深刻なのは、ビデオ会議中にリアルタイムで顔と声を入れ替えるディープフェイク技術です。実際に海外では、経営幹部になりすました犯人とのビデオ会議で、約38億円が騙し取られる事件も発生しました。これらの巧妙化する手口は、人間の目や耳による判断を完全に無力化し、ゼロトラストの考え方を個人間のやり取りにも適用せざるを得ない状況を生み出しています。

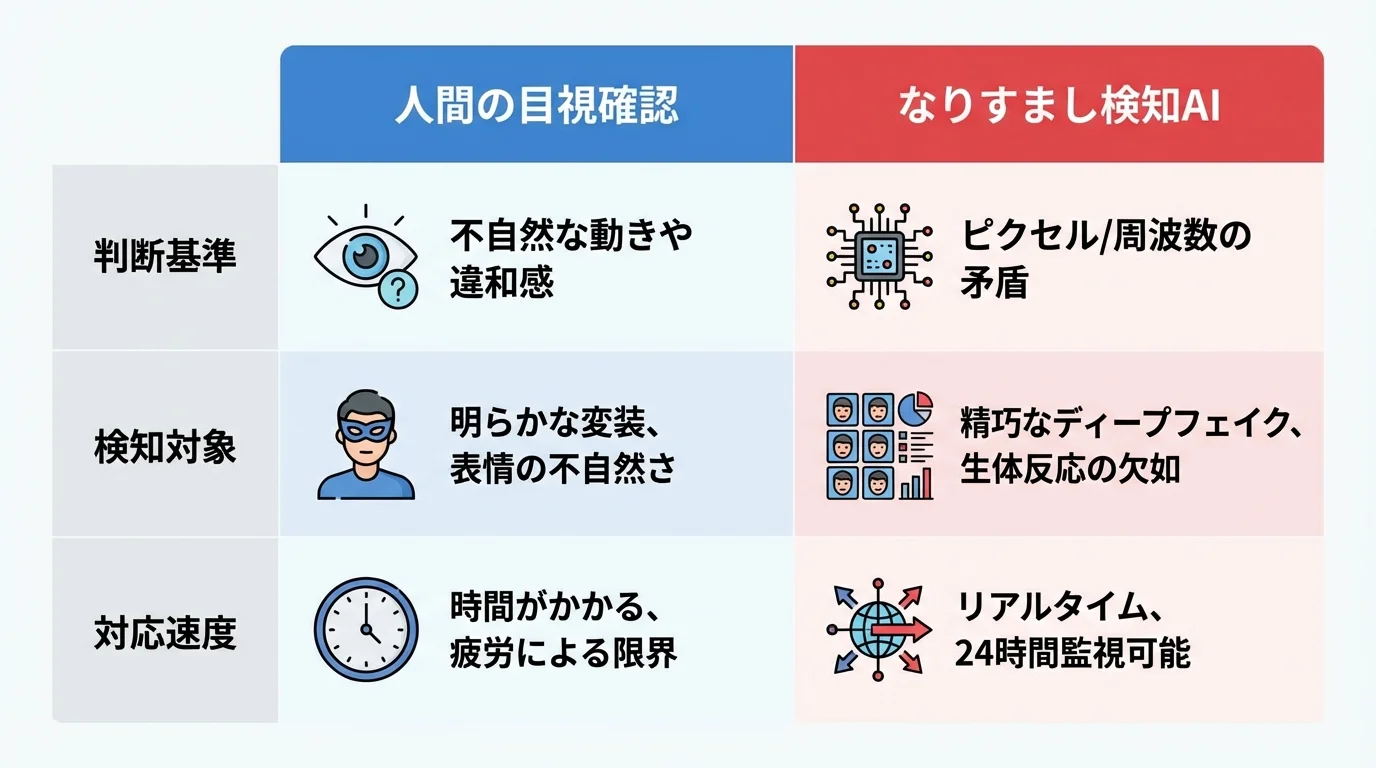

もはや目視は限界、AIによる検知が必須となる理由

生成AIの進化により、ディープフェイクは人間の目や耳では到底見抜けないレベルに達しました。かつて通用した「不自然な日本語」や「映像の瞬きの少なさ」といった判断基準は、もはや過去のものです。2024年に香港で発生した、ビデオ会議の参加者全員がディープフェイクで約38億円が詐取された事件は、その脅威を象徴しています。これは、専門家でさえリアルタイムのやり取りで見抜けなかったことを意味し、目視による本人確認の限界を明確に示しました。

このように巧妙化する手口に対抗するには、人間が知覚できないピクセルレベルの矛盾や音声の周波数パターンといった微細な異常を検出できるAIの分析能力が不可欠です。「見分けられない」ことを前提としたAIによる多層的な検知こそが、デジタル社会の信頼を守るための必須要件となっています。

ディープフェイクがもたらす社会・経済への新たな脅威

ディープフェイクの脅威は、もはや単なる技術的な課題ではありません。実際に甚大な金銭的被害を生み出す社会・経済問題へと発展しています。象徴的なのが、2024年に香港で発生したビデオ会議詐欺事件です。攻撃者はCEOやCFOなど複数の役員になりすまし、約38億円もの大金をだまし取りました。このような企業の意思決定プロセスを狙った攻撃は、巧妙化する手口の一環として、従来のセキュリティ対策に新たな課題を突きつけています。さらに、政治的な偽情報による世論操作や選挙妨害など、社会の信頼基盤そのものを揺るがすリスクも深刻化しており、英国政府がIT大手と連携して検出基準作りに乗り出すなど、国際的な対策が急務となっています。

なりすまし検知AIとは?ディープフェイクを見破る基本的な仕組み

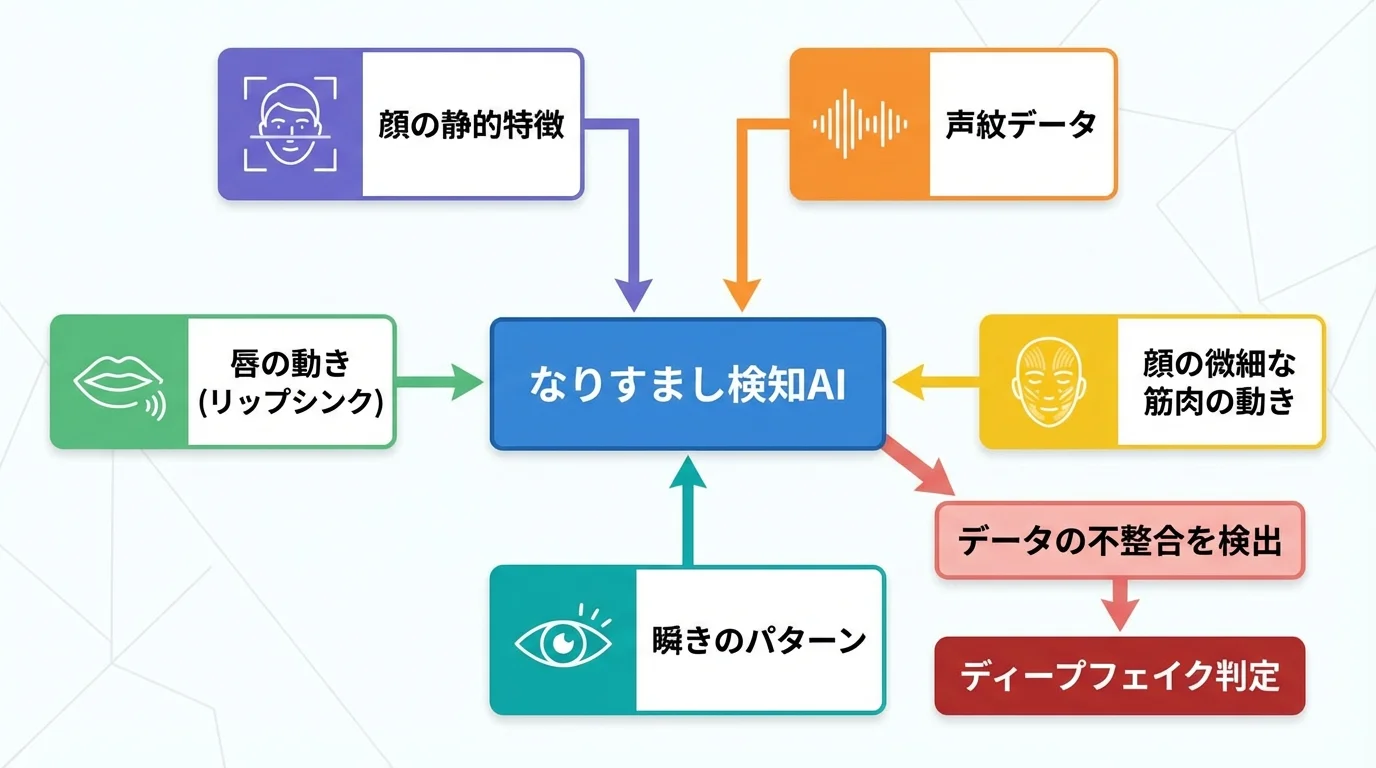

巧妙化するディープフェイクに対し、なりすまし検知AIはどのような仕組みで対抗しているのでしょうか。その鍵は、顔、声、体の動きといった複数の情報を統合的に分析する「マルチモーダル検知」にあります。さらに、AI自身が偽物を生成して学習する「敵対的学習」によって、検知能力は日々進化を続けています。ここでは、瞬きや唇の動きといった生体情報から、人間には見抜けないミクロな不自然さを見破る、AIの驚くべき仕組みの基本を解説します。

顔や声、動きを統合分析するマルチモーダル検知

マルチモーダル検知とは、ディープフェイクを見破るための核心技術です。これは、単一の情報源(例えば顔の静止画)に頼るのではなく、複数の異なる情報(モダリティ)を統合的に分析するアプローチを指します。具体的には、顔の静的な特徴だけでなく、声紋や発話時の唇の動き(リップシンク)、まばたきの頻度やパターン、顔の微細な筋肉の動きといった動的な生体情報をリアルタイムで解析します。

AIが生成した映像と音声では、人間には知覚できないごく僅かなズレや矛盾が生じがちです。なりすまし検知AIは、こうしたデータの不整合を鋭敏に捉えることで、偽物であると判断します。このように複数の情報を組み合わせることで、巧妙化する手口に対抗し、セキュリティレベルを飛躍的に向上させるのです。

AI同士が競い合い進化する「敵対的学習」の仕組み

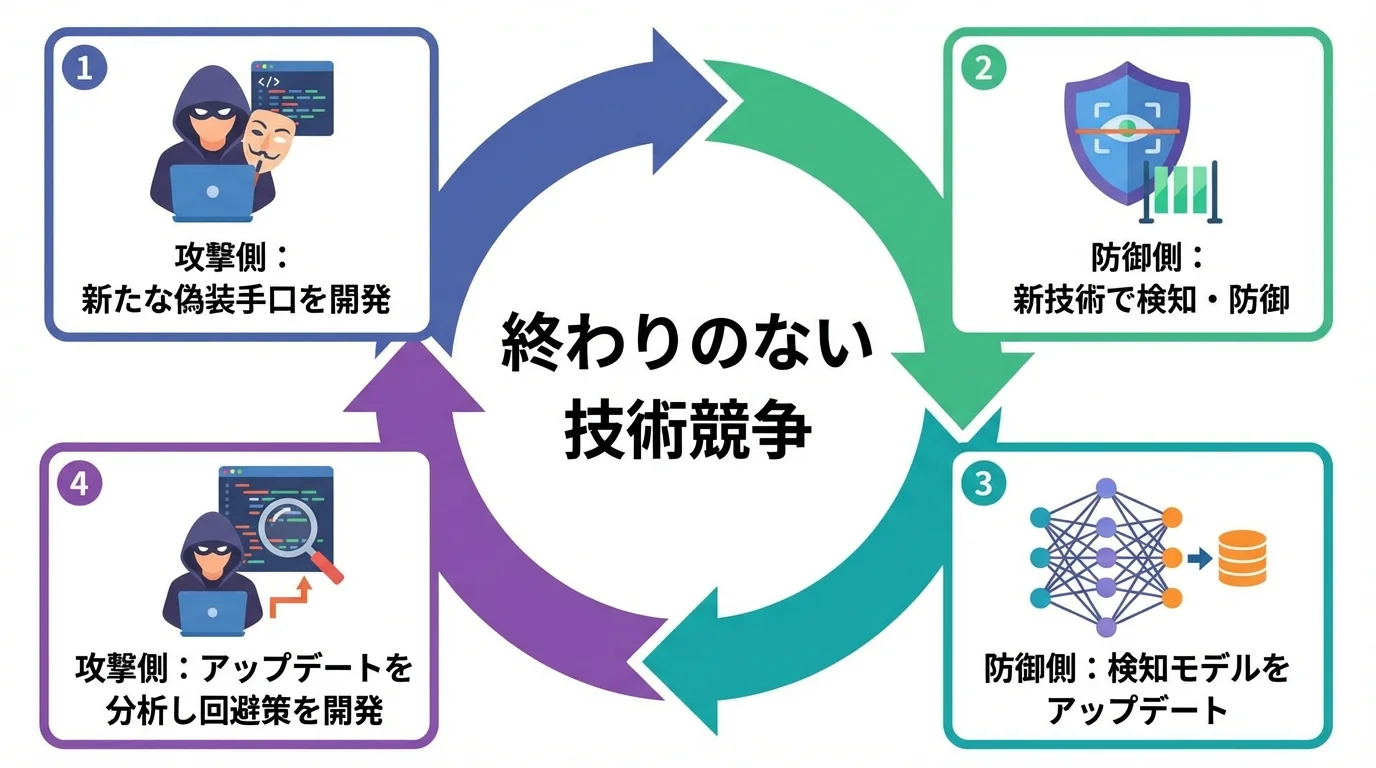

なりすまし検知AIの進化の裏には、「敵対的学習(GANs: Generative Adversarial Networks)」という、AI同士が競い合うことで性能を高めるユニークな仕組みがあります。これは、本物そっくりの偽データを作り出す「生成AI」と、それを見破る「検知AI」を同時に学習させるモデルです。生成AIは検知AIを騙そうと、より精巧なディープフェイクを生成し、検知AIは騙されまいと、その微細な不自然さを見抜く能力を向上させます。この終わりのない競争は、日々巧妙化する手口にAIが自己学習で対応し続けるための、いわば自己トレーニングなのです。この技術によって、未知の攻撃パターンにも対応できる、より強固な検知システムが構築されています。

瞬きや唇の動きなど、生体情報から不自然さを検出

ディープフェイクは、もはや顔の見た目だけでなく、人間らしい「動き」までもリアルに再現します。これに対し、なりすまし検知AIは、人間の目では見抜けない生体情報の微細な不自然さに注目します。具体的には、瞬きの頻度やタイミング、音声と唇の動きのズレ(リップシンク)、血流による肌の色の微細な変化といった、生命活動に由来する特徴を分析します。

これらの技術は「ライブネス検知」の中核をなし、録画映像や3Dマスクによるなりすましを効果的に見破ります。しかし、巧妙化する手口との技術競争は絶えず続いており、常に検知モデルのアップデートが不可欠です。

【2026年最新】顔・声・動きを統合分析する「マルチモーダルAI」の進化

これまでのAI検知の仕組みをさらに進化させたのが、2026年現在の「マルチモーダルAI」です。単に顔や声を個別に見るのではなく、顔の表情、声のトーン、唇の動きといった複数の情報を統合的に分析し、人間では到底見抜けない微細なズレや矛盾を検出します。AI自身が偽物を生成して学習する「敵対的学習」も進化を続け、検知能力を自己強化しています。本章では、その驚くべき進化の最前線を解説します。

顔・声・唇の動きを統合、偽物の微細なズレを検出

2026年のマルチモーダルAIは、顔、声、唇の動きという複数の情報を個別に分析するのではなく、それらの関係性を統合的に評価します。例えば、生成されたディープフェイク映像では、声のトーンと表情筋の動きに微妙な不一致が生じたり、発話内容と唇の動き(リップシンク)に人間では知覚できないコンマ数秒のズレが発生したりします。最新のAIは、こうした微細な非同期や不整合を瞬時に検知。この人間には見抜けない「ズレ」こそが、偽物である決定的な証拠となります。日々巧妙化する手口に対抗するため、AIは人間を超える知覚能力でなりすましを見破っているのです。

人間の知覚を超越、AIだから見抜けるミクロな不自然さ

人間の目や耳がディープフェイクに欺かれるのは、もはや当然の時代です。2026年のマルチモーダルAIは、私たちが知覚できないミクロなレベルの不自然さをデータから直接検出します。例えば、映像のフレーム間に生じるピクセルの僅かな不整合、音声に含まれる人間には聞こえない周波数帯のノイズ、あるいは顔の微細な動きと血流変化の不一致といった、生成AI特有の「生成の痕跡」を捉えるのです。こうした巧妙化する手口に対抗するため、富士通などの企業はAIが生成した痕跡を別のAIが検知する技術を開発しており、人間には不可能な領域でディープフェイクを見破る能力を高めています。

敵対的学習が進化、AIが検知能力を自己強化し続ける

マルチモーダルAIの検知精度を支える中核技術が、AI同士を競わせて能力を高める「敵対的学習」です。この仕組みでは、検知AI(防御側)が自ら膨大なパターンの最新ディープフェイクを生成し、それを「教師」として学習します。これにより、攻撃AIが作り出す未知の偽装パターンを予測し、先回りして防御能力を自己強化し続けるのです。

2026年2月には富士通が、AIが生成した不自然な点を別のAIが検知する新技術を発表するなど、開発競争は激化しています。この終わりのない「いたちごっこ」こそが、日々巧妙化する手口に対抗し、検知能力を絶えず進化させる原動力となっています。

不正アクセスを水際で防ぐ「ライブネス検知」技術の高度化

巧妙なディープフェイクによる不正アクセスをリアルタイムで阻止する鍵となるのが、「ライブネス検知」技術の高度化です。この技術は、カメラの前にいるのが本物の人間か、それとも写真や録画映像、3Dマスクといった偽物かを瞬時に見抜きます。単に顔を認証するだけでなく、瞬きや顔の微細な動きから「生きている証拠」を検出し、なりすましを水際で防ぎます。ここでは、最新のライブネス検知の仕組みと、その進化について詳しく見ていきましょう。

写真や動画による不正ログインをリアルタイムで遮断

オンラインサービスへのログイン時、画面に映っているのが本物の人間か、それとも写真や録画映像なのかを瞬時に見抜く。これが「ライブネス検知」技術の役割です。過去には、本人の写真や動画をカメラにかざすだけで認証を突破できてしまうケースがありましたが、AI技術の進化がこの脆弱性を克服しました。

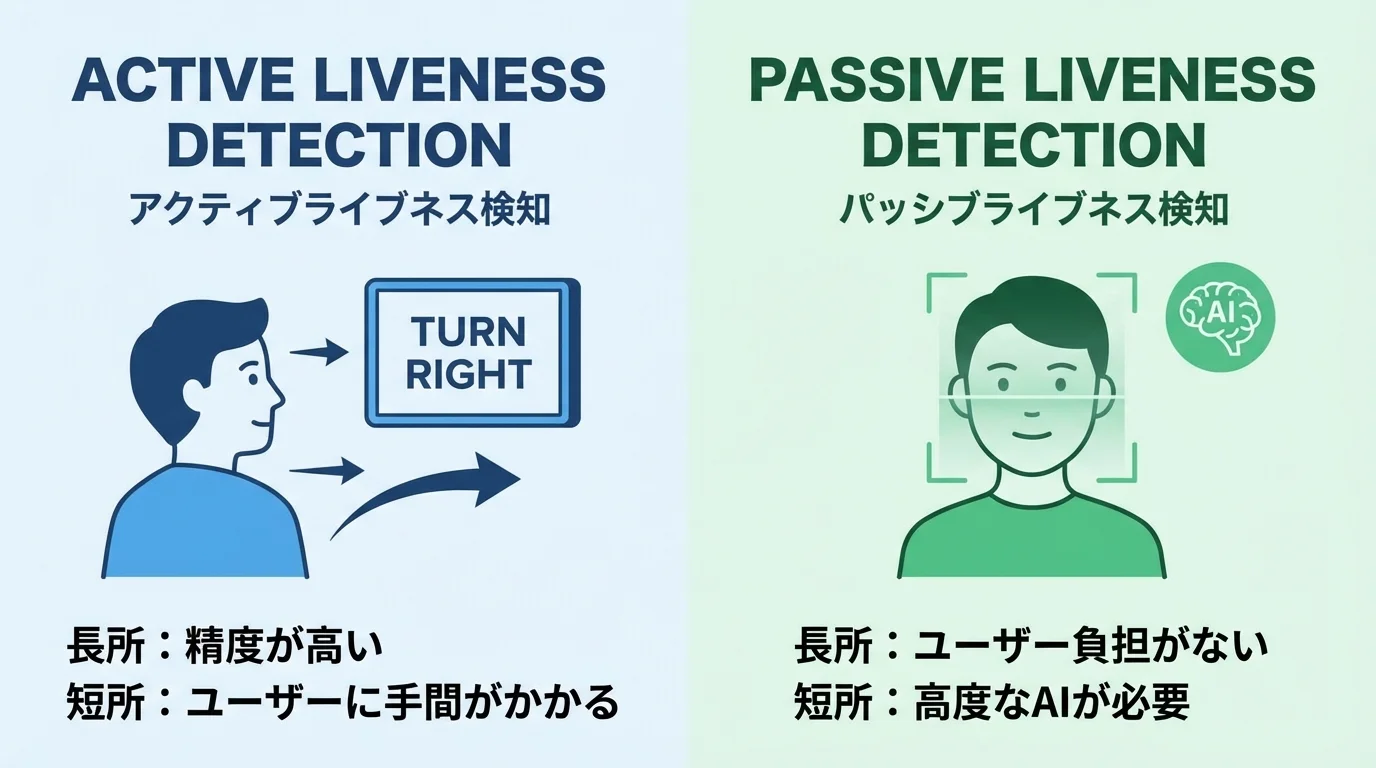

最新のシステムでは、2つの高度な検知方法が主流です。一つは「右を向いてください」といった指示にリアルタイムで従わせる「アクティブライブネス検知」。もう一つは、ユーザーに負担をかけず、顔の微細な動きや肌の質感、光の反射などからAIが自動で生身の人間か判定する「パッシブライブネス検知」です。これらの技術により、巧妙化する手口による不正ログインを水際で食い止め、安全なオンライン本人確認(eKYC)や金融取引を実現しています。

瞬きや顔の微細な動きから「生きている」証拠を検出

ライブネス検知技術は、単に顔が映っているかだけでなく、それが「生きている」本物の人間であるかをリアルタイムで検証します。その鍵となるのが、人間特有の生体反応の分析です。AIは、カメラ映像から瞬きのパターンや間隔、顔の筋肉の微細な動き、さらには血流による肌の色の微細な変化といった、人間には知覚できないレベルの情報を高速で解析します。これにより、録画映像や精巧な3Dマスク、さらにはリアルタイムで生成されたディープフェイク映像の不自然さを見破ります。特に、ユーザーに特別な動作を求めずにバックグラウンドで検知を行う「パッシブライブネス検知」が主流となりつつあり、セキュリティを強化しつつユーザー体験を損なわない認証を実現しています。これら巧妙化する手口への対策として、生体情報の微細な変化を捉える技術は不可欠です。

高度なディープフェイク攻撃を想定した防御技術の進化

従来のライブネス検知を突破しようとする、ビデオ会議をリアルタイムで乗っ取るような高度なディープフェイク攻撃が現実の脅威となっています。これに対し、防御技術も新たな段階へと進化しました。例えば、富士通が2026年に発表した新技術のように、AIが生成した映像の微細な不整合を別のAIが検出するアプローチが主流です。また、自ら偽の映像を生成して学習させる敵対的学習も高度化し、未知の攻撃への対応力を強化しています。技術開発だけでなく、英国政府とIT大手が連携して進める国際的な基準作りといったルール整備も加速しており、こうした多層的な防御が巧妙化する手口からデジタル社会の信頼を守る鍵を握っています。

富士通も新技術を発表!国内外のディープフェイク検出技術の最前線

巧妙化するディープフェイクとの戦いは、世界レベルでの技術開発競争へと発展しています。2026年2月には国内で富士通が新たな検知技術を発表したほか、英国政府がIT大手と連携して世界初の技術基準作りに乗り出すなど、その動きは加速しています。本セクションでは、国内外の企業や政府による最先端の取り組みと、国際的なルール形成の動きを詳しく見ていきましょう。

富士通が発表、2026年のディープフェイク検知新技術

国内外の技術開発競争が激化する中、2026年2月、富士通が画期的なディープフェイク検知技術を発表し、大きな注目を集めています。この新技術の核心は、生成AIによって作られた映像や音声に含まれる、人間には知覚できない微細な痕跡や矛盾点を、別のAIが検知するというアプローチにあります。攻撃側AIのクセや生成パターンを学習することで、従来の検知手法をすり抜ける未知のディープフェイクにも対応できる可能性を秘めています。金融機関など、高度なセキュリティが求められる分野では、こうした巧妙化する手口への対抗策として、2026年以降の実用化が強く期待されています。

国内外で加速する技術開発、企業間の熾烈な競争

富士通の新技術発表に象徴されるように、ディープフェイクとの戦いは個社の取り組みを超え、世界的な技術開発競争へと発展しています。国内では、国立情報学研究所(NII)がNECなどと連携し、国家レベルでの偽情報対策プラットフォーム開発に着手。一方、海外に目を向けると、英国政府がマイクロソフトなどIT大手と協力し、世界初となるディープフェイク検出の技術基準作りを主導するなど、国際的なルール整備も加速しています。このように巧妙化する手口に対抗するため、企業や国家を巻き込んだ熾烈な競争が繰り広げられているのです。

技術だけじゃない、国際的な連携とルール作りの動き

巧妙化するディープフェイクの脅威は、もはや一企業や一国の技術開発だけで対抗できる問題ではありません。そのため、技術開発と並行して、国境を越えた連携と統一的なルール作りが急務となっています。象徴的な動きとして、2026年2月には英国政府がマイクロソフトなどのIT大手と連携し、世界で初めてディープフェイク検出技術の基準作りを開始したと発表しました。この取り組みは、乱立する検知技術の信頼性を評価する共通の物差しとなり、社会全体で対策を進める上での重要な基盤となります。こうした国際的な枠組みは、巧妙化する手口が問題となる金融分野をはじめ、あらゆる業界で安全なデジタル取引を実現するために不可欠な動きと言えるでしょう。

オンライン本人確認から金融サービスまで広がるAI検知の活用事例

これまで解説してきた高度ななりすまし検知AIは、すでに私たちの生活を支える様々なサービスで実用化されています。特に、高いセキュリティが求められるオンライン本人確認(eKYC)や金融機関の不正対策においては、もはや不可欠な基盤技術となりつつあります。本章では、銀行の口座開設から採用面接、SNSの安全性確保まで、社会の信頼を守るAI検知の具体的な活用事例を詳しく見ていきましょう。

安全なオンライン本人確認(eKYC)を支えるAI技術

非対面での口座開設や契約手続きに不可欠なオンライン本人確認(eKYC)は、なりすまし検知AIがセキュリティの根幹を担っています。具体的には、提出された身分証明書が偽造でないかを判定する真贋判定と、カメラの前の人物が本物であることを確認するライブネス検知が中心です。しかし、巧妙化する手口により、これらの技術だけでは不十分になりつつあります。そのため、2026年現在では、住信SBIネット銀行のように取引時にも顔認証を組み合わせたり、政府が推進するマイナンバーカードのICチップ読み取りを併用したりするなど、多層的な防御策が新たな標準となっています。

金融機関の不正送金や口座開設を水際で阻止

金融機関では、ディープフェイク技術を悪用した不正な口座開設や不正送金のリスクが深刻化しており、なりすまし検知AIの活用が不可欠となっています。例えば、住信SBIネット銀行では2026年3月から、取引時の不正検知と顔認証を連動させた新システムを導入。口座開設時の本人確認だけでなく、取引中の不審な動きもAIがリアルタイムで監視し、被害を水際で阻止します。もはや顔認証単体では不十分とされ、取引パターン分析などを組み合わせた多層的な防御が不可欠です。こうした対策は、AIによるクレジットカード不正検知にも応用され、巧妙化する手口への対抗策として進化を続けています。

採用面接からSNSまで、多様化するAI検知の活用

なりすまし検知AIの活躍の場は、金融や公的手続きといった厳格な本人確認が求められる領域にとどまりません。私たちの日常生活やビジネスの様々なシーンで、その重要性が高まっています。例えば、オンラインでの採用面接や資格試験では、ディープフェイク技術を利用した「替え玉受験」を防止するために活用されています。ビデオ会議の参加者全員がディープフェイクだったという海外の詐欺事件も発生しており、人物の同一性をリアルタイムで確認する技術は不可欠です。また、SNS上では著名人になりすました詐欺広告の検知や、C2C(個人間取引)サービスにおける本人確認の徹底にもAIが貢献しています。こうした巧妙化する手口に対抗するため、AI検知はデジタル社会の信頼を支える基盤技術として、その活用範囲を広げ続けているのです。

なりすまし検知AI導入時に知っておくべき注意点と今後の課題

ここまでAIの華々しい進化を見て、導入すれば全てが解決するかのような錯覚に陥っていないだろうか。だが、そんなうまい話はない。なりすまし検知AIは魔法の杖ではなく、安易な導入は火傷のもとだ。本章では、検知精度100%という幻想、高額なコスト、そして攻撃者との終わらないイタチごっこという厳しい現実を包み隠さず解説する。導入後に「こんなはずではなかった」と嘆く前に、不都合な真実と向き合ってもらおう。

検知精度100%は幻想、誤検知・検知漏れのリスク

AIを導入すれば全て解決するなどという甘い考えは、今すぐ捨てるべきだ。検知精度100%などという謳い文句は、現実を知らない者の戯言にすぎない。実際には、正規ユーザーを不正と誤検知してビジネス機会を失うか、不正者を見逃して損害を被るかの二択を常に迫られる。特に、AIの判定を鵜呑みにし、人間による最終確認フローを軽視する運用は愚の骨頂と言える。

低リスクなサービスに高額なAIを導入するのは、典型的な無駄金だ。費用対効果が見合わないなら、多要素認証の徹底など、地味だが確実な従来型セキュリティ対策の方がよほどマシなケースも多い。AIは万能の銀の弾丸ではなく、あくまで補助ツールの一つに過ぎないことを肝に銘じるべきだ。

高額な導入コストと継続的な更新の必要性

最新AIという言葉に惹かれて安易に導入計画を立てているなら、即刻考え直すべきだ。なりすまし検知AIは、高額な初期費用だけでなく、API利用料やライセンス更新といったランニングコストが重くのしかかる。攻撃者は常にAIの裏をかこうと進化しており、検知モデルもそれに追随して頻繁なアップデートが必須。つまり、導入後も半永久的にコストを払い続ける「サブスクリプション型のイタチごっこ」に他ならない。リスクの低いサービスにまで最新AIを導入するのは、費用対効果が全く見合わない典型的な失敗例だ。重要な取引に限定し、昔ながらのコールバックによる本人確認と組み合わせる方が、よほど現実的で賢明な判断と言えるだろう。

巧妙化する脅威との終わらないイタチごっこ

最新AIを導入すれば脅威から解放される、などという幻想を抱いているなら、今すぐ目を覚ますべきだ。それはゴールではなく、終わりなき軍拡競争のゴングに過ぎない。攻撃側もまた、検知AIを騙すためだけに最適化された敵対的生成ネットワーク(GANs)を使い、こちらの防御網を突破する新型ディープフェイクを日夜生成しているのだ。一度導入して満足し、高額な更新費用を渋る企業など、彼らにとって格好の的にすぎない。問われているのはAIの性能ではない。この終わらないイタチごっこに付き合い続ける覚悟と体力だ。それが無いなら、いっそアナログなコールバック確認を徹底する方が、よほどマシな投資と言えるだろう。

まとめ

生成AIの進化により、ディープフェイクを利用したなりすまし攻撃は、もはや他人事ではありません。従来のセキュリティ対策だけでは見抜けない巧妙な手口に対抗するためには、AI技術の活用が不可欠です。

本記事で解説したように、顔・声・動きを統合的に分析するマルチモーダルAIや、実在性を確認するライブネス検知といったなりすまし検知AIは、不正アクセスを水際で防ぐ強力なソリューションです。これらの最新技術を正しく理解し、自社のサービスと顧客資産を守るための対策を具体的に検討するステージに来ています。

セキュリティ対策の第一歩として、まずは専門家による現状分析から始めてみてはいかがでしょうか。