ChatGPT社内ルールとは?2026年のビジネス利用で必須な理由

2026年、ビジネスシーンでのChatGPT活用は当たり前になりました。「GPT-5.3-Codex」など高性能モデルの登場で業務は効率化する一方、情報漏洩のリスクはかつてなく高まっています。なぜ今、ChatGPT社内ルールがすべての企業にとって必須なのでしょうか。ここでは、AIの最新動向とセキュリティの観点から、その明確な理由を解説します。

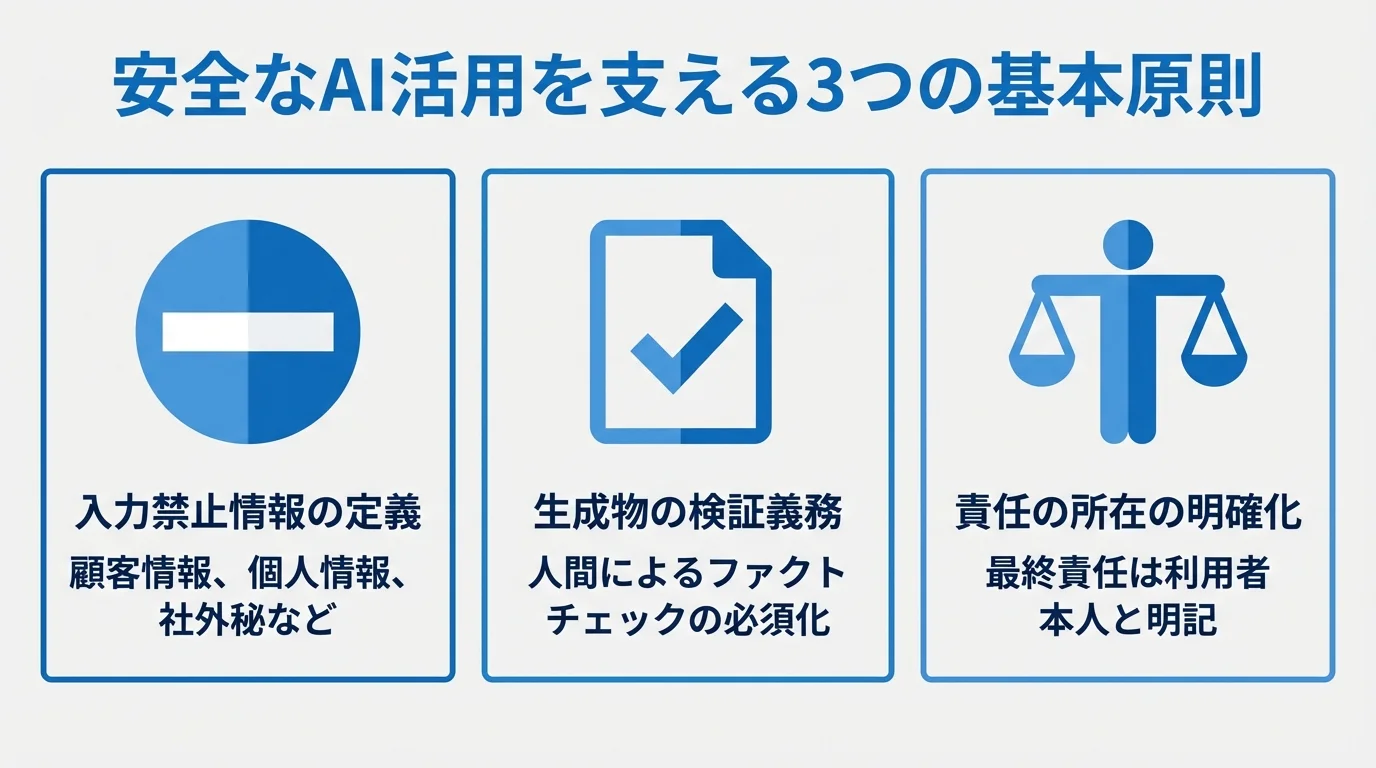

安全なAI活用を支える基本ガイドライン

IPA(情報処理推進機構)が発表した「情報セキュリティ10大脅威2026」でAI関連リスクが上位にランクインしたことからも、ガイドラインの策定は急務です。社内ルールは単なる禁止事項ではなく、従業員が安心してAIの能力を引き出すための「安全な道しるべ」と捉えましょう。

その基本は、大きく3つの柱から成ります。第一に「入力禁止情報の定義」です。顧客情報や個人情報、社外秘の技術情報など、漏洩してはならないデータを具体的に定めます。第二に「生成物の検証義務」。AIの出力は誤情報を含む可能性があるため、必ず人間がファクトチェックを行うプロセスをルール化することが重要です。そして最後に「責任の所在の明確化」。AIの生成物を利用した結果の最終的な責任は、利用者本人にあることを明記することで、慎重な活用を促します。これらの原則は、企業におけるChatGPTのリスクとはを管理する上で最も基本的な土台となります。

GPT-5.3登場で高まる情報漏洩リスク

2026年2月にリリースされた「GPT-5.3-Codex」は、コード生成や推論能力が飛躍的に向上した高性能モデルです。その利便性の高さから、従業員が開発中のソースコードや社外秘の事業戦略といった機密情報を安易に入力してしまう危険性が高まっています。特に、自律的にタスクを処理する「エージェント型モデル」の特性は、意図しない情報アクセスを引き起こす可能性も否定できません。旧モデルの提供が終了し高性能モデルへの移行が必須となった今、企業におけるChatGPTのリスクとは何かを正しく理解し、対策を講じることが急務です。

2026年のAI進化がルールを必須にする背景

2026年、社内ルールが必須となった背景には、AIの質的な変化があります。もはやChatGPTは単なる文章生成ツールではなく、自律的に思考し動作する「エージェント」へと進化しました。2026年2月には旧モデル(GPT-4oなど)の提供が終了し、全ユーザーが自動的に高性能なGPT-5系統へ移行。これにより、従業員は意識せずとも、より高度な推論能力を持つAIを扱うことになったのです。「GPT-5.3-Codex」のようなモデルは、指示されたタスクをこなすだけでなく、能動的に業務をサポートします。このようなAIの自律的な動作は、企業におけるChatGPTのリスクとは何かを根本から問い直すものであり、性善説に頼った注意喚起だけでは不十分なのです。

ルール策定前の準備|利用目的の明確化と対象範囲の決定

効果的なルールを作るためには、やみくもに禁止事項を並べるのではなく、事前の準備が不可欠です。2026年現在、コーディング支援に特化した「GPT-5.3-Codex」のような高性能モデルが登場する中で、まず「何のためにAIを導入するのか」という利用目的を明確化することが重要になります。その上で、全社で一斉に導入するのか、特定の部署から始めるのか、利用する従業員の範囲を定めていきましょう。

最新モデルで何を実現するか?導入目的の明確化

社内ルール策定の第一歩は、「何のためにChatGPTを導入するのか」という目的を具体的に定義することです。単に「業務を効率化したい」という漠然とした目標では、効果的なルールは作れません。2026年現在、コーディング支援に特化したGPT-5.3-Codexや、より質の高い応答を生成するGPT-5.2 Instantなど、高性能なモデルが登場しています。これらの最新モデルを使い、「開発部門のデバッグ工数を30%削減する」「マーケティング部門のコンテンツ作成時間を半減させる」といった数値目標を設定しましょう。目的が明確であれば、必要な機能や許容すべきリスクの範囲も自ずと定まります。まずは、ChatGPTの仕事の中で、どの部分をAIに任せるかを具体的に洗い出すことから始めましょう。

全社か部署か?利用する従業員の範囲を決定

導入目的を定めたら、次にChatGPTを「誰が」「どの範囲で」利用するのかを決定します。アプローチは大きく2つ、「全社一斉導入」と「特定部署でのスモールスタート」です。

2026年現在、IPAの調査でもAI関連のリスクが指摘される中、多くの企業ではまず特定の部署で試験的に導入するスモールスタートが推奨されます。例えば、開発部門で最新のGPT-5.3-Codexを使ったコーディング支援を試したり、マーケティング部門でコンテンツ作成の効率化を図ったりします。

こうした小規模な導入で企業におけるChatGPTのリスクとは何かを具体的に把握し、成功事例を蓄積することが、最終的に全社展開を成功させる鍵となります。

入力して良い情報とダメな情報の線引き

ChatGPTを安全に利用する上で最も重要なのが、入力する情報の線引きです。IPAの「情報セキュリティ10大脅威2026」でもAI関連リスクが上位に挙げられており、情報漏洩は企業の信頼を揺るがす重大な問題となります。企業におけるChatGPTのリスクとはでも解説している通り、一度漏洩した情報は取り返しがつきません。

具体的には、氏名や連絡先などの個人情報、取引先の契約内容といった顧客情報、そして未公開の製品情報やソースコードなどの社外秘情報は、絶対に入力してはいけません。法人向けプランでは入力データがAIの学習に使われない設定が標準ですが、万一のリスクを避けるため、これらの機密情報は入力禁止と定めるのが鉄則です。

一方、Webサイトで公開済みの情報や、個人・企業が特定できないよう加工・匿名化されたデータであれば、入力しても問題ありません。この線引きをルールで明確にすることが、安全な活用の第一歩となります。

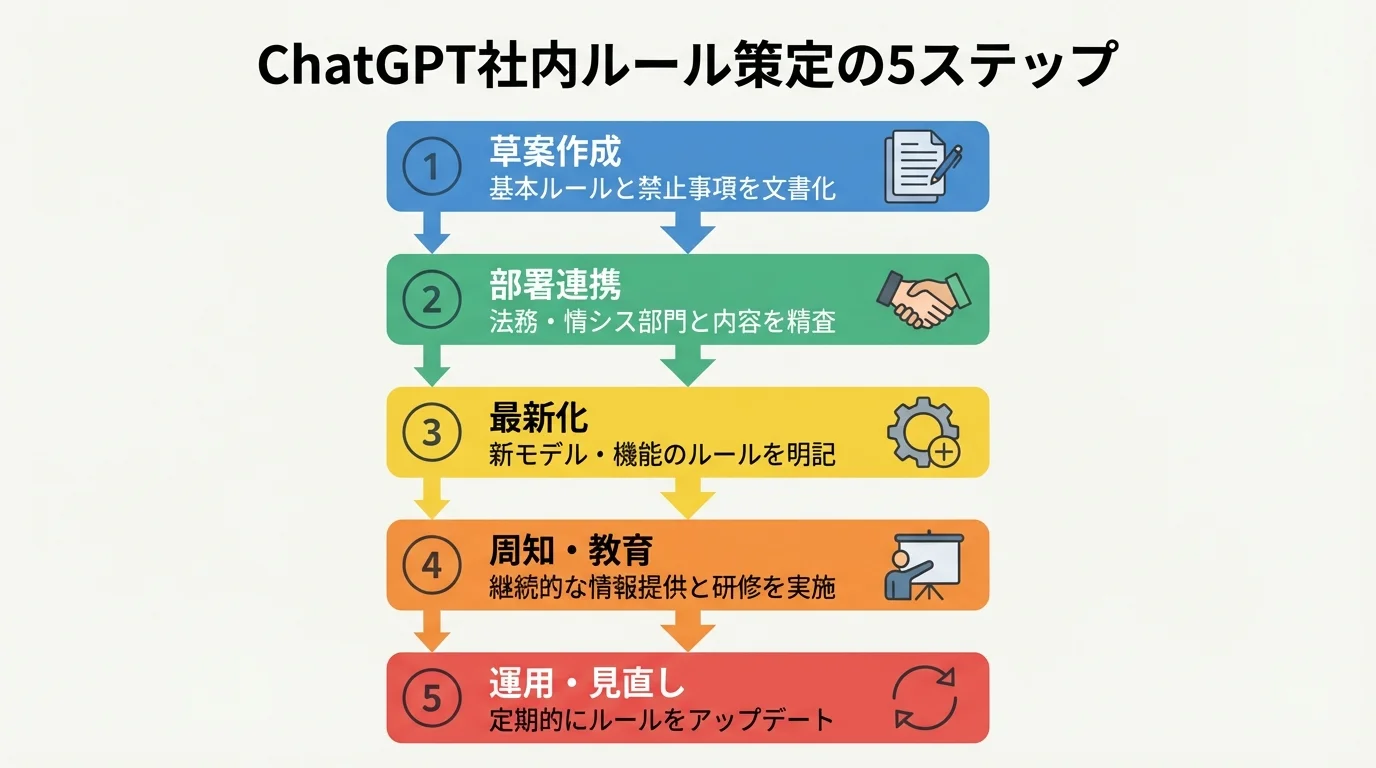

5ステップで解説!ChatGPT社内ルールの具体的な作り方

利用目的の明確化といった準備が整ったら、いよいよ社内ルール策定の核心部分です。IPAの「情報セキュリティ10大脅威2026」でもAIリスクが指摘される中、実効性のあるガイドラインは不可欠です。本セクションでは、基本ルールの草案作成から関係部署との連携、運用と見直しまで、誰でも実践できる5つのステップで具体的な作り方を分かりやすく解説していきます。

ステップ1:基本ルールと禁止事項の草案を作成

ルール策定の第一歩は、守るべき基本事項と明確な禁止事項を文書化することから始まります。まずは叩き台となる草案を作成しましょう。最も重要なのは、入力禁止情報を具体的に定義することです。顧客の個人情報、未公開の財務データ、独自技術に関する情報などをリストアップし、情報漏洩リスクを徹底的に排除します。どのような情報が企業におけるChatGPTのリスクとはに繋がるかを明確にすることが重要です。

あわせて、生成物の取り扱いルールも定めます。AIの回答には誤りが含まれる可能性があるため、人間によるファクトチェックを義務付け、最終的な責任は利用者本人にあることを明記しましょう。利用を許可するツール(例:データが学習に使われない法人向けプラン)を指定することも、草案に盛り込むべき必須項目です。

ステップ2:法務・情報システム部門と内容を精査

ステップ1で作成した草案は、あくまでたたき台です。実効性のあるルールにするためには、法務部門と情報システム部門という専門家の視点による精査が欠かせません。この段階では、各部門とレビュー会を設定し、フィードバックをもらう具体的なアクションが必要です。

まず法務部門には、生成物が他社の著作権や知的財産権を侵害するリスクがないか、OpenAIの利用規約と社内ルールに矛盾がないかを確認してもらいます。次に情報システム部門には、企業におけるChatGPTのリスクとは何かを技術的観点から評価してもらいましょう。特に、入力データがAIの学習に使われない法人向けプランの利用を必須とするか、API利用時のセキュリティ要件などを詰めることが重要です。

両部門からの指摘を草案に反映させることで、法的・技術的なリスクを回避し、全社で安心して使えるガイドラインへと昇華させることができます。

ステップ3:GPT-5.3-Codexなど新機能のルールを明記

ステップ2で精査した基本ルールに、AIの進化へ対応するための条項を追加します。まず、2026年2月時点で利用が開始された「GPT-5.3-Codex」のように、社内で利用を許可する最新モデルと付随する機能をリストアップし、文書に明記してください。次に、各モデルの特性(例:Codexはソースコード生成に特化)と、推奨される業務、禁止される利用法を具体的に追記します。特にソースコードなど、企業におけるChatGPTのリスクとはが高い情報の取り扱いについては、許可範囲や匿名化の手順を厳密に定めることが不可欠です。今後、新機能が登場した際の利用申請や承認プロセスもルールに含めておくと、ガイドラインが陳腐化するのを防げます。

GPT-5.3-Codexも対象に!最新モデル利用時のガイドライン作成ポイント

ChatGPTの社内ルールは、技術の進化に合わせて更新し続ける必要があります。特にコーディング支援に革命をもたらすGPT-5.3-Codexのような特化型モデルが登場した今、汎用的なルールだけでは不十分です。本セクションでは、機密情報を含むソースコードの取り扱いや、モデルごとの特性に合わせた利用シーンの明記など、最新AIを最大限に活かしつつリスクを管理するためのガイドライン作成ポイントを掘り下げます。

ソースコードの取り扱いと機密情報の定義

2026年に登場したコーディング特化モデルGPT-5.3-Codexの活用には、ソースコードの厳格な取り扱いルールが不可欠です。まず、「機密情報の定義」を明確にし、ソースコードがその核心部分であることを全社で共有しましょう。具体的には、「顧客情報」「未公開の財務データ」はもちろん、「製品の根幹をなすアルゴリズム」などを入力禁止情報としてリスト化します。一方で、個人情報を含まない汎用的なコードスニペットのデバッグなど、許容範囲を定めることも重要です。こうした企業におけるChatGPTのリスクとはを具体的に洗い出すことで、現場が萎縮せず安全にAIを活用できる環境が整います。

高度な推論機能の業務適用範囲を定める

2026年に登場した「GPT-5.3-Codex」のような最新モデルは、市場データ分析や事業戦略の立案支援など、高度な推論能力を発揮します。しかし、これらの強力な機能をどの業務まで許可するか、その適用範囲を明確に定めることが極めて重要です。なぜなら、AIによる推論には誤情報(ハルシネーション)のリスクが依然として存在し、誤った分析結果が重大な経営判断ミスにつながる恐れがあるからです。

ルールには「最終的な意思決定への直接利用は禁止し、あくまで参考情報として扱う」「生成された分析レポートは必ず担当者がファクトチェックを行う」といった具体的な利用プロセスを明記しましょう。これにより、企業におけるChatGPTのリスクとはを管理し、安全な活用を促進できます。

モデルごとの特性に合わせた利用シーンを明記

2026年現在、ChatGPTには多様なモデルが存在し、それぞれ得意分野が異なります。社内ルールでは、モデルごとの推奨利用シーンを具体的に定めることが生産性向上の鍵です。例えば、高度なコード生成やリファクタリングには、開発部門がGPT-5.3-Codexを利用するよう指定します。一方、社内向けの報告書やなぜ速いと評判のメール作成には、落ち着いたトーンで要点をまとめるのが得意なGPT-5.2 Instantが適しているでしょう。このように使い分けを明記することで、従業員は迷わず最適なツールを選択でき、業務効率が最大化されます。

よくある失敗例|ルールが形骸化しないための運用の注意点

せっかく時間と労力をかけてChatGPT社内ルールを作っても、数ヶ月後には誰も見向きもしない「お飾り」になっては意味がない。残念ながら、これは多くの企業が陥る典型的な失敗だ。このセクションでは、そんなルールの形骸化を招く運用上の注意点を、忖度なく解説する。あなたの会社が同じ轍を踏まないよう、現場でよくある失敗例を正直に見ていこう。

定期的な見直しを怠りルールが陳腐化

ルールを作って満足するのは、"やったふり"仕事の典型だ。AIの世界では、一度決めたルールなど数ヶ月で化石と化す。2026年に入ってたった数ヶ月で、GPT-4系統は提供終了し、「GPT-5.3-Codex」のような新モデルが次々と登場している。半年前の常識で書かれた利用規定が、今の技術環境に適合しているはずがない。

「とりあえず作った」だけのガイドラインは、情報システム部門のファイルサーバーの肥やしになるのが関の山。最低でも四半期に一度は専門部署が主導し、最新の技術動向や利用実態に合わせてアップデートする運用体制を構築しなければ、そのルールはリスク防止どころか、企業の成長を阻害する足枷にしかならない。

利用者への教育や周知が一度きりで終わる

ルールブックを配布し、一度説明会を開けば全員が理解すると考えるのは、担当者の傲慢か、ただの怠慢だ。導入時の研修だけで仕事をした気になっているケースが後を絶たないが、これはルールの形骸化を招く典型的な失敗パターンである。

AI技術は日進月歩だ。2026年に入ってからも「GPT-5.3-Codex」のような特化型モデルが次々と登場している。こうした新機能の正しい使い方や潜在的リスクを、現場の利用者は知らないままだ。結果として、便利な機能を使いこなせないか、あるいは古い知識のまま誤った使い方をして情報漏洩インシデントを引き起こす。

周知活動は一度きりのイベントではない。新機能のリリースに合わせた勉強会の開催や、社内チャットでの定期的なTips共有など、継続的な情報提供の仕組みを構築しなければ、立派なルールもただの飾り物と化すだろう。

厳しすぎる禁止事項で現場の利用が停滞する

リスク回避に走るあまり、「個人情報・機密情報はおろか、社内情報の一切の入力を禁じる」といった思考停止ルールを掲げていないだろうか。これでは議事録の要約すらできず、ChatGPTはただの賢い検索エンジンに成り下がる。2026年現在、入力データを学習に利用しない法人向けプランが主流であるにもかかわらず、無料版と同じ感覚で全てを禁じるのは担当者の怠慢でしかない。真に定めるべきは、禁止事項の羅列ではなく、入力情報を匿名化する手順や、どのレベルの情報までなら法人プランで扱ってよいか、という「攻めの指針」だ。守り一辺倒のルールでは、何も生まれない。

まとめ:ChatGPT社内ルールで安全かつ効果的な活用を実現しよう

本記事では、ChatGPTのビジネス利用に不可欠な社内ルールの作り方を、準備段階から具体的な5ステップ、そして運用の注意点まで詳しく解説しました。利用目的を明確にし、情報漏洩などのリスクを管理しながら生産性を最大化するガイドラインの策定方法をご理解いただけたのではないでしょうか。

この記事で解説した手順に沿って進めれば、GPT-5.3-Codexのような最新AIの登場にも慌てず対応できる、実用的なルールが作成できます。まずは第一歩として、自社の利用目的を整理するところから始めてみましょう。効果的なガイドラインは、企業のAI活用を加速させる羅針盤となります。

「自社に最適なAI戦略がわからない」「ルール作りを専門家と進めたい」という方は、ぜひこの機会にご相談ください。

【期間限定】2025年最新版『AI・DX推進戦略ハンドブック』無料プレゼント中!

100社以上の相談実績から導き出した「失敗しないAI導入の7ステップ」を含むハンドブックを無料でお届けします。ご希望の方には、ハンドブックの内容に基づいた「自社専用AI活用ロードマップ」の無料作成会も実施しております。