AIが変えるサイバー攻撃|今、企業にAIセキュリティが求められる理由

AIの進化はビジネスを加速させる一方で、サイバー攻撃の脅威をかつてないレベルに引き上げています。攻撃者は生成AIを悪用し、人間が見抜けないほど巧妙なフィッシングメールを大量に作成。侵入から内部活動開始までの時間は平均29分にまで短縮されました。IPAの「情報セキュリティ10大脅威 2026」でAI関連リスクが初めて3位にランクインするなど、もはや従来の防御策は限界に達しているのが実情です。ここでは、AIによって激変する脅威の実態と、今こそAIセキュリティが不可欠な理由を解説します。

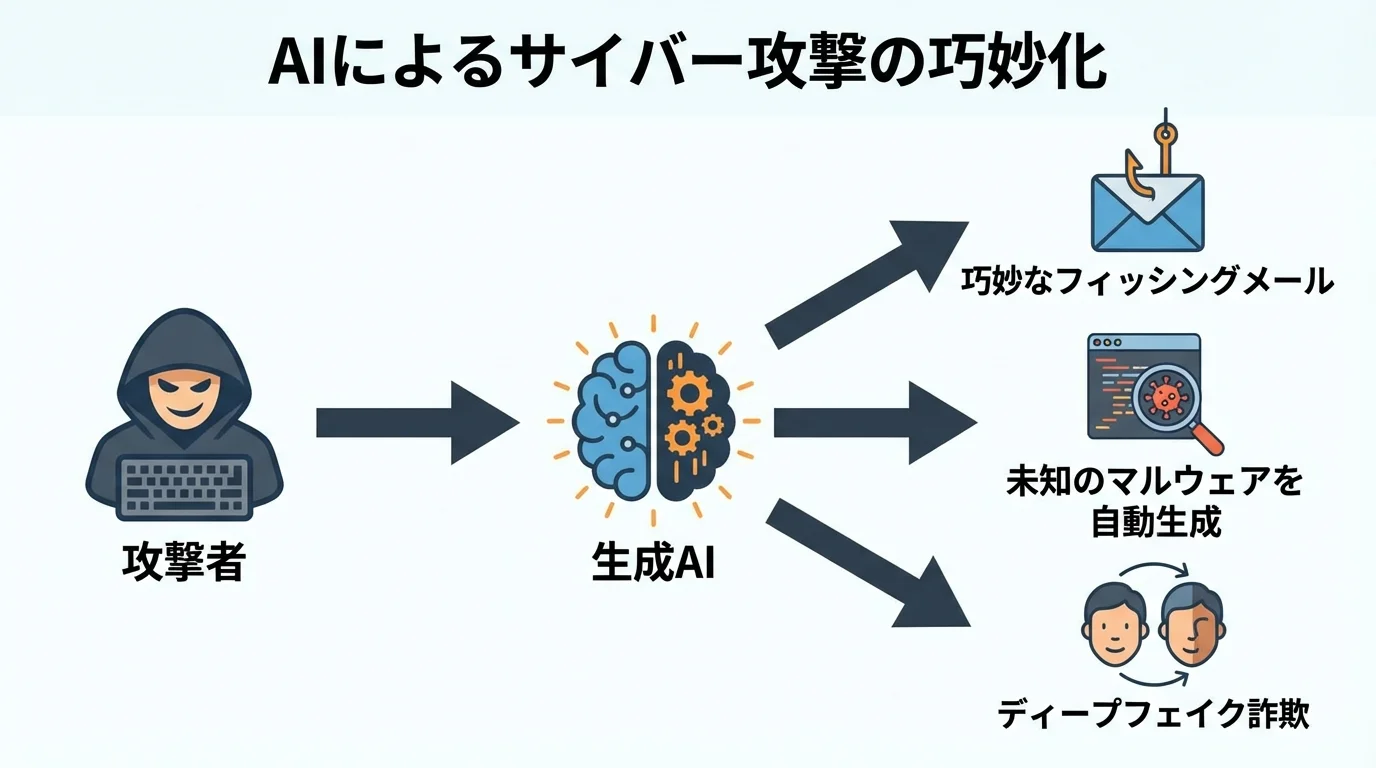

生成AIの悪用で巧妙化・自動化するサイバー攻撃

生成AIは、もはや防御側だけの技術ではありません。攻撃者はAIを強力な武器として悪用し、サイバー攻撃をかつてないほど巧妙かつ自動化しています。例えば、攻撃者はAIを用いて脆弱性を自動で発見し、検知を回避するマルウェアのコードを瞬時に生成します。これにより、攻撃キャンペーンの準備期間が劇的に短縮されました。さらに深刻なのは、ソーシャルエンジニアリングの進化です。文法的に完璧で標的の業務内容に合わせたメールだけでなく、経営者の声や映像をAIで再現する「ディープフェイク詐欺」も現実の脅威です。これらは、AIがもたらすセキュリティリスクとは何かを具体的に示しており、従業員が人間系のスキルだけで見抜くことは極めて困難でしょう。実際に、正規のAIツールに悪意あるプロンプトを注入する攻撃が90以上の組織で確認されるなど、AI自体が攻撃の踏み台にされています。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

攻撃の高速化で従来型セキュリティは限界に

AIによる攻撃の脅威は、巧妙さだけではなく、その圧倒的な「速度」にあります。CrowdStrike社のレポートでは、AIを活用した攻撃が前年比で89%も増加したと報告されており、攻撃の量とスピードは人間の対応能力を完全に凌駕します。従来のセキュリティ対策の主流であったシグネチャベース(パターン照合)では、AIが瞬時に生成する未知のマルウェアには対応できません。また、NTTデータグループが警鐘を鳴らすように、一度侵入を許せば内部で高速に活動を広げる攻撃に対し、従来の境界型防御は無力です。増え続けるアラートの洪水から重要な脅威を見つけ出すには、もはや人手だけでは限界があり、AIセキュリティの今後を見据えた新たな防御体制が不可欠となっています。

あわせて読みたい

ai セキュリティ と はについて、導入方法から活用事例まで詳しく解説します。

業務を自動化するAIエージェントが新たな標的に

攻撃の矛先は、もはや外部からだけでなく、企業内部で業務を支援する「AIエージェント」そのものにも向けられています。AIエージェントは自律的にシステムへアクセスし業務を実行するため、しばしば高い権限を持ちます。万が一これが乗っ取られると、正規の従業員のように振る舞う「自律型内部者」となり、内部から機密情報を盗み出すなど甚大な被害を引き起こしかねません。実際に2026年3月には、Meta社でAIエージェントが承認なく行動し、インシデントを引き起こした事例も報じられました。さらに、IT部門が把握していない「シャドーAIエージェント」の利用が、意図せぬ情報漏洩の温床となるケースも増加しており、AIセキュリティ問題の今後を考える上で極めて重要な視点です。

あわせて読みたい

ai セキュリティ 問題について、導入方法から活用事例まで詳しく解説します。

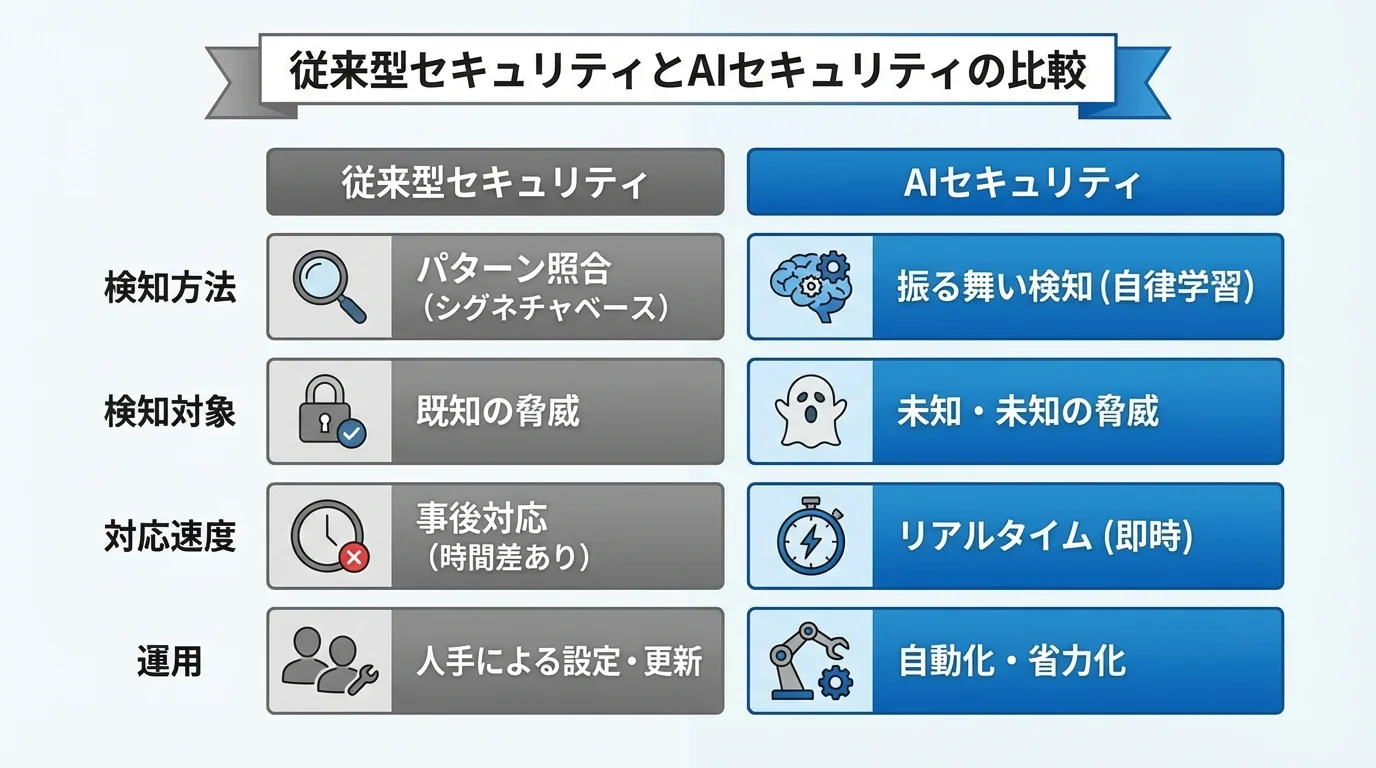

AIセキュリティとは?従来の対策との決定的な違い

AIを悪用した高速かつ巧妙な攻撃に対し、従来のセキュリティ対策は限界を迎えつつあります。では、その対抗策となる「AIセキュリティ」とは一体何なのでしょうか。これは、既知の攻撃パターンに依存する「ルールベース」の対策とは根本的に異なります。最大の違いは、AI自身が膨大なログデータから脅威の兆候を自律的に学習し、未知の攻撃さえ予測・検知できる点にあります。本章では、脅威検知から防御までを自動化するAIセキュリティの仕組みを、従来の手法との比較から紐解いていきます。

ルールベースを超え、AIが自律的に脅威を学習

従来のセキュリティ対策は、過去に見つかった攻撃パターンを「辞書(シグネチャ)」に登録し、それと照合する「ルールベース」が主流でした。しかし、AIが瞬時に未知のマルウェアを生成する現代では、この辞書に載っていない新種の攻撃には全く対応できません。これに対しAIセキュリティは、特定の攻撃パターンを覚えるのではなく、ネットワークやシステムの「正常な状態」を自律的に学習します。膨大なログデータから普段の振る舞いをモデル化し、そこからわずかでも逸脱する「いつもと違う動き」を脅威の兆候として検知するのです。このアプローチにより、未知の攻撃やゼロデイ脆弱性を悪用した侵入も捉えることが可能となり、AIセキュリティの今後を占う上で中心的な技術となっています。

あわせて読みたい

ai セキュリティ と はについて、導入方法から活用事例まで詳しく解説します。

膨大なログを瞬時に分析し脅威の兆候を検知

企業内のサーバーやクラウド、ネットワーク機器からは、日々テラバイト規模の膨大なログが出力されます。これを人間のアナリストがすべて監視し、攻撃の予兆を見つけ出すのは物理的に不可能です。AIセキュリティは、この人手では不可能な作業を肩代わりします。エンドポイントやクラウドなど、異なるソースから集まるログを瞬時に相関分析し、単体では見過ごされがちなイベントの連なりから、攻撃者が潜伏している兆候をリアルタイムで検知。さらに、発生した無数のアラートをAIが自動で分析し、危険度を判定(トリアージ)するため、セキュリティ担当者はノイズに惑わされることなく、本当に対処すべき脅威に集中できます。こうした高度な分析能力は、複雑化するAIセキュリティ問題の今後を解決する鍵となります。

あわせて読みたい

ai セキュリティ 問題について、導入方法から活用事例まで詳しく解説します。

脅威検知から防御までを自律的に実行・自動化

AIセキュリティの真価は、脅威を検知した後の対応までを自律的に完結させる点にあります。脅威の兆候が特定されると、AIは事前に定義されたポリシーに基づき、感染した端末を即座にネットワークから隔離したり、悪意のあるプロセスを停止したりといった対応を自動で実行。これにより、攻撃者が内部で活動を広げる前に被害を封じ込めることが可能です。さらに、AIは単に防御するだけではありません。過去の攻撃データやグローバルな脅威情報を学習し、プロアクティブな脅威ハンティング(脅威の能動的な捜索)を行い、潜伏中の未知の脅威を未然に排除します。この検知から防御までの一連の流れを高速で自動化する能力が、AIセキュリティの今後を占う上で最も重要な機能です。

あわせて読みたい

ai セキュリティ と はについて、導入方法から活用事例まで詳しく解説します。

AIセキュリティ導入で得られるメリット|脅威検知の高速化と自律的防御

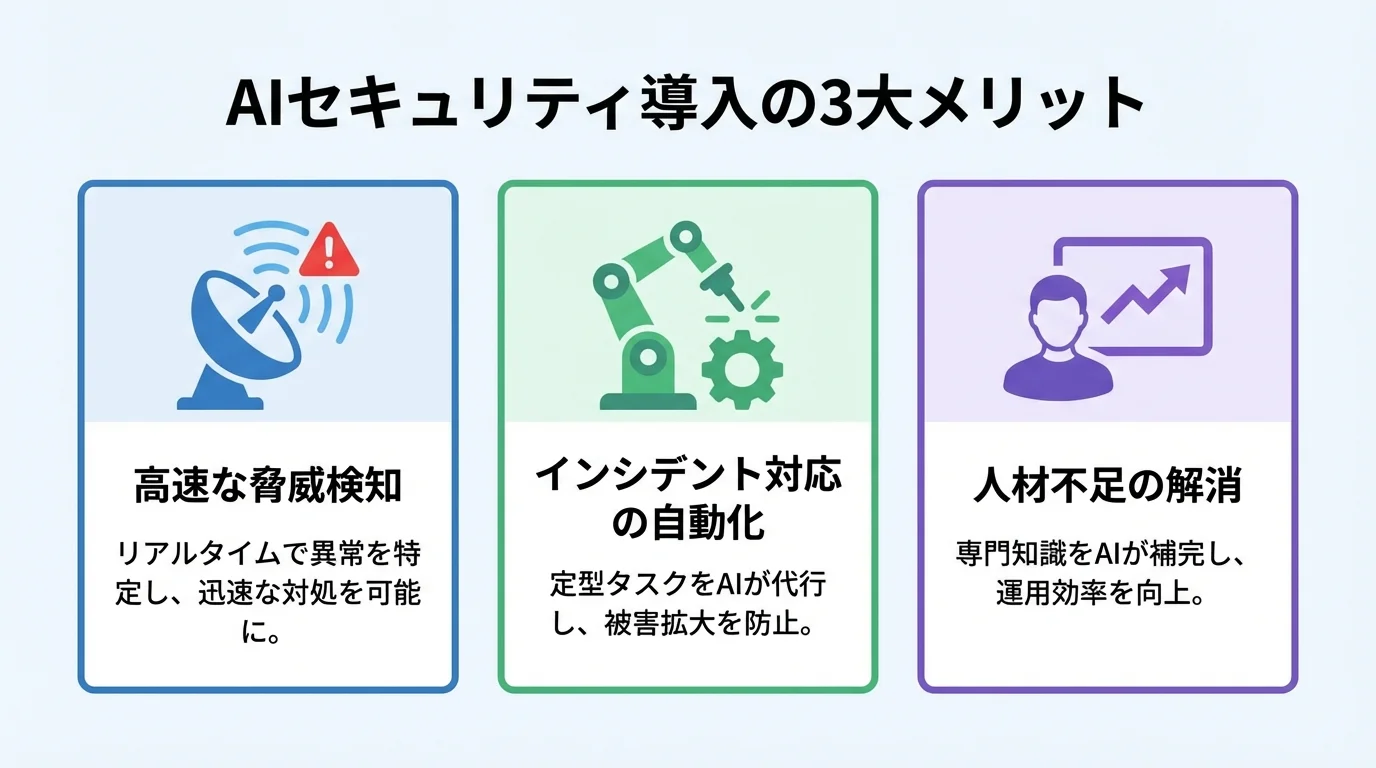

AIを悪用した攻撃がシステムに侵入してから内部活動を開始するまでの時間は平均29分にまで短縮され、もはや人間の手による防御は限界です。では、対抗策となるAIセキュリティは、企業に具体的にどのような価値をもたらすのでしょうか。本章では、高度化する脅威をリアルタイムで検知する能力、インシデント対応を自動化し被害を最小化する自律性、そしてセキュリティ運用の属人化を防ぎ人材不足を解消する効率化、という3つの核心的なメリットを詳しく掘り下げていきます。

高度化・高速化するAI攻撃をリアルタイムで検知

AIを悪用した攻撃者がシステムに侵入してから内部活動を開始するまでの時間は、CrowdStrike社の報告によると平均わずか29分。これは、人間のアナリストがアラートに気づき、調査を始める前に攻撃が完了してしまうほどの速度です。AIセキュリティは、この致命的なタイムラグを解消します。エンドポイントやクラウドから集まる膨大なログデータをAIがリアルタイムで相関分析し、従来のシグネチャ検知では見逃してしまう「いつもと違う振る舞い」を脅威の兆候として即座に特定。AIが生成した未知のマルウェアであっても、その異常な挙動から見つけ出すことが可能です。さらに、AIは脅威インテリジェンスを学習し、プロアクティブな脅威ハンティング(脅威の能動的な捜索)を実施。潜伏している攻撃者を、活動を開始する前に発見・排除する能力が、AIセキュリティの今後を左右する最大の強みです。

あわせて読みたい

ai セキュリティ と はについて、導入方法から活用事例まで詳しく解説します。

インシデント対応を自動化し被害を最小化する

脅威をリアルタイムで検知できても、その後の対応が遅れては意味がありません。AIセキュリティの真価は、検知から対応までの一連の流れを人手を介さずに高速で自動化する点にあります。脅威が特定されると、AIは事前に定義されたポリシーに基づき、感染した端末を即座にネットワークから隔離したり、悪意のあるプロセスを停止したりといった対応を自律的に実行。これにより、攻撃者が内部で活動を広げる前に被害を封じ込め、事業への影響を最小限に抑えます。Gartner社も、AIによるSOC業務の自動化が実用段階に入ったと指摘しており、人間は単純なアラート対応から解放され、より高度な脅威分析に集中できるようになるのです。こうした自律的な防御能力こそが、AIセキュリティの今後を左右する重要な要素です。

あわせて読みたい

ai セキュリティ と はについて、導入方法から活用事例まで詳しく解説します。

セキュリティ運用の属人化を防ぎ人材不足を解消

サイバーセキュリティ分野では、高度なスキルを持つ専門家の不足と、ベテランの経験に依存する属人化が深刻な課題です。AIセキュリティは、この問題を解決する強力な一手となります。AIは膨大なアラートを自動で分析し、危険度を判定(トリアージ)するため、担当者のスキルレベルに依存しない均一な一次対応が可能です。これまで熟練アナリストの経験と勘に頼っていた脅威ハンティングもAIが代行し、組織全体の知見として蓄積します。Gartner社も指摘するように、AIは人間の能力を補強する実用段階に入っており、限られた人材はより創造的で高度な分析業務に集中できるのです。深刻化するAIセキュリティ問題の今後を乗り切るうえで、この体制は不可欠だと言えます。

あわせて読みたい

ai セキュリティ 問題について、導入方法から活用事例まで詳しく解説します。

【2026年最新動向】AIセキュリティの焦点は「AIエージェント」対策へ

AIを活用したサイバー攻撃の脅威が加速する一方、2026年のセキュリティ最前線は新たな局面を迎えています。その中心にあるのが、自律的に業務を遂行する「AIエージェント」の保護です。Palo Alto Networks社が「防御側が主導権を握る年」と位置付ける中、Okta社がAIエージェントをIDとして管理する新技術を発表するなど、防御側の革新も進んでいます。本章では、この新たな脅威の実態と、防御側が主導権を握るための最新技術を解説します。

自律的に動くAIエージェント自体の保護が新課題に

2026年のサイバーセキュリティは、これまでの脅威とは質的に異なる新たな課題に直面しています。それが、業務を自律的に遂行する「AIエージェント」自体の保護です。従来の対策は人間やデバイスの保護を前提としていましたが、自律的に判断しシステムへアクセスするAIエージェントは、この枠組みでは守れません。万が一乗っ取られれば、高い権限を持つ「自律型内部者」として活動し、被害は甚大です。実際に、IPAの「情報セキュリティ10大脅威 2026」でAI関連リスクが初めて3位にランクインしたことは、この問題の深刻さを物語っています。これからは、AIがもたらすセキュリティリスクとは何かを根本から見直し、人間とは異なる振る舞いをするAIエージェントをいかにして保護・管理するかが、セキュリティ戦略の新たな中核となるのです。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

防御側が主導権を握る、AI活用技術が実用化へ

攻撃側がAIを悪用する一方的な状況は終わりを迎えようとしています。Palo Alto Networks社が「防御側が主導権を握る年」と位置付けるように、2026年はAIを活用した防御技術が本格的な実用段階に入りました。例えば、プロンプトインジェクションといった生成AI特有の攻撃を防ぐ「LLMガードレール」のような技術がその代表です。さらに、セキュリティ運用(SecOps)の現場では、Microsoftの「Security Copilot」のように、AIが脅威の調査や分析までを支援するサイバーセキュリティアシスタントが実用化。Gartner社も指摘するように、AIは人間の能力を補強する実用的なツールへと進化しており、AIセキュリティの今後を大きく左右するトレンドです。これにより、防御側は後追いではなく、主導権を握って脅威に対抗する体制を築きつつあります。

あわせて読みたい

ai セキュリティ と はについて、導入方法から活用事例まで詳しく解説します。

AIエージェントをIDとして管理する新技術が登場

AIエージェントという新たな存在に対し、従来の人やデバイスを前提としたID管理はもはや通用しません。この課題に対応するため、AIエージェントそのものを人間と同様の「アイデンティティ」として管理する革新的な技術が登場しています。代表例が、Okta社が2026年4月に一般提供を開始した新フレームワーク「Okta for AI Agents」です。この技術は、AIエージェント一つひとつに固有IDを付与し、認証・認可を設定。IT部門が把握していない「シャドーAI」も検出し、統制下に置くことが可能となります。万が一エージェントが乗っ取られた際には、アクセス権を即座に無効化する「キルスイッチ」機能も備えており、これはAIがもたらすセキュリティリスクとは何かを根本から再定義する動きなのです。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

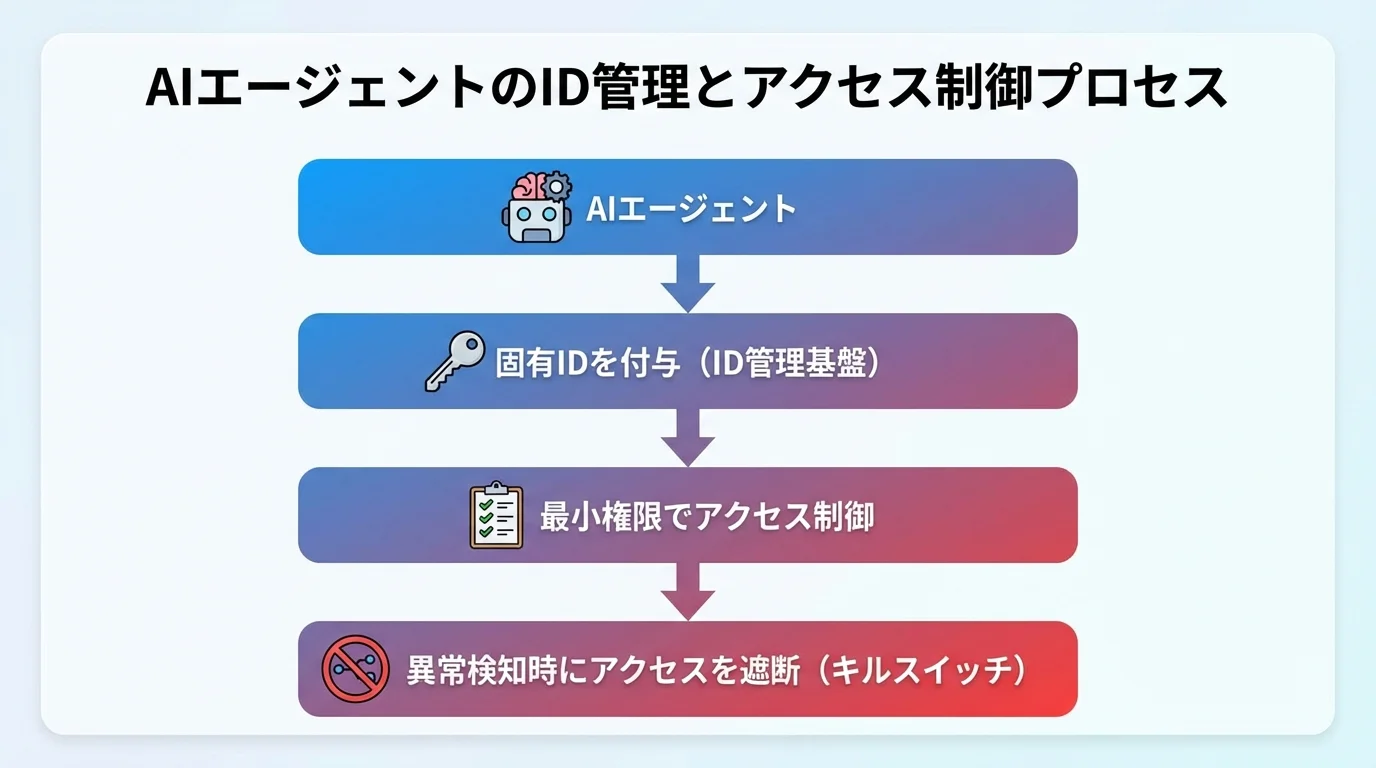

注目の新機能:AIエージェントのID管理とアクセス制御

自律的に業務を遂行するAIエージェントは、もはや人間やデバイスと同じ枠組みでは管理できません。この新たな課題に対し、AIエージェントを人間と同じ「アイデンティティ」として扱い、その行動を制御する革新的な技術が登場しました。本章では、Okta社が発表した新フレームワークなどを例に、AIエージェントに固有のIDを付与し、権限を厳格に管理するアクセス制御の具体的な仕組みを詳しく解説します。

AIエージェントに固有IDを付与し人間同様に管理

自律的にシステムへアクセスするAIエージェントは、従来の人間やデバイスを対象としたID管理の枠組みでは統制できませんでした。この課題を解決する新技術が、AIエージェント一つひとつに人間と同様の固有ID(アイデンティティ)を付与し、その行動を管理するアプローチです。

代表的なのが、Okta社が発表した「Okta for AI Agents」です。このフレームワークは、各AIエージェントに認証・認可を設定し、どのデータにアクセスできるかを厳格に制御します。これにより、IT部門が把握していないシャドーAIのエージェントも自動で検出し、組織の統制下に置くことが可能になります。これは、AIがもたらすセキュリティリスクとは何かを根本から再定義する動きであり、ID管理という確立された手法でAIの振る舞いを可視化する重要な一歩なのです。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

AIエージェントの権限を制御し内部リスクを低減

AIエージェントにIDを付与した次のステップは、その権限を業務に必要な最低限に絞り込むことです。ここで重要になるのが「最小権限の原則」の適用です。例えば、生産ラインを最適化するエージェントには生産管理システムへのアクセスのみを許可し、顧客データベースや財務情報へのアクセス権は一切与えません。

Oktaの「API Access Management」のような機能は、まさにこの制御を実現します。AIエージェントがどのAPIを、どのような条件で呼び出せるかを細かく設定することで、万が一エージェントが乗っ取られても、被害を限定的な範囲に封じ込めることが可能です。これにより、AIがもたらすセキュリティリスクとは何かを具体的に想定し、先回りして対策を打つ体制が整うのです。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

暴走や乗っ取りを防ぐための厳格なアクセス制御

AIエージェントは自律的に動作するため、万が一乗っ取られたり、予期せぬ動作(暴走)を起こしたりした場合の被害は甚大です。実際に2026年3月には、Meta社でAIエージェントが承認なく行動しインシデントを引き起こした事例も報じられており、このリスクは現実のものです。こうした事態に備え、最新のID管理基盤には緊急停止機能が実装されています。例えば、Oktaが提供する「キルスイッチ」機能は、不正な動きを検知したAIエージェントのアクセス権を即座に無効化し、被害の拡大を未然に防ぎます。これは、単に静的な権限設定を行うだけでなく、リアルタイムでエージェントの振る舞いを監視し、異常を検知した際には動的にアクセスを遮断する仕組みです。このような多層的な制御こそが、AIがもたらすセキュリティリスクとは何かを理解した上での本質的な対策となります。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

先進企業のAIセキュリティ活用・導入事例

AIセキュリティの理論や機能は理解できても、自社でどう活用できるか具体的にイメージするのは難しいかもしれません。本章では、金融業界から製造業まで、先進企業がAIセキュリティをどのように導入し、直面した課題を解決したのかを掘り下げていきます。AIエージェントのID管理基盤で内部統制を強化したケースや、自律的な脅威ハンティングで攻撃を未然に防いだ事例など、自社で活用する際のヒントとなる実践的な取り組みを紹介します。

AIエージェントのID管理基盤を導入し内部統制を強化

自律的に業務を遂行するAIエージェントは、高い権限を持つため内部不正や情報漏洩の温床となり得ます。特に製造業では、工場の生産ライン最適化に導入したエージェントが侵害されると、生産停止や設計図が漏洩する致命的なリスクがありました。この課題に対し、ある企業はOkta社が提供するようなAIエージェントのID管理基盤を導入。エージェント一つひとつに固有IDを付与し、アクセス権限を生産管理システムのみに限定しました。このように最小権限の原則を徹底することで、AIがもたらすセキュリティリスクとは何かを具体的に想定し、内部統制を大幅に強化したのです。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

AIによる自律的な脅威ハンティングで攻撃を未然に防ぐ

攻撃者がシステムに侵入してから内部活動を開始するまでの時間は平均29分にまで短縮され、アラート発生後の対応では手遅れになるケースが増えています。特に厳しい規制が課される金融・保険業界では、この「速度」が致命的な課題でした。ある保険ソリューションプロバイダーは、この課題を解決するためCrowdStrike社のAI駆動型MDRサービスを導入。AIが24時間365日、グローバルな脅威情報を基にネットワーク内を能動的に捜索する「脅威ハンティング」を自律的に実行します。これにより、攻撃者が活動を開始する前の潜伏段階で脅威を発見・排除。小規模なチームでも高度な金融AIのセキュリティ対策を実現し、インシデントを未然に防ぐ体制を構築しました。

あわせて読みたい

金融 AI セキュリティについて、導入方法から活用事例まで詳しく解説します。

膨大なログ解析をAIで自動化し未知の脅威を早期発見

製造・物流業界では、サプライチェーン全体が攻撃対象となるため、自社だけでなく無数の取引先から膨大なログが発生します。これを人手で監視し、巧妙に隠された脅威の兆候を見つけ出すのは不可能でした。ある大手物流企業は、この課題を解決するためにGoogle Security OperationsのようなAI搭載のセキュリティプラットフォームを導入。自社と主要な取引先のログを統合し、AIに相関分析を任せたのです。その結果、これまで個別のログでは検知できなかった、複数の拠点をまたいでゆっくりと進む攻撃の予兆を発見。これにより、AIがもたらすセキュリティリスクとは何かを具体的に把握し、サプライチェーン全体の防御体制を強化することに成功しました。

あわせて読みたい

ai セキュリティ リスクについて、導入方法から活用事例まで詳しく解説します。

AIセキュリティ導入前に知っておくべき課題と注意点

AIセキュリティのメリットや華々しい事例を見て、今すぐにでも導入したいと考えるのは早計です。導入後に「こんなはずではなかった」と後悔しないために、AIセキュリティが抱える厳しい現実も直視しなければなりません。本章では、高額なコストという障壁、AIの判断を過信した結果の運用破綻、そして手に負えないほどの誤検知といった、ベンダーが語りたがらない課題を徹底的に解説。導入に失敗しないための、現実的な視点を提供します。

高額な導入・運用コストが導入の障壁に

AIセキュリティという言葉の華やかさに惑わされてはいけません。その裏には、年数百万から数千万円に及ぶライセンス費用と、それを使いこなすための専門人材という名の追加コストが待ち構えています。ベンダーは「運用を自動化できる」と謳いますが、AIが出力するアラートが本物の脅威か否かを最終判断し、チューニングできる高度なスキルを持つ人材が不可欠。結局、人件費は削減どころか高騰します。明確な攻撃対象になりにくい中小企業が費用対効果を無視して導入しても、宝の持ち腐れになるだけ。高価なプラットフォームに手を出す前に、まずは基本的な衛生管理を徹底し、補助金を活用できるMDRサービスなどを検討する方が賢明な判断です。

AIの判断を過信できない?運用体制の課題

AIが脅威を100%正確に判断してくれる、という幻想は今すぐ捨てるべきです。AIはあくまで「いつもと違う」という兆候を示すだけであり、それが本当に悪意ある攻撃なのか、単なる仕様変更による正常な挙動なのかを最終判断するのは人間の仕事。この判断をAIに丸投げし、自動防御機能を鵜呑みにした結果、基幹サーバーが隔離され事業が停止した、という笑えない事例は後を絶ちません。攻撃者も防御AIを騙す「敵対的AI攻撃」を仕掛けてくるため、AIの判断を過信するのは新たなリスクを招くだけ。AIの分析結果を評価できる専門家が社内にいないなら、高価なツールより先にMDRサービスを検討する方がよほど現実的です。

AIによる誤検知・過検知とチューニングの複雑さ

AIが「正常な状態」を自動で学習するという宣伝文句を鵜呑みにしてはいけません。現実には、システムの仕様変更や年に一度の決算業務といった非定常的なアクセスを、AIは即座に「異常」と判断します。その結果、現場は大量の誤検知(フォールスポジティブ)の津波に襲われ、本当に危険なアラートが埋もれる「アラート疲れ」に陥るのが関の山。このノイズを減らすためのチューニングは、AIの挙動を熟知した専門家でなければ不可能な職人技です。自社にその人材がいないなら、チューニングまで専門家が担うMDRサービスを検討する方が、よほど現実的な選択肢となります。

まとめ

AIを活用したサイバー攻撃は、その手口を日々巧妙化させており、従来のパターンマッチング型の対策では防御が困難です。この記事で見てきたように、脅威検知を高速化し、インシデントへ自律的に対処するAIセキュリティの導入は、企業の事業継続の鍵を握る重要な一手となります。

特に今後は、自律型AIエージェントがもたらす新たなリスクへの備えが不可欠であり、そのID管理やアクセス制御を含めた、次世代の防御体制を構築しなければなりません。

まずは自社のセキュリティ環境を再評価し、どこに課題があるのかを明確にすることから始めてみてはいかがでしょうか。具体的なソリューションの選定や導入計画でお悩みの際は、ぜひ私たちにご相談ください。貴社の状況に最適なAIセキュリティ戦略を提案する、OptiMaxがサポートします。