LLMOpsとは?従来のMLOpsとの違いと急速に高まる重要性

ChatGPTの登場以降、大規模言語モデル(LLM)のビジネス活用が急速に拡大する一方、その本番運用には従来の機械学習モデルとは異なる特有の難しさが存在します。この課題を解決する鍵となるのがLLMOpsです。これは単なるMLOps(機械学習基盤)の延長ではなく、2026年現在、AIが外部ツールを自律的に利用する「行動者」へと進化し、複数のAIが協調する「マルチエージェント・システム」が登場する中で不可欠となった新たな運用基盤です。本章では、LLMOpsの基本からMLOpsとの違い、そしてなぜ今その重要性が高まっているのかを解説します。

MLOpsの延長ではない、LLM特有の運用基盤

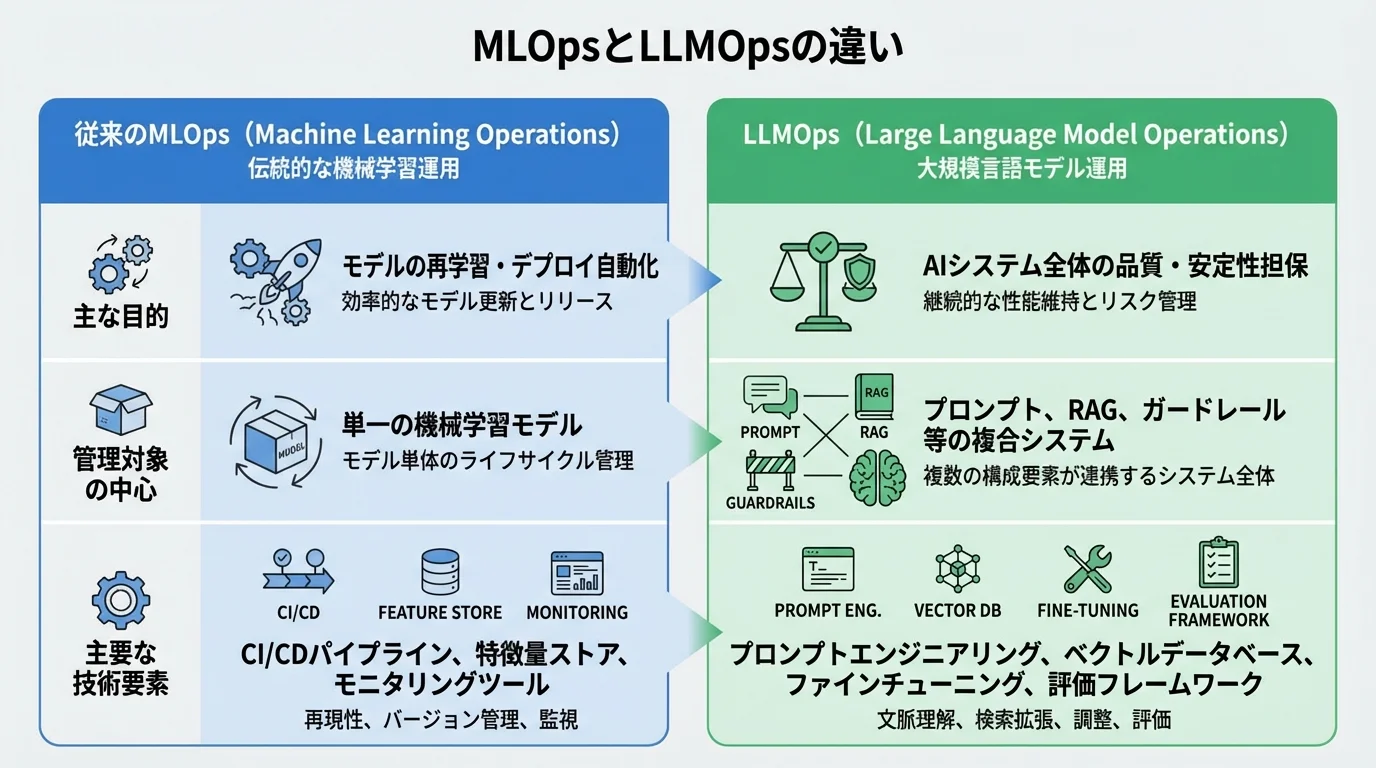

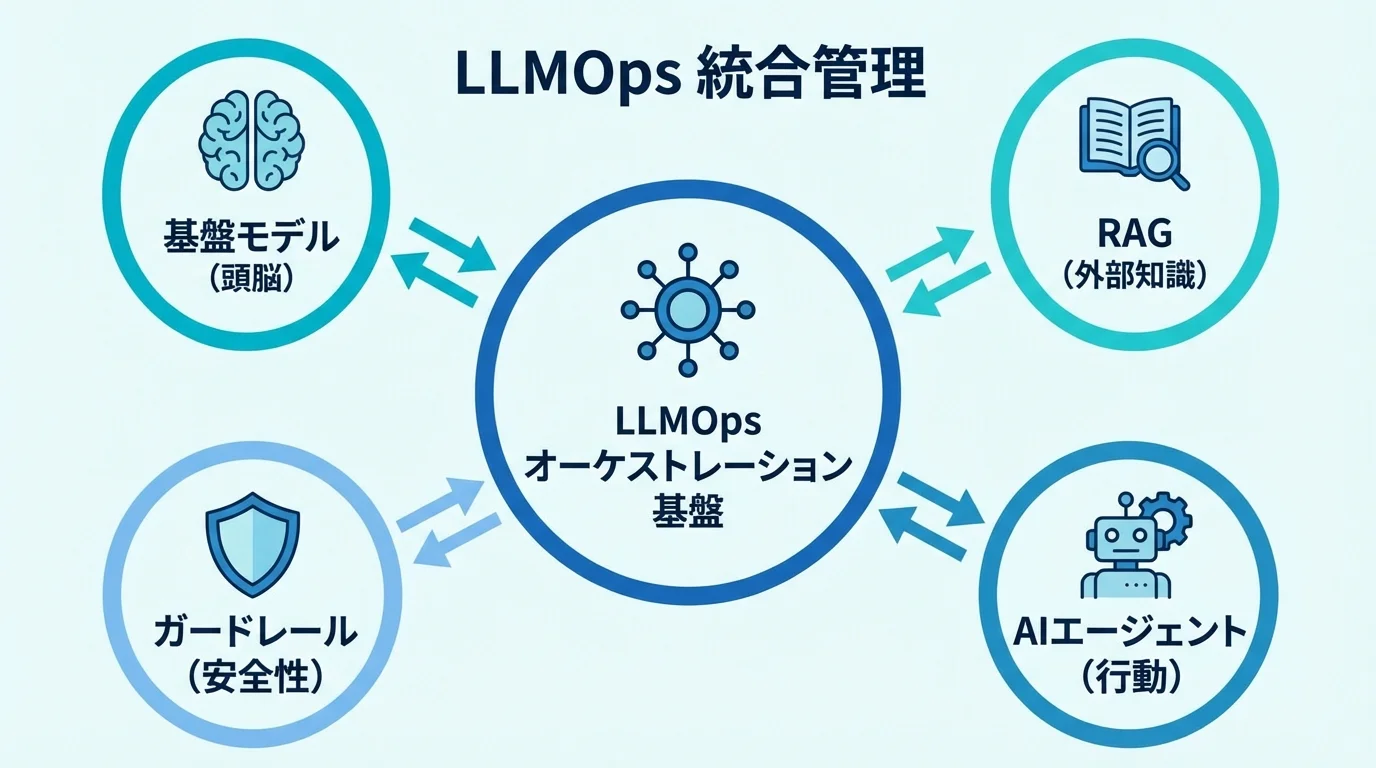

従来のMLOpsが、主にモデルの再学習とデプロイ自動化に主眼を置いていたのに対し、LLMOpsが扱う領域は全く異なります。LLMの運用では、モデル自体の学習よりも、プロンプトのバージョン管理、RAG(検索拡張生成)パイプラインの最適化、そして不適切な出力を防ぐガードレールの設置といった、LLM特有のコンポーネント管理が中心になります。これは、単一のモデルを管理するのではなく、基盤モデル、外部知識、エージェントなどを組み合わせた複雑なAIシステム全体を統合的に運用(オーケストレーション)する思想です。つまり、LLMとは何かを理解するだけでなく、その周辺技術を含めたシステム全体の品質と安定性を担保する、新たな運用基盤なのです。

あわせて読みたい

llm とはについて、導入方法から活用事例まで詳しく解説します。

「自律的行動者」へと進化するAIの運用を担う

LLMOpsが重要視される背景には、LLMが単なるテキスト生成ツールから、自律的にタスクを実行する「行動者」へと進化を遂げたからです。2026年現在、AIは外部APIを利用して情報を収集し、広告の入札価格を調整するといった、具体的なアクションを起こす能力を獲得しました。このような「行動するAI」は、AIエージェントと生成AIの違いとは何かを理解すると、よりそのインパクトが明確になるでしょう。課題設定から仮説立案、評価までをAIがエンドツーエンドで自動化する研究も進む中、こうしたAIエージェントを安全かつ安定的に運用するには、その自律的な行動を監視・制御するための新たな基盤が不可欠です。それがまさにLLMOpsの重要な役割なのです。

あわせて読みたい

ai エージェント 生成 ai 違いについて、導入方法から活用事例まで詳しく解説します。

複数AIを連携させる高度なオーケストレーション

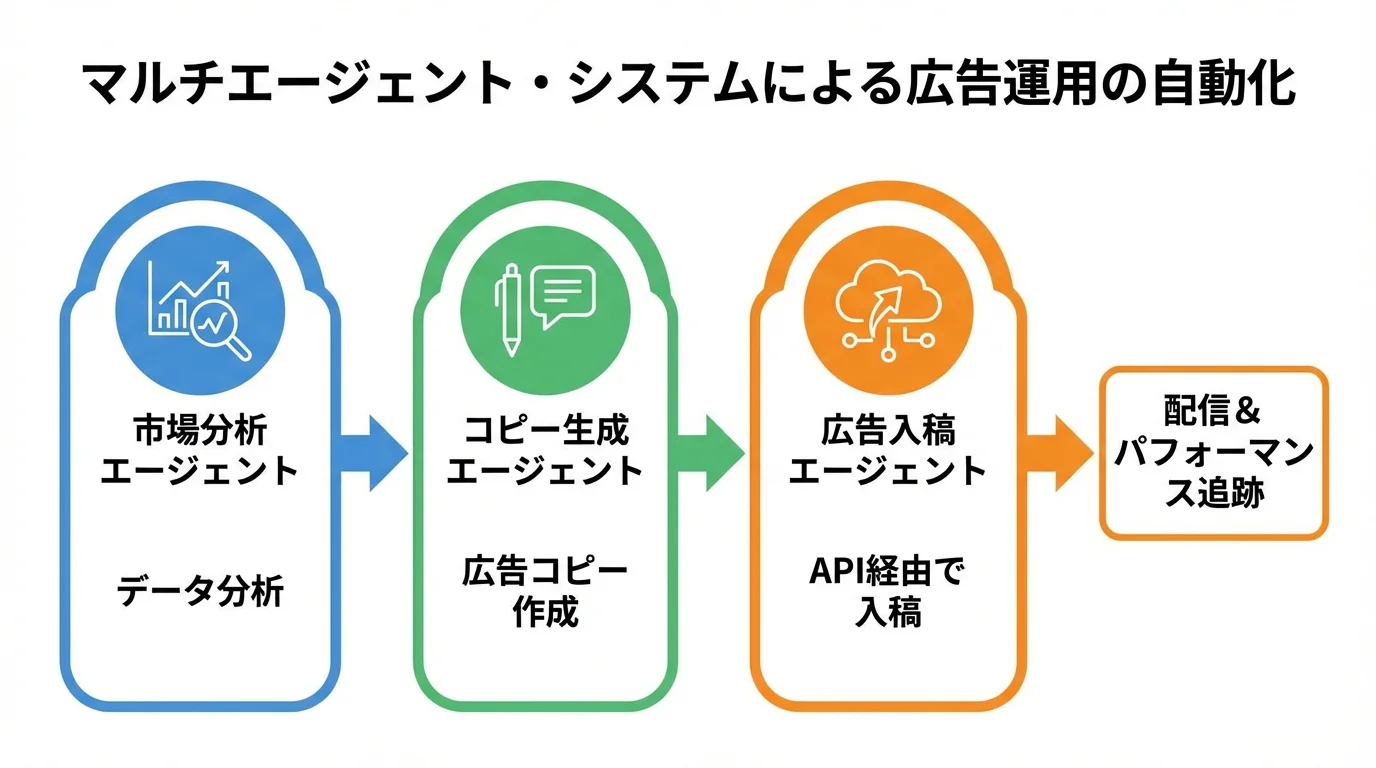

LLMOpsの重要性は、単一のAIを管理するだけにとどまりません。2026年現在、AIの活用は、それぞれが専門的な役割を持つ複数のAIエージェントが協調して、より複雑なタスクを遂行するマルチエージェント・システムへと進化しています。これは、まるで工場の組み立てラインのように、広告コピーを生成するAI、クリエイティブを制作するAI、APIを通じて入稿するAIが連携して動作するイメージです。さらに、クラウド上の大規模モデルと、デバイス上で高速に動作するなぜ今ローカルLLMなのかが問われる小規模言語モデル(SLM)を組み合わせるハイブリッド構成も一般化しました。こうした異なる特性を持つ複数のAIコンポーネントを統合し、システム全体として安定稼働させる高度な指揮(オーケストレーション)こそが、LLMOpsに求められる中核的な役割なのです。

あわせて読みたい

llm ローカルについて、導入方法から活用事例まで詳しく解説します。

なぜLLMOpsが不可欠なのか?自律型AIエージェント時代の到来

2026年、AIは単なるテキスト生成ツールから、外部APIを自律的に利用してタスクを遂行する自律型AIエージェントへと進化を遂げました。研究分野では、課題設定から仮説立案、評価までをエンドツーエンドで自動化する試みも始まっています。しかし、このように強力なAIをビジネスの現場で安定稼働させるには、その自律的な行動をいかに制御し、予測不能なリスクから守るかという課題が生まれます。本章では、この新たな時代のAI運用にLLMOpsがなぜ不可欠なのか、その理由を深掘りしていきましょう。

AIが自律的にタスクを遂行する時代の到来

これまでのAIが、質問に答えたり文章を作成したりする「知識の保管庫」だったのに対し、2026年現在のAIは、外部ツールを自律的に利用して具体的なタスクを実行する「行動者」へとその役割を大きく変えています。例えば、広告運用AIは単にレポートを作成するだけではありません。自らデータを分析して最適な媒体に予算を再配分し、APIを操作して実際に入札価格を調整するといった、具体的なアクションまで完結させます。このようなAIは、もはや単なるプログラムではなく、自律的に判断し行動する「従業員」に近い存在であり、その能力の高さはAIエージェントと生成AIの違いとは何かを知ることで、より深く理解できるはずです。

あわせて読みたい

ai エージェント 生成 ai 違いについて、導入方法から活用事例まで詳しく解説します。

課題設定から評価までをエンドツーエンドで自動化

自律型AIエージェントの能力は、単に与えられたタスクをこなす段階を超えました。2026年現在、科学研究の分野では、AIが自ら課題を発見し、仮説を立て、検証し、結果を評価するという、研究開発プロセス全体をエンドツーエンドで自動化する取り組みが始まっています。例えば、Sakana AIが発表した「The AI Scientist」は、AI自身が科学者のように振る舞う概念を具現化したものです。この流れは、AIによる評価能力を問う「llm as a judge」の是非といった議論にも繋がります。このような高度な自律的プロセスをビジネスで安定運用するには、その思考と行動の全体像を確実に管理・統制する仕組みが不可欠であり、LLMOpsはそのための生命線なのです。

あわせて読みたい

llm as a judgeについて、導入方法から活用事例まで詳しく解説します。

外部ツールと連携するAIを安定稼働させる必要性

AIが外部のWebサイトやAPIにアクセスし、自律的にツールを使いこなす能力は、ビジネスの可能性を飛躍的に向上させた一方、新たなリスクを生み出しました。特に深刻なのが「間接的プロンプトインジェクション」と呼ばれる攻撃です。これは、AIが読み込んだ外部情報に悪意のある指示が埋め込まれていることで、意図せず機密情報を漏洩させたり、システムを不正に操作されたりする脅威を指します。これは、従来の生成AIとは次元の異なるリスクであり、予測不能な行動を防ぐ仕組みがなければ、自律型エージェントを本番運用できません。LLMOpsは、不審な挙動を即座に検知・遮断するガードレールの設置や、ツール利用のログを厳格に管理する監視体制を構築し、強力なAIを安全かつ安定的に稼働させるための生命線なのです。

あわせて読みたい

生成AIについて、基礎知識から活用事例・比較・導入方法まで包括的に解説するガイドです。

2026年の最新トレンド|マルチエージェント・システムとSLMの活用

LLMOpsが管理する対象は、もはや単一の巨大なLLMだけではありません。2026年の最前線では、専門分野ごとにAIが連携するマルチエージェント・システムと、特定のタスクに特化させた小規模言語モデル(SLM)の活用が新たな標準です。この変化は、AIが知識を生成するだけの存在から、自らタスクを遂行する「行動者」へと根本的に役割を変えたことを意味します。ここでは、ビジネスの未来を左右するこれらの最新トレンドを具体的に見ていきましょう。

複数AIが協調するマルチエージェントシステムの台頭

2026年現在、AI活用の最前線は、単一の万能なLLMに全てのタスクを任せる時代から、専門的な役割を持つ複数のAIエージェントが協調する「マルチエージェント・システム」へと移行しました。これは、まるで専門家で構成されたプロジェクトチームのように、市場分析エージェント、コピーライティングエージェント、広告入稿エージェントが連携し、自律的に広告運用を最適化する仕組みです。そもそもAIエージェントと生成AIの違いとは何かを理解すると、このシステムの革新性がより明確になるはずです。この流れを技術的に後押しするのが、Anthropic社などが主導するオープン標準規格「Model Context Protocol(MCP)」の普及です。これは「AIアプリケーションのためのUSB-C」とも呼ばれ、これまで分断されていたAI間の連携を容易にし、複雑なワークフローの構築を加速させています。

あわせて読みたい

ai エージェント 生成 ai 違いについて、導入方法から活用事例まで詳しく解説します。

特定タスクに特化する小規模言語モデル(SLM)の活用

2026年のトレンドは、全ての処理を巨大なクラウドLLMに依存するのではなく、特定のタスクに特化させた小規模言語モデル(SLM)を使い分けるハイブリッドアプローチです。例えば、応答速度が重要なチャットの一次対応や定型的なデータ処理は、デバイス上(エッジ)で高速に動作するSLMが担当します。そして、より複雑な分析や長文の要約が必要な場合にのみ、クラウド上の高性能なLLMを呼び出すのです。このような構成は、コストを大幅に削減しつつ、ユーザー体験を向上させる鍵となります。そもそも、なぜ今ローカルLLMなのかという問いの答えが、まさにこのコストと速度の両立にあります。ただし、SLMは日本語の推論能力に課題がある場合も多く、その特性を理解した上で、LLMOpsを通じて複数のモデルを適切に連携させる緻密なシステム設計が不可欠です。

あわせて読みたい

llm ローカルについて、導入方法から活用事例まで詳しく解説します。

知識生成からタスクを実行する「行動者」への進化

2026年現在、LLMはもはや単なる「知識の保管庫」ではありません。自ら外部ツールを駆使し、具体的なタスクを遂行する「行動者(エージェント)」へと、その役割を根本的に変えました。この進化は、単にAPIを操作するレベルに留まらないのです。例えば、科学研究の分野では、研究者が目的を伝えるだけでAIが仮説立案から検証までを支援する「AI Co-scientist」のような概念が実用化されています。これは、AIが人間の知的労働を代替するだけでなく、協働するパートナーになったことを示す象徴的なトレンドです。そもそもAIエージェントと生成AIの違いとは何かを理解すると、この変化の大きさがより明確になります。このように高度化するAIの自律的な「行動」を管理・統制し、ビジネス価値へと繋げる基盤こそがLLMOpsなのです。

あわせて読みたい

ai エージェント 生成 ai 違いについて、導入方法から活用事例まで詳しく解説します。

LLMOpsの主要機能|複雑なAIシステムの高度なオーケストレーション

自律型エージェントやマルチエージェント・システムが主流となった今、AI運用は単一モデルの管理では成り立ちません。求められるのは、基盤モデル、RAG(検索拡張生成)、ガードレールといった複数のコンポーネントを統合管理し、システム全体を円滑に動かす高度な指揮(オーケストレーション)です。この章では、LLMOpsが提供する具体的な機能、特に自律型エージェントのツール利用をどう監視し、複雑なワークフローをいかに定義するのかを具体的に解説します。

基盤モデル・RAG・ガードレールの統合管理機能

LLMOpsの中核をなすのは、個別の技術を管理するのではなく、システム全体を指揮する「オーケストレーション」機能にあります。具体的には、AIの頭脳となる基盤モデル、外部知識を参照するRAG(検索拡張生成)、そして安全性を担保するガードレールという、3つの異なるコンポーネントを統合的に管理するのです。どのバージョンの基盤モデルを使うか、RAGが参照するデータベースは最新か、そしてガードレールはどのような不適切な出力を防ぐべきか。LLMOpsはこれら全ての設定と連携を一元管理し、複雑なAIシステム全体の安定稼働を支えます。なぜ今LLMにRAGが必須なのかを理解すると、これらの要素が相互に深く影響し合うため、統合管理がいかに重要かが明確になるでしょう。

あわせて読みたい

llm ragについて、導入方法から活用事例まで詳しく解説します。

自律型エージェントのツール利用と行動の監視

LLMが外部APIを操作し、自律的にタスクを実行する「行動者」へと進化したことで、その行動の監視と制御がLLMOpsの極めて重要な機能です。AIエージェントと生成AIの違いとはを理解すると、この変化のインパクトがより明確になります。LLMOpsは、エージェントが「どのツールを」「どのようなパラメータで」「いつ実行したか」といった行動履歴を詳細に記録・追跡(トレーサビリティ)する機能を提供します。これにより、APIの連続実行によるコストの暴走や意図しないシステム変更を即座に検知できるのです。さらに、悪意ある外部情報による不正操作を防ぐため、利用できるツールやAPIの権限を厳格に管理し、不審な挙動を遮断するセーフティネットとしての役割も担います。

あわせて読みたい

ai エージェント 生成 ai 違いについて、導入方法から活用事例まで詳しく解説します。

複数コンポーネントを連携させるワークフロー定義

LLMOpsの真価は、複数のAIコンポーネントが協調して動作するための「設計図」、すなわちワークフローを定義し、自動実行する機能にあります。例えば、広告運用を自動化するマルチエージェント・システムでは、「市場分析エージェントがデータを出力」→「コピー生成エージェントが広告文を作成」→「入稿エージェントがAPIを操作」といった一連の流れを厳密に定義します。この複雑な連携を技術的に支えるのが、オープン標準規格である「Model Context Protocol(MCP)」です。これにより、特性の異なるAI間のデータ受け渡しが容易になり、どのタスクにどのモデルを割り当てるかをLLM leaderboard最新TOPなどで比較検討しながら、最適なパイプラインを構築することが可能になります。LLMOpsは、このような複雑な指示系統を管理し、AIシステム全体が意図通りに機能するための司令塔の役割を担うのです。

あわせて読みたい

llm leaderboardについて、導入方法から活用事例まで詳しく解説します。

LLMOpsの具体的な活用事例|ビジネスを加速させる最先端の取り組み

LLMOpsの高度な機能が、実際のビジネスシーンでどのように価値を生み出しているのでしょうか。本章では、単なる業務効率化に留まらない、ビジネスモデルそのものを変革する最先端の活用事例を具体的に解説します。自律型エージェントが広告運用を完全に自動化する事例や、ソフトウェア開発における仮説立案から実装までを支援する取り組みなど、あなたのビジネスを加速させるヒントがここにあります。

自律型エージェントによる広告運用の自動化

LLMOpsは広告運用を新たな次元へと引き上げます。もはや単なるレポート作成の自動化ではありません。市場データを分析するAI、広告コピーを生成するAI、媒体APIを操作して実際に入稿するAIが連携し、自律的なマーケティングシステムを構築します。例えば、AIエージェントが日々の広告レポートを分析し、最も効果の高い媒体へ自動で予算を再配分、さらには入札価格の調整までを完結させるのです。そもそもAIエージェントと生成AIの違いとは何かを理解すると、そのインパクトがより明確になります。LLMOpsは、こうした複数のエージェントが実行する複雑なワークフローを安定稼働させ、意図しない予算超過や誤った操作を防ぐための監視・制御基盤として不可欠な役割を担っています。

あわせて読みたい

ai エージェント 生成 ai 違いについて、導入方法から活用事例まで詳しく解説します。

ソフトウェア開発の仮説立案から実装までを支援

LLMOpsの活用は、ソフトウェア開発の領域においても革命をもたらしています。もはや単なるコード生成の補助ではなく、要件定義から実装、テストまでの開発ライフサイクル全体を支援する動きが加速しているのです。例えば、「AI Co-scientist」構想のように、開発者がビジネス要件を伝えるだけで、AIが技術的な仕様の叩き台を作成し、複数の実装パターンを提案。さらに、生成したコードのテストから脆弱性のチェックまでを自動で実行します。こうした自律的な振る舞いは、AIエージェントと生成AIの違いとは何かを理解すると、その強力さがよくわかります。LLMOpsは、これら複数のツールやエージェントが連携する複雑なワークフローを安定稼働させ、開発プロセスそのものの自動化を支える司令塔なのです。

あわせて読みたい

ai エージェント 生成 ai 違いについて、導入方法から活用事例まで詳しく解説します。

複数AI連携による高度な顧客対応システムの構築

顧客対応の自動化は、複数のAIが協調する新たなフェーズに入りました。想像してみてください。まず、問い合わせの一次対応はデバイス上で高速に動作するSLM(小規模言語モデル)が担当し、即座に回答します。しかし、専門的な内容と判断されると、自動的にクラウド上の高性能なLLMへエスカレーション。そこでは、社内ナレッジを検索するAIと、最適な回答文を生成するAIが連携して、高品質なサポートを提供するのです。そもそもAIエージェントと生成AIの違いとは何かを理解すると、この仕組みの強力さが分かります。LLMOpsは、このようなマルチエージェント・システムの複雑なワークフローを安定稼働させ、対応品質を担保するための司令塔として機能します。

あわせて読みたい

ai エージェント 生成 ai 違いについて、導入方法から活用事例まで詳しく解説します。

LLM本番運用の精度と安定性を高めるLLMOps導入ステップ

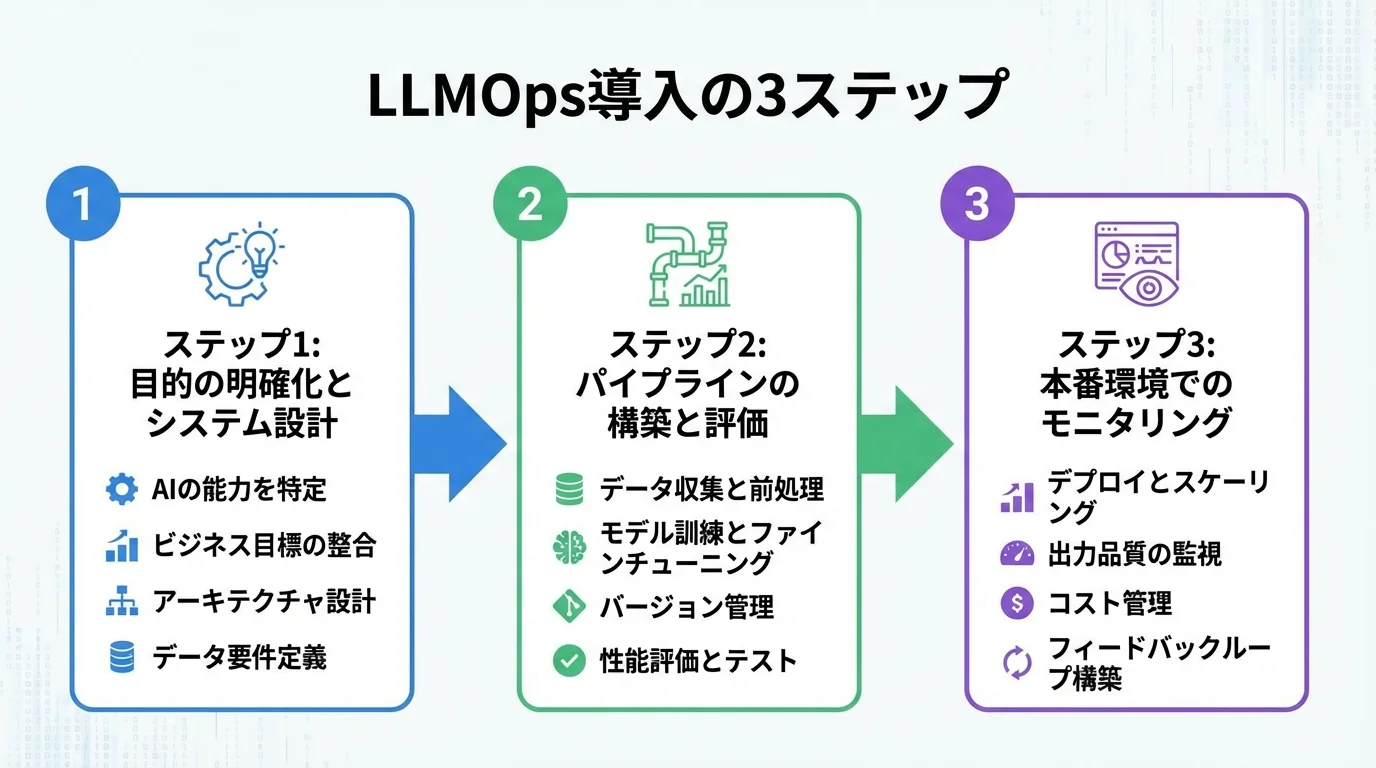

自律型AIエージェントの強力な能力をビジネスで安定して活用するには、思い付きの導入ではなく、体系的なアプローチが不可欠です。本章では、LLMアプリケーションの精度と安定性を担保するためのLLMOps導入手順を、具体的な3つのステップに沿って解説します。AIエージェントのシステム設計から、複数コンポーネントを連携させるパイプラインの構築・評価、そして最も重要な本番環境でのモニタリング体制まで、実践的なロードマップを確認していきましょう。

目的の明確化とAIエージェントのシステム設計

LLMOps導入の最初のステップは、目的を具体的に定義することから始まります。単に「業務を効率化したい」といった曖昧な目標ではなく、「何のためにLLMを使うのか」を明確化し、必要なAIの能力(対話、論理思考、長文読解など)を特定することが不可欠です。この初期段階で、どのタスクにどのモデルが最適かを見極める基準を設定しておくことが、プロジェクト成功の鍵を握ります。

目的が定まったら、次はそれを実現するためのAIエージェントのシステム設計に移ります。2026年現在、単一の万能なLLMに頼るのではなく、専門的な役割を持つ複数のAIエージェントが連携するアーキテクチャが基本です。例えば、応答速度が求められるタスクにはエッジで動くSLMを、高度な分析にはクラウドLLMを割り当てるハイブリッド構成が一般的です。この複雑な連携を円滑にするため、AIの動作要件を厳密に定義する「仕様駆動開発(SDD)」のアプローチを取り入れ、意図しない行動を設計段階で防ぐことが重要になります。どのモデルがタスクに適しているかは、LLM leaderboard最新TOPなどを参考に比較検討すると良いでしょう。

あわせて読みたい

llm leaderboardについて、導入方法から活用事例まで詳しく解説します。

複数コンポーネント連携パイプラインの構築と評価

システム設計に基づき、次に行うのがRAG(検索拡張生成)パイプラインやプロンプト、ガードレールといった複数のコンポーネントを実際に連携させるパイプラインの構築です。このフェーズでは、単に機能を繋ぐだけでなく、レスポンス速度やAPIコストといった本番運用を見据えた性能要件も満たす必要があります。

構築したパイプラインは、ビジネス要件を満たすか厳密に評価しなくてはなりません。LLMの出力は文脈依存度が高く、単純な正解率では測れないため、学習に使用していないデータで多角的に検証します。この評価の難しさから、「llm as a judge」の是非が問われるようにAI自身を評価者として活用する手法も有効です。基盤モデルの更新による「サイレントな品質劣化」を防ぐためにも、この評価プロセスを継続的に実行する体制が不可欠だ。

あわせて読みたい

llm as a judgeについて、導入方法から活用事例まで詳しく解説します。

本番環境における自律的行動のモニタリング体制

LLMアプリケーションを本番環境にデプロイした後は、その自律的な行動を監視し続ける体制構築が最後の要となります。特に、外部ツールを自律的に操作するAIエージェントは、その強力さゆえにAPIの連続実行によるコスト暴走や、基盤モデル更新に伴う「サイレントな品質劣化」といった予測不能なリスクを内包しています。そもそもAIエージェントと生成AIの違いとは何かを理解すると、その行動を管理する重要性が分かるはずです。

あわせて読みたい

ai エージェント 生成 ai 違いについて、導入方法から活用事例まで詳しく解説します。

そのため、単に出力テキストを監視するだけでは不十分だ。AIが「どのツールを」「いつ」「どのようなパラメータで実行したか」といった行動ログを厳格に追跡し、トレーサビリティを確保することが不可欠になります。さらに、外部情報を読み込むことで発生する「間接的プロンプトインジェクション」のような新たなセキュリティ脅威に備え、不審な挙動を即座に検知・遮断する動的なガードレールとアラートシステムを整備しなくてはなりません。この継続的な監視と改善サイクルこそが、AIの価値を安定して引き出すための生命線なのです。

LLMOps導入時の課題とリスク|知っておくべき注意点

ここまでLLMOpsの強力な機能と輝かしい未来像を解説してきたが、現実はそう甘くない。AIの自律的行動がもたらす予測不能なリスクは、単なる技術課題ではなく、時にビジネスそのものを揺るがしかねないからだ。この章では、そうした理想論では語れない現実、つまり高騰するコスト、複雑化するシステム、そして絶望的な専門人材の不足といった不都合な真実に切り込む。導入後に後悔しないために、必ず目を向けるべき注意点である。

自律的行動がもたらす予測不能なリスク

自律型エージェントが業務を代行するという話は、都合の良い夢物語に過ぎない。実際には、複数のエージェントが連携した結果、互いの出力をトリガーに無限ループに陥り、APIコストが数時間で数百万円に高騰する事故は後を絶たない。これは単なるバグではなく、自律的エージェントが持つ創発的な振る舞いに起因する。LLMOpsで行動ログは追えても、「なぜAIがその判断に至ったか」という思考のブラックボックスは解明できないのだ。最終的な意思決定をAIに委ねるのは極めて危険な賭けであり、重大な判断には必ず人間が介在する設計にしなければ、ビジネスを破綻させるデジタルなフランケンシュタインを生み出すことになる。

複数AI連携が招くシステム複雑性の罠

複数のAIを連携させるという甘い言葉に騙されてはいけない。現実には、各モデルのバージョン、プロンプト、RAGの依存関係が複雑に絡み合い、デバッグ不能な「スパゲッティ・システム」が完成するだけだ。問題発生時に、どのAIエージェントの出力が根本原因なのかを特定する作業は、干し草の山から針を探すに等しい。結局、システムは特定のエンジニアしか触れない技術的負債と化し、その維持コストが導入効果をあっさりと上回る。単純な社内DB検索にマルチエージェントを導入して失敗した企業のように、その複雑性が本当に必要か、RPAや単一のRAGで十分ではないか冷静に判断すべきである。

高度化する技術と専門人材確保の壁

LLMOpsを支える技術は日進月歩で進化するが、それを使いこなせる専門人材は市場にほぼ存在しないのが不都合な真実だ。LLMの深い知識、RAGパイプラインの構築、そして複数のAIエージェントを連携させる知見を持つエンジニアなど、都合の良い人材はどこにもいない。結果、「LLMOps推進」を掲げたプロジェクトが、実務経験のない「自称AIエンジニア」を雇ってしまい、メンテナンス不能な技術的負債を抱えるのは典型的な失敗例である。高額な報酬で採用活動に夢を見るより、まずは身の丈に合ったシンプルなシステム運用から始めるべきだ。

まとめ

本記事では、LLMの本番運用における精度と安定性を確保するためのLLMOpsについて、その重要性から具体的な導入ステップ、最新トレンドまでを網羅的に解説しました。単なるプロトタイプ開発から脱却し、ビジネスのコア機能としてLLMを活用するためには、LLMOpsの導入が不可欠です。

特に、自律型AIエージェントや複数のAIが連携するマルチエージェント・システムが主流となる未来では、モデルの性能を継続的に監視・改善し、システム全体を安定稼働させるための運用基盤が成功の鍵を握るでしょう。LLMOpsは、そのための強力な羅針盤となる存在だ。

まずは、自社でLLMをどのように活用したいのかを具体的に定義し、小さなプロジェクトからLLMOpsの導入を始めてみてください。もし、導入計画や技術的な課題でお困りでしたら、専門的な知見を持つOptiMaxが最適なソリューションをご提案します。お気軽にお問い合わせください。